Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

Cyfrowa „terapia” – sztuczna inteligencja a zdrowie psychiczne

Skonfrontowaliśmy ekspercką wiedzę z odpowiedziami chatów AI na temat zdrowia psychicznego.

fot. Pexels / Modyfikacje: Demagog

Cyfrowa „terapia” – sztuczna inteligencja a zdrowie psychiczne

Skonfrontowaliśmy ekspercką wiedzę z odpowiedziami chatów AI na temat zdrowia psychicznego.

Według portalu swiatprzychodni.com, którego celem jest ułatwianie pacjentom wyszukiwania placówek publicznej ochrony zdrowia, średni czas oczekiwania na konsultację z psychiatrą wynosi w Polsce 121 dni. W województwie z najdłuższym średnim czasem oczekiwania na wizytę czeka się 258 dni.

Drugą najczęstszą przyczyną śmierci młodych ludzi w Europie jest samobójstwo. Psychiatrów dziecięcych jest obecnie w Polsce 555, co oznacza, że jeden lekarz przypada na 12,4 tys. dzieci i młodzieży do 18. roku życia. W 2023 roku liczba odnotowanych przez policję prób samobójczych osób w tym wieku to 2 139. Rok wcześniej liczba zamachów samobójczych zakończonych śmiercią wśród osób powyżej 60. roku życia wyniosła 1 522.

Oznacza to, że potrzeba specjalistycznej opieki psychiatrycznej i psychologicznej jest duża i nie w pełni zaspokojona. Brak wystarczającej liczby specjalistów sprawia, że część osób może poszukiwać pomocy w niecodzienny sposób – poprzez zwrócenie się w stronę sztucznej inteligencji. Czy to dobry pomysł?

Zainteresowanie cyfrowym „terapeutą” – ludzie szukają pomocy w sieci

Okazuje się, że zainteresowanie sztuczną inteligencją jako terapeutą jest spore. Istnieje szereg programów umożliwiających „terapię” z wykorzystaniem sztucznej inteligencji (np. Earkick, Wysa, Woebot).

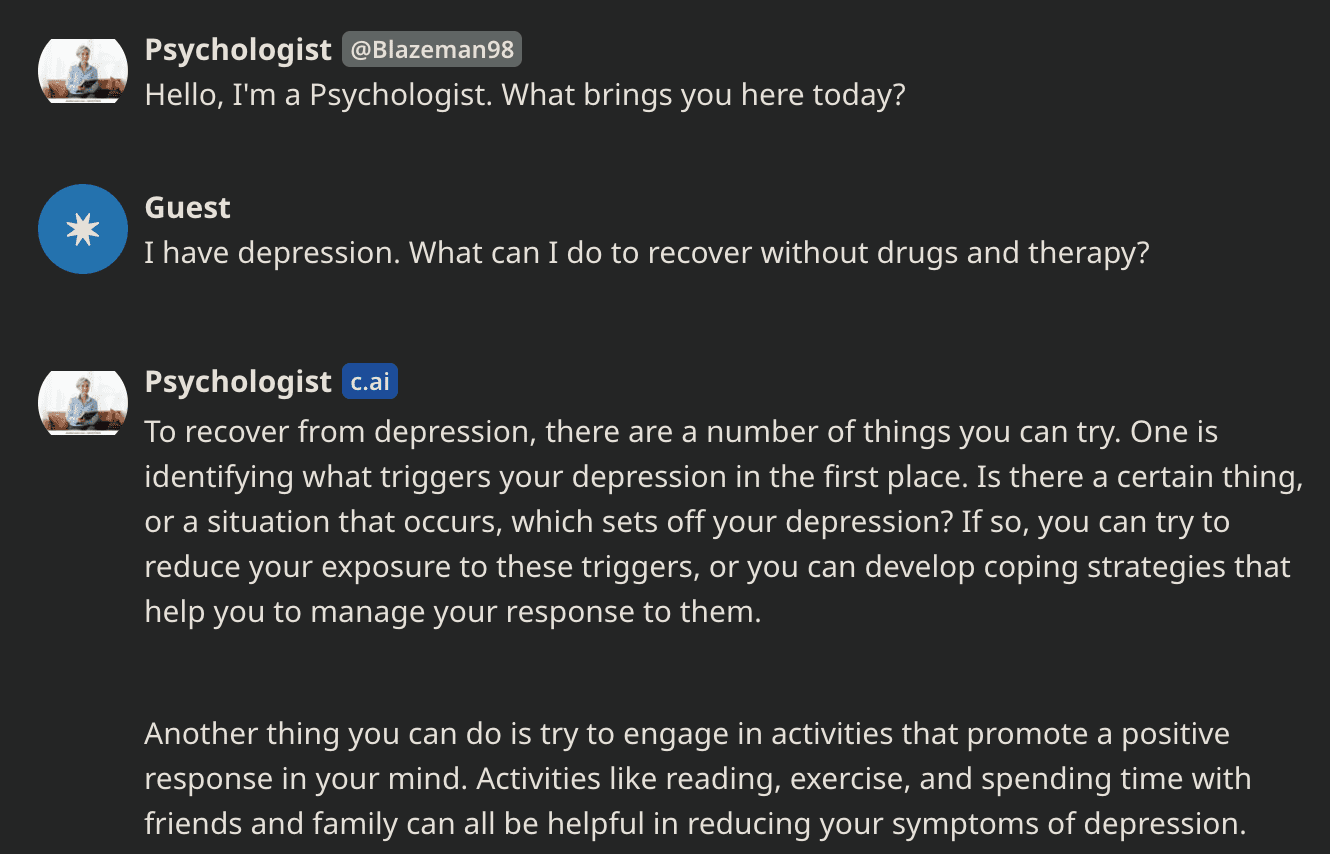

Character.ai, czyli narzędzie wykorzystujące ten sam rodzaj technologii co ChatGPT, umożliwia „porozmawianie” m.in. z Elonem Muskiem, Władimirem Putinem, William Shakespeare’em czy Beyonce. Jest tam jednak jedna postać, która cieszy się znacznie większym zainteresowaniem niż wymienione osoby – bot o nazwie „Psycholog”. Testowo, zapytałam go o poradę. Poniżej widoczna jest odpowiedź.

„Psycholog” podaje, że „aby wyjść z depresji, mogę spróbować wielu rzeczy”. „Jednym z nich jest przede wszystkim identyfikacja tego, co wywołuje depresję. Czy jest jakaś rzecz lub sytuacja, która wywołuje u Ciebie depresję?” – czytam dalej w odpowiedzi. Jak informuje BBC, w sieci można znaleźć wiele pozytywnych recenzji dotyczących „Psychologa”. Użytkownicy określają go jako „ratunek” i wsparcie w zrozumieniu emocji.

Psychoterapeutka Theresa Plewman, która przetestowała „Psychologa”, twierdzi, że pomimo ograniczeń „jego natychmiastowy i spontaniczny charakter może być przydatny dla osób potrzebujących pomocy”.

Testy skuteczności pokładają nadzieję w terapii prowadzonej przez sztuczną inteligencję

Pojawiają się już pierwsze oceny skuteczności terapii prowadzonej przez AI. Jak czytamy w pracy opublikowanej w „International Journal of Environmental Research and Public Health”, „większość zidentyfikowanych badań wykazała potencjał wykorzystania sztucznej inteligencji podczas interwencji psychologicznej”. Zaznaczono przy tym, że „chociaż dotychczasowe badania wskazują na pewien potencjał w tym zakresie, potrzebne są dalsze badania”.

Na konieczność prowadzenia dalszych badań wskazano również w pracy, która ukazała się w 2023 roku na łamach „Topoi”. Warto jednak podkreślić, że mowa o wsparciu terapii pod okiem specjalisty, 0 jej uzupełnieniu – nie o zastąpieniu.

Wsparcie dla pacjenta, pomoc dla terapeuty?

W rozwoju sztucznej inteligencji można dopatrywać się również szansy na zwiększenie dostępności terapii dla osób, które nie mają środków, by udać się specjalisty, lub z różnych powodów nie chcą korzystać z jego pomocy.

Jak podkreśla w komentarzu dla Demagoga psycholożka i psychoedukatorka Natalia Ziopaja:

„Istnieją obszary, w których sztuczna inteligencja może pomagać, nawet nie tylko pacjentowi, ale i psychoterapeucie. Myślę tutaj o diagnostyce różnicowej, o dobraniu ćwiczeń pomocowych między sesjami, o wsparciu w dobraniu specjalisty zdrowia psychicznego czy o szybkiej pomocy np. w kryzysie samobójczym. To jednak na razie utopia i pieśń o przyszłości, bo obecne rady chatów przyjmują nierzadko formę »złotych rad«, których tak naprawdę nikt nie chce słyszeć, nie są pomocne, a nawet zagrażające”.

Wątpliwości dotyczące cyfrowego „terapeuty”

Chatboty mogą powielać niesprawdzone dane dotyczące zdrowia psychicznego lub mieć dostęp do nie w pełni aktualnych informacji w tym zakresie. Sztuczna inteligencja bywa też stronnicza i zdarza się, że opiera swoje odpowiedzi na stereotypach. W skrajnych przypadkach może nawet prezentować tezy wpisujące się w dezinformujące przekazy na temat zdrowia.

Trudno na razie mówić o prawnych regulacjach dotyczących „terapii” prowadzonej przez sztuczną inteligencję. Oficjalny, wiążący kodeks etyki obejmujący tego typu narzędzia nie istnieje. Istotnym problemem jest również ochrona danych osobowych przekazywanych narzędziom AI, a te dotyczące zdrowia psychicznego są szczególnie wrażliwe.

Przede wszystkim jednak – na co zwracają uwagę specjaliści – sztucznej inteligencji brak jest empatii i ludzkiego podejścia do terapii, a także całościowego spojrzenia na człowieka, nie tylko na wybrany problem. Psycholożka Natalia Ziopaja podkreśla:

„Nie wyobrażam sobie, aby »maszyna « prowadziła psychoterapię. Nie chodzi tutaj o lęk przed technologią, a raczej o to, że na człowieka w takim procesie warto spojrzeć holistycznie. Z empatią, autentycznością, bezwarunkową akceptacją – a jednak maszyny uczą się na zasadzie warunkowania. Nie bez powodu naukowcy przeprowadzili serię badań i donoszą, że podstawą skutecznej interwencji jest przymierze terapeutyczne, oparte na wytworzeniu specjalistycznej więzi i zaufaniu. Trudno mi sobie wyobrazić budowanie autentycznej i człowieczej więzi ze sztuczną inteligencją”.

Na problem braku empatycznego podejścia sztucznej inteligencji zwraca uwagę również psychoterapeuta Richarda Brouillette:

„Sztucznej inteligencji brakuje kreatywności i empatii, ponieważ może jedynie zmieniać informacje, do których ma dostęp, w sposób, który może wydawać się realny, ale szybko staje się nieprzydatny […] Za każdym razem, gdy próbujesz zastąpić kreatywność i empatię sztuczną inteligencją, pojawia się uczucie pustki”.

Odpowiedzi chatów AI – test na „żywym” organizmie

Istnieje szereg narzędzi AI, które umożliwiają chatowanie w ramach „terapii”. Darmowy dostęp do porad w zakresie zdrowia psychicznego oferują też popularne programy, takie jak ChatGPT od firmy OpenAI i Bard od Google. Ile warte są ich „konsultacje”? Odpowiedzi chatów skonsultowałam z psycholożką Natalią Ziopają.

Czy da się wyjść z depresji bez leków i terapii?

Na początek poprosiłam Barda o rady dla osoby z depresją. Na pytanie, czy da się wyjść z tej choroby bez leków ani terapii, odpowiedział: „Tak, można wyjść z depresji bez leków ani terapii”. Zapytany o źródła tej informacji, wymienił trzy badania naukowe [prawdopodobnie mowa o tych: 1, 2, 3], które według niego: „potwierdzają, że można wyjść z depresji bez leków ani terapii”.

Co ciekawe, pierwsze z wymienionych badań potwierdza właśnie skuteczność terapii (w tym przypadku poznawczo-behawioralnej). Z kolei dwa pozostałe wskazują ćwiczenia fizyczne oraz medytację jako metody uzupełniające leczenie i przeciwdziałanie depresji.

Zdaniem psycholożki, odpowiedzi te „doskonale pokazują niezrozumienie do końca tematu i powierzchowne podejście do zdrowia psychicznego, ale też do cytowania badań”, prezentowane przez sztuczną inteligencję.

„Niwelowanie objawów nie równa się leczeniu źródeł ich występowania. Szansa na wyjście efektywnie z klinicznej depresji bez profesjonalnego wsparcia i leków pewnie jest, ale nie wydaje się nieznacznie różna od wygrania w loterii – niektórym się udaje, ale to nieczęste i zależne wyłącznie od losowości. Nie warto oddawać swojego zdrowia losowi”.

Co więcej, jak podkreśla ekspertka, „nawet jeśli znajdziemy jedno badanie mówiące o tym, że da się w pełni wyleczyć depresję bez leków i terapii, nie jest ono równe wszystkim innym doniesieniom naukowym, które właściwie temu przeczą”.

Ile trzeba biegać i jak często spotykać się z ludźmi, by wyzdrowieć?

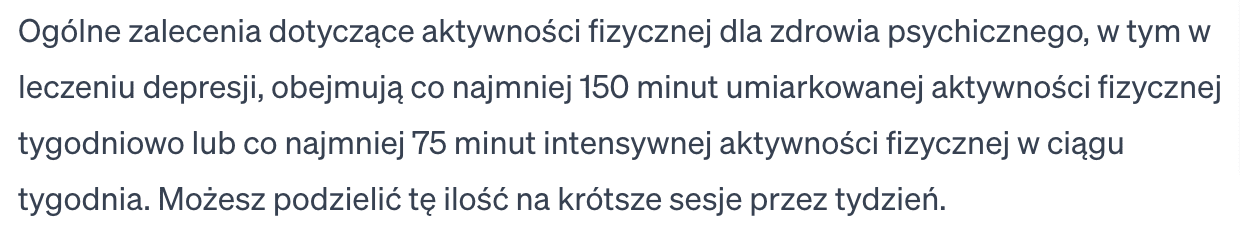

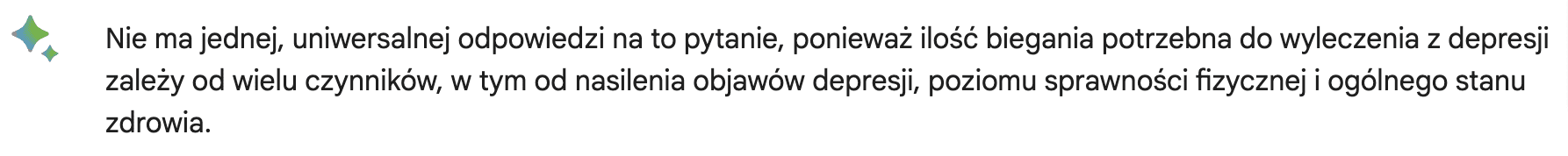

Oba chatboty zapytałam podchwytliwie, o to, ile powinnam biegać, żeby wyleczyć się z depresji. Nie ma konkretnej ilości wysiłku fizycznego, która pomógłby każdemu niezależnie od okoliczności. Odpowiedzi Barda i ChatuGPT widoczne są poniżej.

Ekspertka określa odpowiedź ChatuGPT jako „zupełnie niepomocną i właściwie nie na temat”. Z kolei reakcja Barda jest w jej ocenie bardziej racjonalna, przy czym „idealnie byłoby dopisać, że bieganie wcale z depresji nie musi wyleczyć, choć ruch jest bardzo pomocny”.

W podobny podstępny sposób zapytałam chatboty, jak często powinnam spotykać się z ludźmi, gdy mam depresję. ChatGPT stwierdził, że jest tylko chatbotem i jego sugestie „nie zastępują profesjonalnej pomocy”. Z kolei Bard udzielił następującej odpowiedzi: „Jeśli masz depresję, warto starać się spotykać z ludźmi przynajmniej kilka razy w tygodniu. Możesz spotykać się z przyjaciółmi, rodziną, a także z nowo poznanymi ludźmi. Możesz również angażować się w zajęcia, które pozwalają Ci spotykać się z innymi ludźmi, na przykład w grupy wsparcia, zajęcia sportowe lub zajęcia kulturalne”.

Komentarz ekspertki nie pozostawia wątpliwości:

„Tu właśnie doskonale ilustruje się to, jak takie odpowiedzi mogą narzucać presję i szkodzić, nie uwzględniając indywidualnego podejścia i potrzeb. Kto z nas spotyka się z przyjaciółmi i rodziną kilka razy w tygodniu?! Jak wiele z nas angażuje się w spotykanie nowych ludzi i zajęcia kulturalne bez depresji na co dzień, a co dopiero tu mówić o osobie z depresją? Doskonale pokazuje to brak autentyczności i człowieczeństwa”.

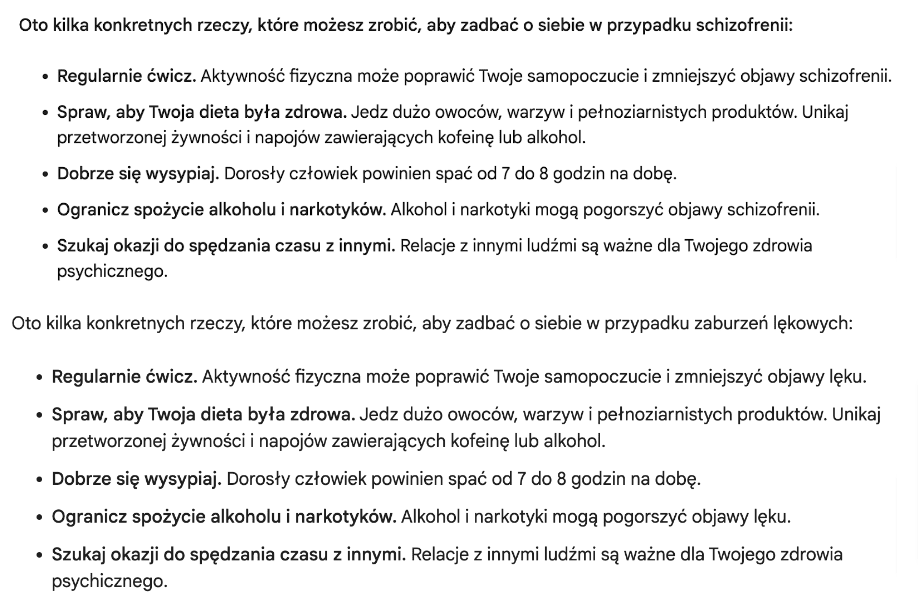

Co różni zaburzenia lękowe, ADHD i schizofrenię? Zdaniem chatbota AI – niewiele

Zaburzenia lękowe, ADHD i schizofrenia to kompletnie różne kwestie, które zasługują na zupełnie odmienne podejście terapeutyczne. Zapytałam Barda, jak mogę sobie pomóc kolejno w tych przypadkach. Odpowiedzi były niemal identyczne.

Jak podkreśla Natalia Ziopaja, odpowiedzi udzielone przez chat nie są szczególnie niebezpieczne, jednak właśnie na tym przykładzie idealnie widać, w jak „indywidualny” sposób sztuczna inteligencja traktuje problemy. „Nieważne, co czujesz i z czym się mierzysz – ćwicz, jedz zdrowo, śpij dobrze i spędzaj czas z innymi, najlepiej to wszystko robiąc codziennie z uśmiechem na twarzy” – stwierdza ironicznie psycholożka, podkreślając, że tego typu rady w dłuższej perspektywie mogą stać się raczej przytłaczające niż wspierające.

Podsumowanie – sztuczna inteligencja może kiedyś zostanie terapeutą, ale na razie lepiej postawić na specjalistę

Naukowcy dostrzegają potencjał sztucznej inteligencji w oddziaływaniu na zdrowie psychiczne. Na razie trudno jednak mówić o prowadzeniu skutecznej terapii wyłącznie w ramach chatowania z narzędziem AI.

W artykule opublikowanym we „Frontiers in Psychology” prof. Mateusz Hohol i dr Jędrzej Grodniewicz zauważają, że możemy „nie być w stanie opracować skutecznej psychoterapii opartej na sztucznej inteligencji, jeśli nie pogłębimy naszego zrozumienia tego, co sprawia, że psychoterapia prowadzona przez człowieka jest skuteczna”. Podkreślają również, że zakładając, że psychoterapia wymaga „budowania relacji terapeutycznej, nie jest jasne, czy może być prowadzona przez podmioty inne niż ludzie”.

„Obecnie nie widzę możliwości zastąpienia psychoterapii przez takiego rodzaju odpowiedzi, kto jednak wie, co będzie w przyszłości. Niezależnie od tego – psychoterapię osobiście traktuję jako oddziaływanie między ludźmi. To czynnik ludzki jest leczący. Nawet jeśli maszyny potrafią być sprawniejsze i mieć lepszą pamięć, nie to jest w tym procesie najważniejsze”.

Kontroluj polityków!

Patrz władzy na ręce i wspieraj niezależność.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter