Analiza

Omawiamy ważne fakty dla debaty publicznej, a także przedstawiamy istotne raporty i badania.

„Facebook Files”, czyli o tym, czego Facebook nie chciał nam powiedzieć

„The Wall Street Journal” dotarł do dokumentów pochodzących od byłej pracownicy Facebooka, Frances Haugen, nazywanych „Facebook Files”. Dowodzą one, że platforma Marka Zuckerberga świadomie podejmuje decyzje mające negatywne skutki społeczne, daleko wykraczające poza samą platformę.

„Facebook Files”, czyli o tym, czego Facebook nie chciał nam powiedzieć

„The Wall Street Journal” dotarł do dokumentów pochodzących od byłej pracownicy Facebooka, Frances Haugen, nazywanych „Facebook Files”. Dowodzą one, że platforma Marka Zuckerberga świadomie podejmuje decyzje mające negatywne skutki społeczne, daleko wykraczające poza samą platformę.

Od 13 września 2021 roku „The Wall Street Journal” publikuje dokumenty, które dostarczyła im była pracownica jednostki ds. uczciwości obywatelskiej w Facebooku. Frances Haugen odpowiadała za tworzenie zespołu, którego celem miało być m.in. redukowanie zagrożeń dla demokratycznych mechanizmów i procesu wyborczego, spowodowanych dezinformacją szerzącą się na Facebooku. Haugen zajmowała się głównie projektowaniem algorytmów kierujących mediami społecznościowymi, a przed pracą dla Facebooka była zatrudniona w Google, Pintereście i Yelpie.

Po przywróceniu poprzednich ustawień algorytmów Facebooka, które de facto oznaczały rezygnację z kroków mających na celu poprawę bezpieczeństwa związanego z naruszeniem demokratycznych zasad, zdecydowała się odejść w maju br. Jak twierdzi, zorientowała się, że – aby uratować platformę – musi poszukiwać pomocy w zewnętrznych podmiotach. Wtedy zdecydowała się na przeszukanie wewnętrznych materiałów Facebooka i przedstawienie sytuacji prawnikom oraz państwowym organom.

Dokumenty ujawniane przez „The Wall Street Journal” znane są jako „Facebook Files”. Poniżej przedstawiamy najważniejsze wnioski płynące z pierwszych 10 części publikacji.

AKTUALIZACJA 18.11

Analiza została zaktualizowana o odpowiedzi udzielone przez biuro prasowe Meta (dawniej Facebook), które wyrażają stanowisko firmy w sprawie publikacji The Wall Street Journal.

1. Facebook twierdzi, że ma równe reguły dla wszystkich. Wewnętrzne dokumenty firmy odkrywają, że istnieje ekskluzywna elita.

Mimo że Facebook powinien mieć równe standardy i zasady dla wszystkich użytkowników, „Facebook Files” dowodzą, że istnieje grupa celebrytów i influencerów wyłączonych spod uniwersalnych reguł platformy. Według pozyskanych przez „The Wall Street Journal” dokumentów istnieje specjalny program „cross check” lub „XCheck”, który chroni miliony elitarnych użytkowników przed standardową moderacją Facebooka.

Wobec kont osób zaliczanych do tej grupy czynione są wyjątki, a kontrowersyjne treści ich autorstwa nie są natychmiast kasowane. Do osób tych należały konta m.in.: piłkarza Neymara, Donalda Trumpa i jego syna Donalda Trumpa Jr., Marka Zuckerberga czy prawniczki Elizabeth Warren. Jedną z największych opisywanych kontrowersji jest udostępnienie przez Neymara korespondencji zawierającej nagie zdjęcia kobiety, która oskarżyła go o gwałt. Przez ponad 24 godziny system „XCheck” blokował moderatorów przed możliwością usunięcia udostępnionego nagrania wideo.

Stanowisko Mety w sprawie krytyki mechanizmu „cross check”

„Szanujemy krytykę mechanizmu, ale system cross-check został zaprojektowany z ważnego powodu: jest to dodatkowy mechanizm, dzięki któremu możemy precyzyjnie egzekwować zasady dotyczące treści, które wymagają dogłębnego zrozumienia kontekstu. Może to dotyczyć aktywistów podnoszących świadomość na temat przejawów przemocy lub dziennikarzy relacjonujących ze stref konfliktu. Wiele z udostępnionych wewnętrznych materiałów to nieaktualne informacje połączone w celu stworzenia narracji, w której pomija się najważniejszy punkt: Meta sama zidentyfikowała problemy z mechanizmem cross-check i pracuje nad ich rozwiązaniem. Poczyniliśmy inwestycje, zbudowaliśmy dedykowany zespół i przebudowaliśmy cross-check, aby usprawnić działanie systemu”.

Biuro prasowe Mety

Biuro załączyło również dodatkowe informacje w postaci:

- Komunikatu prasowego Nicka Clegga – prezentującego wniosek Mety o wydanie przez Radę Kontrolną (Oversight Board) opinii doradczej (PAO) w sprawie cross-check.

- Komunikatu prasowego Moniki Bickert, „Working to Keep Facebook Safe”, po raz pierwszy publicznie przedstawiającego cross-check od strony technicznej.

2. Facebook wiedział, że Instagram jest toksyczny dla nastolatek

Analitycy Instagrama (należącego do Facebooka) od lat badali, w jaki sposób aplikacja wpływa na swoich użytkowników i użytkowniczki. Wyniki ich badań świadczą o tym, że firma miała pełną świadomość negatywnego wpływu aplikacji na stan psychiczny jej odbiorców. Mimo to Facebook publicznie bagatelizował problem i nie upubliczniał badań oraz nie udostępniał ich na prośby zainteresowanych badaczy lub prawodawców. Z kolei sam Mark Zuckerberg podczas zeznań przed Kongresem Stanów Zjednoczonych, 25 marca 2021 roku, stwierdził, że z badań, które są mu znane, wynika, że korzystanie z aplikacji społecznościowych ma pozytywny wpływ na psychikę użytkowników.

Według wewnętrznych badań Facebooka głównym powodem złego stanu psychicznego i negatywnego odbioru własnego ciała są nierealistyczne, wyidealizowane i kulturowo uwarunkowane standardy piękna, których uzyskanie na zdjęciach ułatwiają instagramowe filtry. Statystyki prezentują się następująco:

- u 32 proc. dziewcząt, które czuło się źle w swoim ciele, korzystanie z Instagrama potęgowało negatywne stany psychiczne,

- 17 proc. dziewcząt ma zaburzenia odżywiania, tj. anoreksję lub bulimię,

- 13,5 proc. nastoletnich użytkowniczek miewa myśli samobójcze.

Chyba najbardziej tragicznym wnioskiem z badań jest to, że korzystanie z Instagrama pogłębia stany depresyjne młodych kobiet, które korzystają z aplikacji coraz częściej, wpadając w spiralę uzależnienia. Pomimo tej wiedzy Facebook pracował nad aplikacją Instagram Kids, której projekt – po fali krytyki związanej z wyciekiem „Facebook Files” – finalnie zawiesił.

Meta odniosła się również do tej kwestii. Ich komentarz znajdziesz w punkcie 7. Dokumenty Facebooka – Instagram wśród nastolatków.

3. Facebook próbował uczynić swoją platformę zdrowszą – zamiast tego stała się bardziej agresywna

Facebook miał zmniejszyć niepokoje, a zwiększył podziały. Po wydarzeniach związanych z Cambridge Analytica oraz krytyką, która dotknęła Facebooka, Mark Zuckerberg podjął kluczową decyzję dotyczącą zmiany algorytmów. Krytyka dotyczyła głównie wykorzystywania algorytmów Facebooka przez zewnętrzne firmy, które dokonywały „manipulacji wyborczych”.

Zmiana miała polegać na zwiększeniu nacisku na wyświetlanie treści pochodzących od znajomych i rodziny, jednocześnie zmniejszając widoczność treści pochodzących od profesjonalnych wydawców czy instytucji. Celem nowych rozwiązań miała być redukcja polaryzacji oraz promowanie „istotnych interakcji społecznych”.

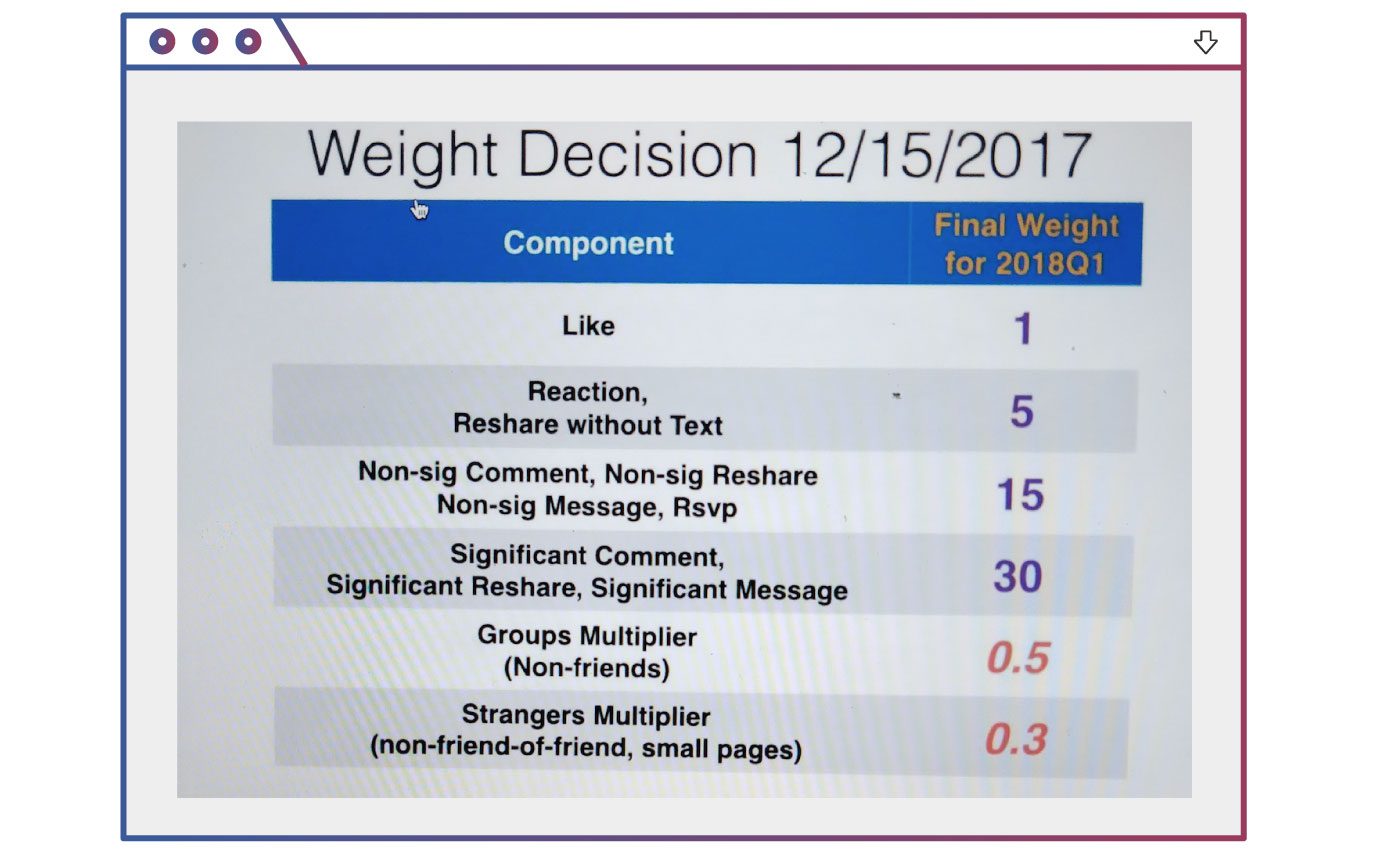

Wbrew oficjalnym stanowiskom Facebooka dość szybko okazało się, że było dokładnie odwrotnie. Algorytmy promowały agresywne, nienawistne i sensacyjne posty, które zebrały największą liczbę reakcji i komentarzy. Polubienia przestały być głównym motorem napędowym doboru treści.

Zatem żarliwe dyskusje, które powodowały więcej reakcji (nie polubień) oraz skrajnych komentarzy stały się lepiej widoczne i prezentowane większej liczbie użytkowników. Można powiedzieć, że szkodliwe spory, zamiast toczyć się w zakamarkach Internetu, odbywały się na oczach wszystkich. Z jednej strony działanie to zwiększa nasz kontakt ze sferą polityczną (co może okazać się wartościowe), z drugiej jednak każe opowiedzieć się po którejś ze stron, zająć jakieś stanowisko.

Wewnętrzna notatka Facebooka z grudnia 2017 roku zatytułowana „Historia wyprowadzania wag wskaźników znaczących interakcji społecznych (badania UX i nauka o danych)”. Źródło: „The Wall Street Journal”

Po ujawnieniu tych treści przez „The Wall Street Journal” analitycy Facebooka zaproponowali zmniejszenie nacisku na tzw. wiralowość treści. Jednak zmiany zostały wprowadzone jedynie w Etiopii i Birmie, gdzie platformie zarzucano podżeganie do przemocy etnicznej. W innych krajach zmian nie wprowadzono.

Jak pisze „The Wall Street Journal”, z dokumentów wynika, iż zmiany te miały również zasadniczy wpływ na sytuację związaną z debatą polityczną w Polsce. W dokumentach „Facebook Files” znajdują się zapiski dotyczące kontaktu polskich partii politycznych (nie wiadomo, których ani z której strony sceny politycznej) narzekających, że debata stała się „bardziej paskudna”.

Stanowisko Mety w sprawie roli mediów społecznościowych w polaryzacji debaty

„Wzrost polaryzacji był w ostatnich latach przedmiotem poważnych badań akademickich, które nie przyniosły jednak jednoznacznych wniosków. Dostępne argumenty nie potwierdzają tezy, że Facebook, czy ogólnie media społecznościowe, są główną przyczyną polaryzacji. Wzrost polaryzacji politycznej poprzedza media społecznościowe o kilka dekad. Gdyby Facebook faktycznie był główną przyczyną polaryzacji, należałoby się spodziewać, że wzrośnie ona wszędzie tam, gdzie Facebook jest popularny. Tak jednak nie jest. W rzeczywistości, polaryzacja spadła w wielu krajach o wysokim wykorzystaniu mediów społecznościowych w tym samym czasie, gdy wzrosła w innych krajach”.

Biuro prasowe Mety

Meta odnosząc się do tej kwestii przytoczyła również artykuł Nicka Clegga: You and the Algorithm, it takes two to tango, a także badania, które zdaniem firmy sugerują, że Facebook nie jest głównym motorem polaryzacji.

- Badania akademickie pokazują, że wzrost polaryzacji politycznej w USA poprzedza media społecznościowe o kilka dekad (Uniwersytet Stanforda).

- Lokalne badania i analizy przeprowadzone w Polsce pokazują, że polaryzacja w naszym kraju jest zakorzeniona w strukturach społecznych i ekonomicznych i sugerują, że nie ma wyraźnego związku między mediami elektronicznymi a polaryzacją. (Źródła: 1, 2, 3).

4. Pracownicy Facebooka zgłaszali kartele narkotykowe i handel ludźmi. Dokumenty pokazują, że reakcja platformy nie była wystarczająca

Ta sprawa wyszła na jaw już w 2019 roku po śledztwie BBC News Arabic, z którego mogliśmy dowiedzieć się, że na Facebooku prężnie działa czarny rynek handlu pracownicami i pracownikami domowymi, sprowadzanymi przy użyciu mediów społecznościowych na Półwysep Arabski. Oferty pracy publikowane były na Instagramie głównie w języku arabskim, a następnie udostępniane przez użytkowników z Arabii Saudyjskiej i Kuwejtu. Z dokumentów opublikowanych przez „The Wall Street Journal” wynika, że Facebook wiedział o nielegalnych praktykach jeszcze przed śledztwem BBC.

Po publikacji BBC Facebook zakazał głównego hashtagu używanego do handlu kobietami, a na samym Instagramie wykryto łącznie 300 tys. przypadków potencjalnych naruszeń, usunięto ponad 1 000 kont, a w kolejnych miesiącach usunięto 130 tys. podejrzanych treści. Niestety, platforma nie zrobiła tego z własnej woli. Dokumenty przedstawione przez „The Wall Street Journal” świadczą o tym, że Facebook dość długo podejmował w tej sprawie jedynie „ograniczone działania”. Platforma ugięła się dopiero pod naciskami Apple Inc., które zagroziło usunięciem aplikacji z App Store, jeśli Facebook nie rozwiąże problemu związanego z handlem ludźmi.

Stanowisko Mety w sprawie działań firmy:

„Kategorycznie zakazujemy wszelkich przejawów wykorzystywania ludzi. Walczymy z handlem ludźmi na naszej platformie od wielu lat i naszym celem pozostaje zablokowanie dostępu do naszych platform każdemu, kto ma na celu wykorzystywanie innych ludzi”.

Biuro prasowe Mety

5. Jak Facebook osłabił chęć Marka Zuckerberga do zaszczepienia Ameryki

W połowie marca br. Mark Zuckerberg ogłosił, że jednym z głównych priorytetów Facebooka jest promowanie szczepionek przeciwko koronawirusowi, co miało potwierdzić, że platforma przyczynia się do dobra publicznego. Według „The Wall Street Journal” ostatecznie doszło do tego, że antyszczepionkowi aktywiści zalali portal treściami określanymi przez moderatorów jako „bariera dla szczepień”. Wykorzystali oni platformę do zasiania wątpliwości co do skali pandemii oraz potrzeby szczepień. Na problem z fałszywymi treściami na Facebooku zwróciła również uwagę administracja Bidena, jednak problemu nie udało się wyeliminować.

Stanowisko Mety w sprawie walki z dezinformacją o szczepieniach

“Od początku pandemii naszym celem jest dbanie o bezpieczeństwo użytkowników poprzez dostarczanie im wiarygodnych informacji o COVID-19, walka z dezinformacją i zachęcanie ludzi do szczepień.

Cieszymy się z tego, że w tym roku opór przed szczepieniami wśród użytkowników Facebooka w Stanach Zjednoczonych zmalał o 50%, a szczepienia cieszą się wysokim poparciem.

Walka z dezinformacją wymaga zróżnicowanych działań, dlatego też podejmujemy złożone kroki w tym celu – usunęliśmy ponad 20 milionów treści, które łamią nasze zasady dotyczące fałszywych informacji na temat COVID-19, nakładamy permanentne blokady na konta osób, które wielokrotnie naruszają politykę serwisu, połączyliśmy ponad dwa miliardy ludzi z wiarygodnymi informacjami na temat COVID-19, a także współpracujemy z niezależnymi fact-checkerami z całego świata, mówiącymi w ponad 60 językach, w celu weryfikowania fałszywych treści”

Biuro prasowe Mety

Jednym z partnerów Mety w tym zakresie jest Stowarzyszenie Demagog. Z naszymi analizami weryfikującymi fake newsy zamieszczane na portalu Facebook możesz zapoznać się tutaj.

6. Starania Facebooka w celu przyciągnięcia dzieci wykraczają poza Instagram Kids

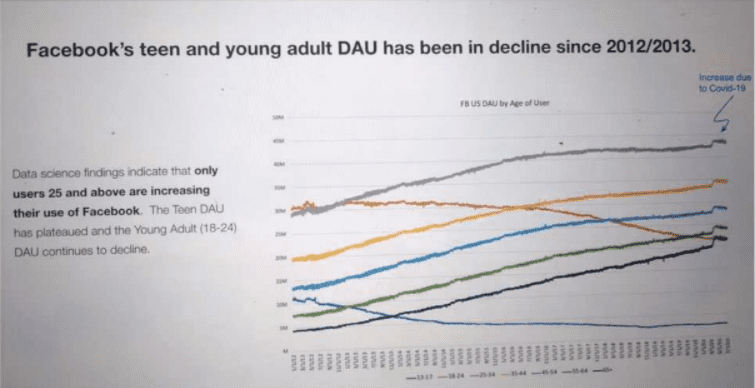

Z wewnętrznych materiałów Facebooka przygotowanych przez Haugen i dołączonych do jej zeznań przed komisją senacką wynika, że platforma systematycznie traci zainteresowanie wśród użytkowników poniżej 25. roku życia. Fakt ten powodował lęk przed utratą grona użytkowników, którzy są kluczowi dla przyszłości platformy. W związku z tym Facebook od lat śledzi sposób, w jaki młodzi użytkownicy korzystają z nowych technologii.

Problem jednak leży w tym, że aby korzystać z platformy, użytkownik musi ukończyć 13. rok życia. Prawo federalne zabrania ponadto zbierania danych osobowych osób, które nie ukończyły tego wieku. Dokumenty przedstawiane przez „The Wall Street Journal” świadczą jednak o tym, że Facebook od dłuższego czasu bada sposoby, dzięki którym może pozyskać użytkowników poniżej tego wieku.

Jednym z proponowanych podejść jest to, by – zamiast oferować tylko dwa rodzaje produktów: te dla użytkowników w wieku 13 lat i starszych oraz aplikację komunikatora dla dzieci – Facebook powinien dostosowywać swoje funkcje do sześciu różnych przedziałów wiekowych (dorosłych, późnych nastolatków w wieku od 16 do dojrzałości, nastolatków w wieku od 13 do 15 lat, nastolatków w wieku od 10 do 12 lat, dzieci w wieku od 5 do 9 lat i małych dzieci w wieku od 0 do 4 lat).

7. Dokumenty Facebooka – Instagram wśród nastolatków

Po burzy, jaką wywołały pierwsze materiały pod hasłem „Facebook Files”, opublikowane przez „The Wall Street Journal”, Facebook został wezwany do zeznań przed senacką podkomisją ds. ochrony konsumentów. Dwanaście dni po ukazaniu się pierwszego artykułu Facebook opublikował na swoim blogu odpowiedź na krytykę, która wylała się na platformę po tej publikacji.

We wpisie możemy przeczytać, że w gruncie rzeczy wiele młodych użytkowniczek „czuje, że korzystanie z Instagrama pomaga im zmagać się z trudnymi chwilami i problemami, z jakimi borykają się nastolatki”. W reakcji na to „The Wall Street Journal” opublikowało screeny dokumentów, które udało im się zdobyć:

- Obraz ciała nastoletnich dziewcząt i porównanie społeczne na Instagramie – badanie eksploracyjne w USA,

- Zdrowie psychiczne nastolatków – badanie pogłębione,

- Porównanie społeczne na podstawie wyglądu zewnętrznego,

- Porównanie społeczne: tematy, celebryci, liczenie lajków, selfie,

- Ustalenia dot. zdrowia psychicznego,

- Młodzi i nastolatkowie na IG & FB.

Stanowisko Mety w kwestii szkodliwości Instagrama

„Nasze badania nie wykazały, że Instagram jest jednoznacznie zły dla nastolatków.

To prawda, że część młodych ludzi przyznała, że korzystanie z Instagrama pogarsza ich samopoczucie, gdy zmagają się z takimi problemami jak samotność, niepokój i smutek, jednak większość przebadanych nastolatków stwierdziła, że dzięki Instagramowi czują się lepiej, gdy doświadczają wspomnianych problemów.

Chcemy jednak pomóc tym, którzy zmagają się z tego typu trudnościami. Prowadzimy szeroko zakrojone działania w zakresie zwalczania przemocy, zapobiegania samobójstwom i samookaleczeniom oraz zaburzeniom odżywiania.

Opracowujemy obecnie nowe rozwiązania, które pomogą osobom doświadczającym negatywnych skutków porównań społecznych lub borykających się z problemem negatywnego wizerunku ciała.

Nieustannie szukamy możliwości współpracy z większą liczbą partnerów, aby udostępniać niezależne badania w tej dziedzinie, a także pracujemy nad tym, by umożliwić zewnętrznym badaczom szerszy dostęp do naszych danych w sposób zapewniający poszanowanie prywatności”.

Biuro prasowe Mety

W odpowiedzi przesłano również dodatkowe źródła:

- Adam Mosseri (szef Instagrama) w Today Show

- Informacja prasowa: Pausing “Instagram Kids” and Building Parental Supervision Tools

- Informacja prasowa: What Our Research Really Says About Teen Well-Being and Instagram

8. Czy moc Sheryl Sandberg się kurczy? Dziesięć lat istnienia danych Facebooka daje wskazówki

„The Wall Street Journal” dokonał przeglądu corocznych list pracowników Facebooka z ostatnich 10 lat. Dzięki zebranym danym dziennikarze ustalili, które sektory rozwijały się najszybciej, dzięki czemu odtworzyli obraz priorytetów firmy i elementów, na które kładziony jest największy nacisk. Wynika z nich, że zespół należący do Javiera Olivana, zajmujący się analizowaniem treści i powiększaniem grona użytkowników, w ostatnim okresie odnotował największy przyrost kierowników raportujących bezpośrednio przed Zuckerbergiem. Zespół Oliviana monitoruje kontrowersyjne treści oraz opracowuje narzędzia minimalizujące widoczność postów, których użytkownicy nie chcą widzieć.

Z kolei Sheryl Sandberg, która jest dyrektorem operacyjnym i od dawna postrzegana jest jako druga po Zuckerbergu, w ostatnich latach odnotowała spadek liczby podległych sobie pracowników. Jednak w ciągu ostatniego roku zespół prawników, będący częścią jej zespołu, rósł o ok. 60 proc. szybciej niż w innych działach firmy, ponieważ Facebook zmaga się z wyzwaniami antymonopolowymi, procesami prawnymi akcjonariuszy i innymi problemami prawnymi.

9. Frances Haugen, informatorka Facebooka mówi, że chce naprawić firmę, a nie zaszkodzić jej

Dwa ostatnie artykuły poświęcone są przyszłości Facebooka i podjęciu działań, które mogłyby w jakiś sposób przyczynić się do naprawy słabości giganta mediów społecznościowych.

Zdaniem Haugen nadzieja leży w rozpowszechnieniu wewnętrznych informacji o Facebooku poza firmą. Jej głównym celem było poinformowanie pracowników i organów państwowych, które mogłyby w jakiś sposób wpłynąć na sytuację. Haugen stwierdziła również, że jest chętna do kooperacji z organami regulacyjnymi w Europie, co doprowadziło do zaproszenia jej na przemówienie przed Parlamentem Europejskim, które odbędzie się 8 listopada.

10. Według Facebooka AI będzie w stanie posprzątać platformę – jej inżynierowie mają wątpliwości

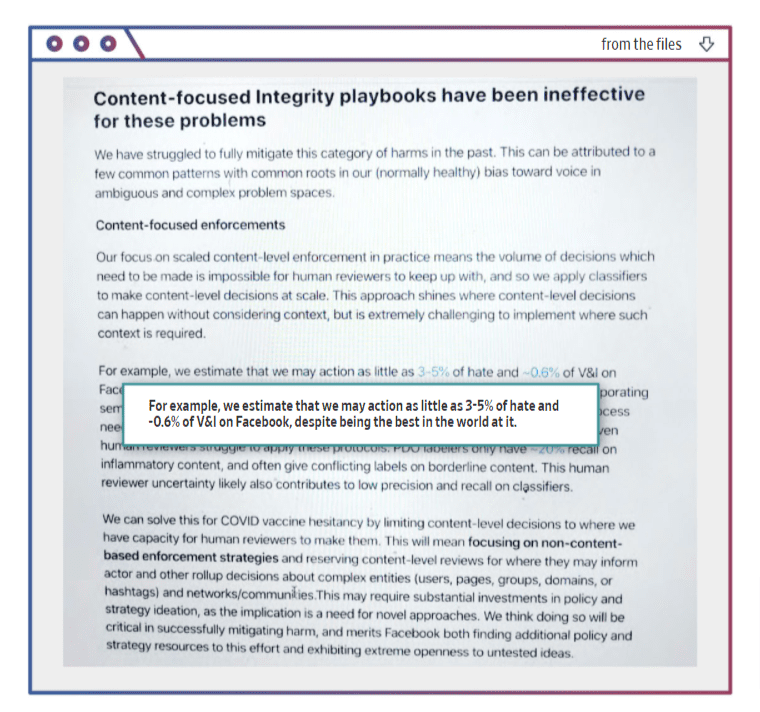

Wielu z menedżerów Facebooka postuluje, iż sztuczna inteligencja (AI) rozwiąże chroniczne problemy związane z mową nienawiści i nadmierną przemocą na platformie. Dokumenty przedstawiane przez „The Wall Street Journal” dowodzą jednak, że na pewno nie stanie się to w najbliższej przyszłości. Sztuczna inteligencja wciąż boryka się z niedoskonałościami (takimi jak brak rozumienia kontekstu treści zarówno wizualnych, jak i tekstowych, usuwanie jedynie fragmentów wypowiedzi czy brak umiejętności identyfikowania bezpośrednich autorów nagrań wideo kręconych „z pierwszej ręki”).

Debata dotyczy również strategii, które dobierane są do stosowania sztucznej inteligencji przy analizie treści. Co więcej, w wewnętrznym opracowaniu analitycy zwracają uwagę na fakt, iż liczba treści nieustannie rośnie, podczas gdy wykrywane nadużycia osiągają próg jedynie 5 proc. w przypadku hejtu oraz 0,6 proc. w przypadku przemocy i podżegania do niej, choć jak przyznają „i tak są w tym najlepsi na świecie”.

Stanowisko Mety w sprawie szkodliwych treści

„Oceniamy skuteczność weryfikacji treści poprzez regularne mierzenie i raportowanie naszych działań, jednocześnie minimalizując błędy w procesie usuwania treści. Inwestowanie w sztuczną inteligencję (AI) pozwala nam na ograniczenie rozpowszechniania się treści naruszających zasady platformy. Dzieje się to na kilka sposobów – sztuczna inteligencja wykrywa szkodliwe treści, przekazuje je do weryfikacji i usuwa. Pozwala to nam również na ograniczenie dystrybucji treści potencjalnie niezgodnych z regulaminem. Dzięki wykorzystaniu wszystkich tych narzędzi istotnie wpływamy na ograniczenie rozpowszechniania szkodliwych treści”.

Biuro prasowe Mety

Co nam to mówi o kondycji Facebooka?

Powodów wszystkich tych działań „The Wall Street Journal” upatruje w spadku aktywności użytkowników Facebooka i próbie przeciwdziałania kryzysowi, który w dalekiej perspektywie może dotknąć platformę. Mimo wszystko to nie motywacje firmy Zuckerberga są w tym wypadku najważniejsze. Z całej tej opowieści o działaniach Facebooka i szeregu podjętych nieodpowiednich decyzji, zaniechań i celowych zmian, które okazały się szkodliwe dla użytkowników, według Frances Haugen, płynie jeden wniosek:

Facebook kieruje się jedynie własnym interesem finansowym.

Fragment wewnętrznego raportu pt. „Szkodliwe, pozbawione przemocy narracje”, Źródło: „The Wall Street Journal”

Fakt, że jak każde przedsiębiorstwo Facebook musi na siebie zarabiać i utrzymać pracowników, raczej nie powinien dziwić. Problem jednak leży w tym, iż firma ta nie potrafi wyważyć między interesem własnym a społecznym. – Istniał konflikt interesów między tym, co było dobre społecznie, a tym, co dobre dla Facebooka. Facebook za każdym razem wybierał usprawnianie własnych interesów, takich jak zwiększanie zysków – mówiła Haugen w CBS. Wobec tego to nie bezpośrednio korzyści finansowe, ale podejmowanie biznesowych decyzji w obszarze społecznym, które przynoszą szkody, ale i społeczna ignorancja są zasadniczymi problemami, jakie uwidoczniły publikacje „Facebook Files”.

Na tym nie koniec. Wydarzenia związane z publikacją wewnętrznych dokumentów Facebooka uświadamiają nam, w jaki sposób działa świat cyfrowy i jakie płyną z tego konsekwencje. Warto mieć w świadomości, iż gigant mediów społecznościowych zrzesza 2,91 mld użytkowników na całym świecie. Niewielka zmiana w strategii działań algorytmów może skutkować społeczną destabilizacją w wymiarze globalnym. W tym wypadku drobne przesunięcia w sposobie przetwarzania informacji mają realny wpływ na politykę i społeczeństwo, a także w sposób bezpośredni mogą dotykać każdego i każdą z nas tak jak w przypadku problemów psychicznych nastolatków korzystających z Instagrama.

Stanowisko Mety w sprawie tezy o kierowaniu się przez firmę wyłącznie interesem finansowym

„U podstaw wszystkich tych pomówień leży błędne założenie. Tak, jesteśmy przedsiębiorstwem, które przynosi zysk, jednak twierdzenie, że zarabiamy kosztem bezpieczeństwa i dobrego samopoczucia ludzi, kłóci się z naszym interesem biznesowym. Tylko do końca tego roku wydamy ponad 5 miliardów dolarów na bezpieczeństwo i ochronę platform. Zatrudniamy ponad 40 tysięcy ludzi, by dbali o bezpieczeństwo użytkowników Facebooka”.

Biuro prasowe Mety

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter