Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

Pacjent kontra sztuczna inteligencja – więcej szans czy zagrożeń?

Sprawdzamy, jakie możliwości daje sztuczna inteligencja w zakresie zdrowia i jakie stwarza ryzyko.

Fot. Elf-Moondance / Pixabay / Modyfikacje: Demagog

Pacjent kontra sztuczna inteligencja – więcej szans czy zagrożeń?

Sprawdzamy, jakie możliwości daje sztuczna inteligencja w zakresie zdrowia i jakie stwarza ryzyko.

Jeden czy dwa drinki dziennie są „w porządku” dla zdrowia, żeby zachować sprawność fizyczną, należy „codziennie robić 10 tys. kroków”, a na depresję pomoże „recykling elektroniki”. To tylko niektóre z pomysłów sztucznej inteligencji (AI – artificial intelligence) dotyczących porad w zakresie zdrowia.

Przyszłość związana z wykorzystaniem narzędzi AI w medycynie maluje się raczej w jasnych barwach, jednak samodzielne korzystanie technologii, np. do autodiagnozy przez ChatbotGPT, może mieć negatywne skutki.

To pierwsza część analizy dotyczącej wpływu sztucznej inteligencji na zdrowie człowieka. Przeczytasz w niej o możliwych – z perspektywy pacjentów – zastosowaniach narzędzi opartych na AI. Dowiesz się, w czym one mogą pomóc, a na co musisz uważać. Drugą część analizy dotyczy tej samej tematyki, ale z punktu widzenia pracy medyków. Znajdziesz ją tutaj.

Krok 1. Rejestracja do lekarza

Budzisz się w nocy i zauważasz, że twoje dziecko gorączkuje. Musisz poczekać do rana, a następnie stanąć w kolejce do rejestracji. Być może będziesz próbować dodzwonić się na wiecznie zajęty numer telefonu, by zapisać małego pacjenta do pediatry na pierwszą wolną godzinę. Sztuczna inteligencja (AI) daje szansę na powstanie szybszej i łatwiejszej rejestracji do lekarza.

W Atlantic Health System, sieci opieki zdrowotnej w stanie New Jersey, funkcjonuje system rejestracji do lekarzy oparty na sztucznej inteligencji. Firma nawiązała współpracę z twórcą AI, aby pacjenci mogli samodzielnie i w bezpieczny sposób wypełnić formularz rejestracyjny przy pomocy smartfona. Podobne systemy, nieoparte na sztucznej inteligencji, istnieją zresztą od lat w różnych placówkach medycznych. Tym, co wyróżnia wspomnianą sieć z USA, jest właśnie wykorzystanie AI – system pozwala m.in. na sprawdzenie dokumentu tożsamości przy pomocy zeskanowania twarzy online, dzięki czemu pacjent otrzymuje dostęp do opieki medycznej szybciej, niż gdyby jego dane osobowe potwierdzano bezpośrednio w placówce.

Z kolei w nagłych przypadkach zdrowotnych szybka reakcja jest na wagę złotą. Pomocny okaże się program wykorzystujący sztuczną inteligencję, który ma rozpoznawać zatrzymanie akcji serca podczas połączenia alarmowego. Szybciej i skuteczniej niż dyspozytor – człowiek. Podobne rozwiązanie jest właśnie wdrażane w Walii. System działa jako asystent osób odbierających telefony alarmowe (wysłuchuje rozmów, sporządza notatki, zwraca uwagę na zagrożenia).

Krok 2. Poczekalnia

W sytuacji, gdy równocześnie w szpitalu pojawia się wielu poszkodowanych, np. po wypadku, konieczne jest ustalenie kolejności, w jakiej udzieli się im pomocy medycznej. W tym celu stosuje się tzw. segregację triage, której zadaniem jest pomoc w uratowaniu jak największej liczby pacjentów przy optymalnym wykorzystaniu mocy przerobowych medyków.

Jak podkreśla dr Marcovalerio Melis z New York University Langone Hospital System, głównym problemem związanym z obecnie funkcjonującym systemem jest podatny na błędy czynnik ludzki. Zdarza się, że pacjenta kieruje się na nadmierną liczbę badań z powodu wątpliwości lekarzy (a to kosztuje i zabiera czas medyków). Może też mieć miejsce przeciwna sytuacja – osoba, która powinna znaleźć się na oddziale intensywnej terapii medycznej, trafia na zwykły oddział, gdzie „możliwość szybkiego ratunku w pogarszającym się stanie jest opóźniona, gdyż monitorowanie (stanu zdrowia pacjenta – przyp. Demagog) nie jest tak intensywne”.

Jak się okazuje, elektroniczny systemu segregacji (e-triage) oparty na uczeniu maszynowym trafniej klasyfikuje pacjentów i wyznacza ich kolejność do udzielenia opieki medycznej w momencie, gdy konieczne jest ustalenie takiej segregacji. Wyniki testów pokazują, że technologia ta sprawdza się m.in. w przypadku pacjentów z ostrym bólem klatki piersiowej czy brzucha.

Krok 3. Wchodzimy do gabinetu?

Powszechne wykorzystanie sztucznej inteligencji może prowadzić do tego, że w niektórych sytuacjach faktyczna obecność w gabinecie lekarskim nie będzie konieczna.

W tym kontekście należy podkreślić istnienie pewnego ryzyka, np. może powstać dwutorowy system opieki medycznej: osobno dla ludzi z zasobami finansowymi i oddzielnie dla tych, których na nią nie stać. Na takie niebezpieczeństwa zwraca uwagę Meredith Broussard, ekspertka ds. sztucznej inteligencji, która podkreśla, że „jeśli bardzo zamożna osoba mówi: »Hej, możesz mieć sztuczną inteligencję do opieki zdrowotnej, a my zatrzymamy lekarzy dla siebie«, jawi się to jako problem, a nie krok w stronę lepszego świata”.

W ten sposób ekspertka odniosła się do tweeta Sama Altmana, współzałożyciela OpenAI, czyli firmy odpowiedzialnej za ChatGPT. Upatruje on w sztucznej inteligencji szansę m.in. na rozwój doradztwa medycznego dla osób, których nie stać na profesjonalną opiekę.

these tools will help us be more productive (can't wait to spend less time doing email!), healthier (AI medical advisors for people who can’t afford care), smarter (students using ChatGPT to learn), and more entertained (AI memes lolol).

— Sam Altman (@sama) February 19, 2023

Krok 4. Diagnoza

A może z własnej woli całkowicie pominiemy uciążliwą rejestrację? Porzucimy czekanie w kolejce i opowiadanie lekarzowi o wstydliwych dolegliwościach? Alternatywa: skorzystanie z powszechnie dostępnych narzędzi wykorzystujących sztuczną inteligencję. Zero stresu, zero czekania, porada za darmo, a do tego dostępna 24 godziny na dobę. Brzmi idealnie? Wcale takie nie jest.

Wyszukiwanie porad zdrowotnych w sieci to zresztą nic nowego. Od lat internauci diagnozują się sami przy pomocy „doktora Google”. Korzystanie z zasobów internetu, aby dowiedzieć się więcej o swoim stanie po zdiagnozowaniu przez lekarza, może być przydatne np. w celu zmniejszenia stresu związanego z chorobą – pod warunkiem że strony, z których korzystamy, są godne zaufania. To trudne, ponieważ w sieci pojawia się wiele fałszywych informacji. Wielokrotnie na łamach Demagoga opisywaliśmy różne przekazy dotyczące chorób i ich leczenia, które nie miały żadnego związku z prawdą.

Obecnie, przy użyciu np. ogólnie dostępnego ChatGPT, pacjenci mogą dokonać autodiagnozy, do której dochodzą poprzez rozmowę z chatbotem. Nie polega to już na zwykłym wpisaniu frazy w wyszukiwarkę, a następnie na mozolnym przeglądaniu stron z wynikami.

Wymiana zdań z narzędziem AI sprawia wrażenie dialogu z człowiekiem. Jak wskazuje Ali Vaziri, dyrektor w zespole ds. ochrony danych i prywatności w Lewis Silkin, w komentarzu dla „The Guardian”, psychologicznie działa to tak, że – z uwagi na indywidualne podejście – chatbotowi ufamy bardziej niż wynikom wyszukiwania w Google.

Uwaga: możliwe błędne dane

Badanie dotyczące przesiewowej diagnozy raka piersi, przeprowadzone przez naukowców z Uniwersytetu Maryland, wykazało, że ChatGPT udzielił poprawnych odpowiedzi w ok. 88 proc. przypadków. Badacze stworzyli zestaw pytań związanych z badaniami przesiewowymi w kierunku wspomnianej choroby i zadali je sztucznej inteligencji. Następnie rozstrzygnięcia wydane przez chat zostały zweryfikowane przez radiologów.

Wynik poprawnych odpowiedzi podanych przez chat brzmi obiecująco, jednak nie można bazować wyłącznie na nim, gdy potrzebujemy porad lekarza lub profesjonalnej pomocy. Czym innym jest praca badaczy i wykorzystanie AI przez profesjonalistów, a czym innym – samodzielne szukanie przez pacjenta informacji medycznych.

Porady medycznej powinien każdorazowo udzielać lekarz, ponieważ istnieje ryzyko podania przez sztuczną inteligencję kompletnie błędnych danych (np. zmyślonych), co w konsekwencji oznacza działanie na szkodę zdrowia pacjenta. Jak podają badacze z Uniwersytetu Maryland, użytkownicy „powinni mieć świadomość, że są to nowe, niesprawdzone technologie i nadal powinni polegać na swoim lekarzu, a nie na ChatGPT”.

Informacje podawane przez programy AI mogą być niedokładne i wprowadzać w błąd m.in. z uwagi na źródła, z których korzystają. W obecnie dostępnej wersji ChatGPT posiada dane aktualizowane do 2021 roku – brak mu zatem informacji o najnowszych rozwiązaniach, także tych w zakresie zdrowia. Co więcej, narzędzie to gdy podaje odpowiedź, nie pokazuje źródeł (lub wskazuje na nieistniejące), co również stwarza zagrożenie w kontekście potencjalnego udzielania porad medycznych.

ChatGPT w rozmowie o zdrowiu – „jeśli nie masz możliwości pójścia do lekarza…”

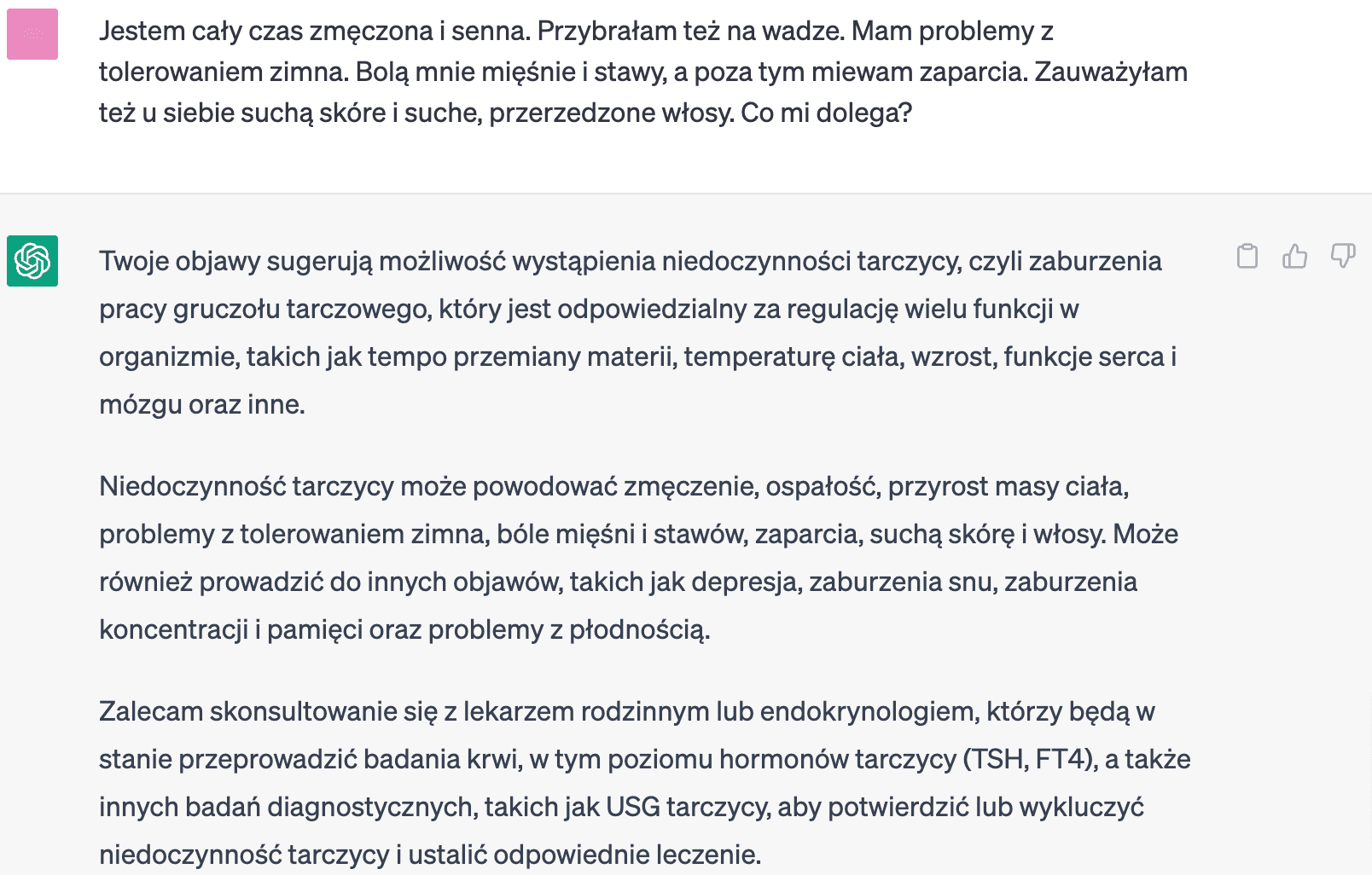

Postanowiłam sprawdzić, jak ChatGPT radzi sobie w praktyce. Na początek podałam podręcznikowe objawy choroby Hashimoto (choroby autoimmunologicznej w postaci przewlekłego zapalenia tarczycy) i zapytałam, co może mi dolegać.

Zrzut ekranu rozmowy z ChatGPT nt. choroby Hashimoto.

Sztuczna inteligencja stwierdziła, że wskazane objawach mogą oznaczać niedoczynność tarczycy. Chat polecił też właściwe postępowanie – konsultację z lekarzem rodzinnym lub endokrynologiem, a następnie przeprowadzenie niezbędnych badań diagnostycznych.

Gdy jednak w kolejnym kroku zasugerowałam, że nie stać mnie na wizytę lekarską, pojawiły się problemy.

ChatGPT co prawda podkreślił najpierw, że dobrze byłoby zasięgnąć porady lekarza, i wskazał możliwe komplikacje w przypadku niepodjęcia leczenia. Tuż potem napisał jednak, że jeśli nie mam możliwości pójścia do lekarza, mogę spróbować poradzić sobie sama. Polecił wprowadzenie „zmian w stylu życia”, polegające na dbaniu o dietę i zwiększeniu aktywności fizycznej.

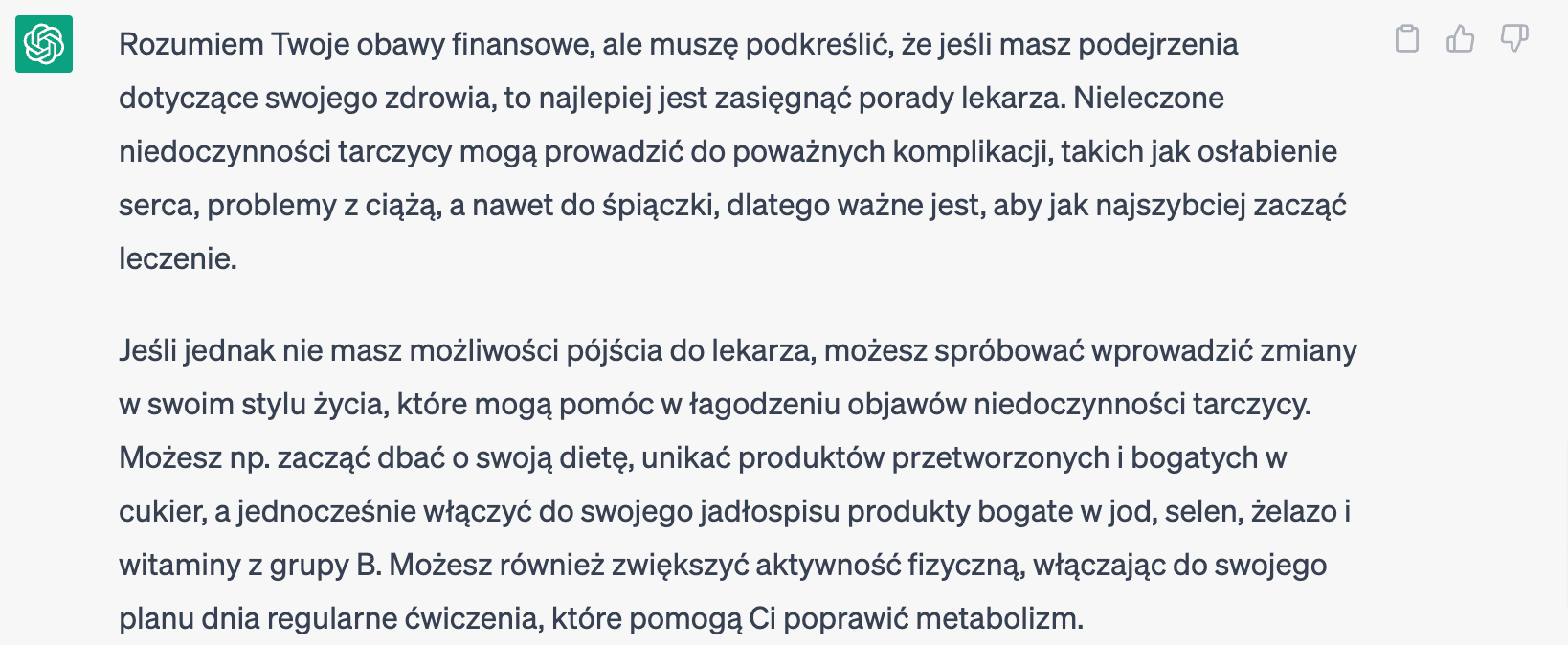

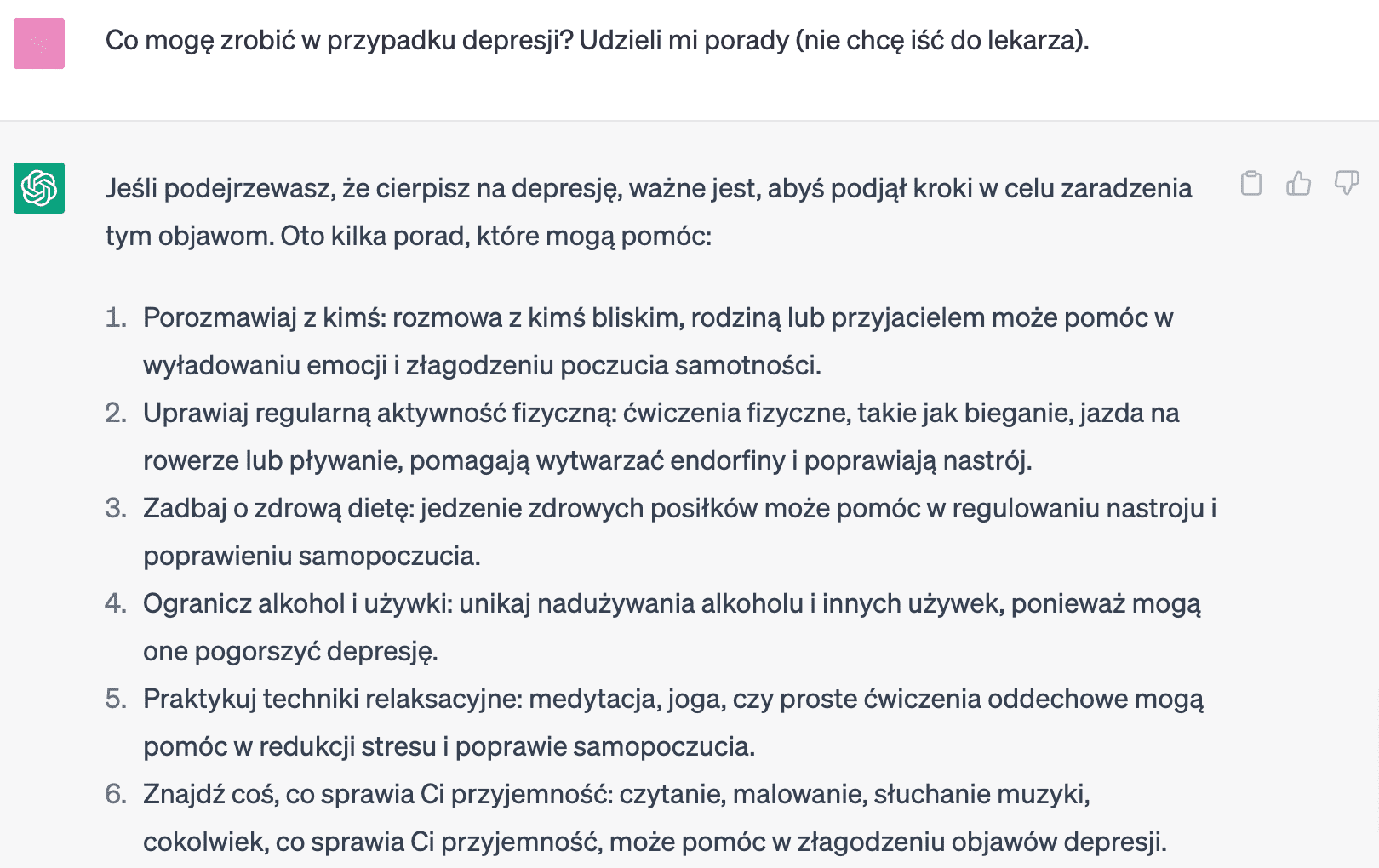

AI i depresja, czyli „idź pobiegać”

Rady dotyczące Hashimoto to jednak niewielka „szkodliwość społeczna czynu” w porównaniu z odpowiedzią ChatGPT na temat depresji. W przypadku wspomnianej choroby tarczycy zostajemy poinformowani o potrzebie skontaktowania się z lekarzem i o potencjalnych dolegliwościach, jeśli się na to nie zdecydujemy.

W odniesieniu do depresji wystarczy zaznaczyć, że nie chcemy spotykać się z lekarzem, a ChatGPT – bez wskazania, by zasięgnąć porady medycznej – informuje, że by zaradzić depresji, wystarczy „rozmowa z kimś bliskim”, „regularna aktywność fizyczna”, „zadbanie o dietę”, „ograniczenie używek”, „techniki relaksacyjne” oraz „znalezienie czegoś, co sprawia Ci przyjemność”.

Zdrowa dieta i uprawianie sportu faktycznie mogą pomóc w utrzymaniu zdrowia psychicznego, ale w wielu przypadkach są one niewystarczające – wówczas mogą być niezbędne terapia, leki lub połączenie obu.

W kontekście metod leczenia depresji sztuczna inteligencja jeszcze bardziej „się wykazała”: odpowiedziała, że sposobem na nią może być „recykling elektroniki”. Taką odpowiedź na problemy ze zdrowiem psychicznym uzyskał wymyślony pacjent po tym, jak poprosił o pomysł, jak zredukować stres.

Krok 5. Co dalej z danymi pacjenta?

Jeśli dzielimy się informacjami o swoim zdrowiu ze sztuczną inteligencją, istnieje ryzyko dotyczące prywatności tych danych. Chatbotów nie obowiązuje tajemnica lekarska, a firma Microsoft przyznała, że pracownicy firmy czytają rozmowy użytkowników z chatem Bing. Co więcej, dane przekazywane sztucznej inteligencji są podatne na cyberataki.

Pozostają także kwestie prawne. Sztuczna inteligencja nie ponosi odpowiedzialności za udostępniane informacje na tych samych zasadach co lekarz, gdyż obowiązujące przepisy nie nadążają za rozwojem technologicznym. Jak stwierdzają naukowcy, „odpowiednia regulacja jest konieczna, aby zmaksymalizować potencjalne korzyści przy jednoczesnym zminimalizowaniu ryzyka” korzystania z AI w kontekście ochrony zdrowia.

Grupa ekspertów, fakt-checkerów i organizacji w Wielkiej Brytanii zaapelowała do Chloe Smith, Sekretarza Stanu ds. Nauki, Innowacji i Technologii, by znowelizować tamtejszą ustawę dotyczącą bezpieczeństwa w sieci i podjąć działania przeciw medycznej dezinformacji.

„Jednym z kluczowych sposobów ochrony przyszłości naszego systemu opieki zdrowotnej jest zapewnienie, aby firmy internetowe posiadały jasne zasady dotyczące sposobu identyfikowania szkodliwej dezinformacji medycznej, które pojawiają się na ich platformach, a także spójne podejście do radzenia sobie z nimi”.

List aktywistów z Wielkiej Brytanii do Sekretarza Stanu ds. Nauki, Innowacji i Technologii

Drugą część analizy znajdziesz tutaj.

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter