Analiza

Omawiamy ważne fakty dla debaty publicznej, a także przedstawiamy istotne raporty i badania.

„Papież pełen dripu”. Zdjęcia tworzone przez AI trendują w sieci

Fotografie generowane przez sztuczną inteligencję pokazują znane osoby w sytuacjach, w których nigdy nie brały udziału.

„Papież pełen dripu”. Zdjęcia tworzone przez AI trendują w sieci

Fotografie generowane przez sztuczną inteligencję pokazują znane osoby w sytuacjach, w których nigdy nie brały udziału.

Nieczęsto zdarza się, aby zdjęcie papieża Franciszka wywołało taką ekscytację jak przy okazji postu opublikowanego przez profil Dropsy. Na zdjęciach widać głowę Stolicy Apostolskiej ubraną w białą kurtkę wyglądającą, jakby dopiero co była prezentowana na modowym wybiegu. Na ubiór kojarzący się raczej z celebrytami niż z duchownymi wysokiej rangi pozytywnie zareagowali komentujący, nazywając Franciszka „dripieżem”, łącząc nazwę jego stanowiska ze slangowym określeniem na modne ubrania.

Na pierwszy rzut oka można by stwierdzić, że Franciszek dokonał wizerunkowej rewolucji. Jednak gdy przeczytamy opis posta, dowiemy się, że zdjęcia Ojca Świętego są fałszywe. Wygenerował je Midjourney – program bazujący na sztucznej inteligencji (AI), zdolny do tworzenia nieistniejących obrazów. W ostatnim czasie w sieci można natknąć się na coraz więcej przykładów zmyślonych sytuacji, których uczestnikami są różne osoby publiczne. Może natknęliście się ostatnio na jeden z nich?

Trump aresztowany, Obama je lody, a Ziobro strzela z karabinu

Grupa policjantów ściga podejrzanego uciekającego ulicami jednego z amerykańskich miast. W końcu udaje im się dopaść zbiega. Rzucają go na ziemię, aby następnie odciągnąć go i zamknąć w areszcie. Tym podejrzanym jest Donald Trump – były prezydent Stanów Zjednoczonych. Cała ta sytuacja, mimo że zobrazowana w widowiskowy sposób nie miała miejsca w rzeczywistości.

Making pictures of Trump getting arrested while waiting for Trump's arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

Sceny pościgu i zatrzymania Donalda Trumpa zostały stworzone przez Eliota Higginsa, założyciela Bellingcat – grupy niezależnych dziennikarzy śledczych, zajmujących się badaniem nadużyć, z wykorzystaniem metod białego wywiadu. Higgins, wykorzystując wspomniany wcześniej program Midjourney, stworzył wizualizację, jak mogłoby wyglądać aresztowanie byłego prezydenta. O tym, że takie zdarzenie ma wkrótce nastąpić, przekonywał sam Trump, nawołując swoich zwolenników do protestów, w momencie zatrzymania go przez funkcjonariuszy.

Higgins w swoim wątku na Twitterze nie tylko przedstawił moment aresztowania. Midjourney wygenerował także obrazy z procesu, z pobytu Trumpa w więzieniu, a nawet z ucieczki, niczym z filmu „Skazani na Shawshank”.

— Eliot Higgins (@EliotHiggins) March 21, 2023

Przykładów fikcyjnych historii z udziałem polityków jest więcej. Na profilach Demagoga w mediach społecznościowych opisywaliśmy ostatnio zmyślone spotkanie Baracka Obamy i Angeli Merkel, którzy rzekomo wybrali się wspólnie na plażę. W rzeczywistości nigdy nie doszło to takiego wydarzenia, a całość jest efektem pracy sztucznej inteligencji.

Treści tego typu odwołują się również do bieżących wydarzeń. Kilka dni temu profil No Context French opublikował na Twitterze serię zdjęć prezydenta Francji Emmanuela Macrona, uciekającego przed protestantami w Paryżu. Trwający od początku marca strajk wielu grup zawodowych jest związany z planami podniesienia wieku emerytalnego.

— No Context French 🇫🇷 (@nocontextfre) March 21, 2023

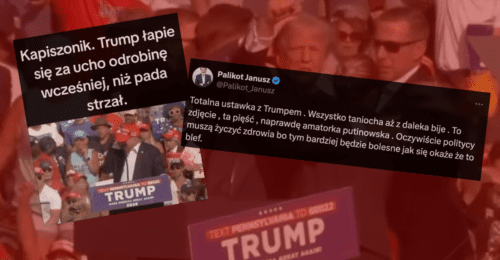

Sprawa fałszywych zdjęć znanych osób ma również wątek polski. Dziennik Gazeta Prawna opublikował artykuł z fotografiami rzekomo przedstawiającymi m.in. Zbigniewa Ziobro z karabinem czy Donalda Tuska zatrzymanego przez Centralne Biuro Antykorupcyjne.

A więc @ZiobroPL widziany z długą bronią? Nie, to deep fake wykonany przy pomocy @midjourney_ai.

W dzisiejszej @DGPrawna wzywamy do refleksji nad tym, co może przynieść popularność takich narzędzi. Link i więcej zdjęć 👇 pic.twitter.com/1FoQIj7mQk

— anna wittenberg (@annawitten) March 23, 2023

Zabawa czy nowe zagrożenie?

Ktoś mógłby uznać, że w wygenerowanych przez AI zdjęciach papieża w białej kurtce lub w pozłacanych butach nie ma nic złego. Sztuczna inteligencja używana w celach rozrywkowych może przynieść sporo frajdy (choć odbywa się to kosztem „tradycyjnych” artystów). Szybko rozwijające się możliwości narzędzi takich jak Midjourney czy Dall E wzbudzają także niepokój.

Parmy Olson, analityczka współpracująca z Bloombergiem, w swoim tekście poświęconym zdjęciom stworzonym przez AI opisuje, jak kilku ludzi na ważnych stanowiskach uwierzyło w prawdziwość zdjęć przedstawiających Macrona podczas protestów. Problematyczna jest tu kwestia braku czytelnego oznaczenia, czy dane zdjęcie jest prawdziwe, czy wygenerowane cyfrowo. W ten sposób użytkownicy są zdani na swój własny osąd przy weryfikacji tego typu treści.

O tym, że nie jest to proste, przekonuje psycholog prof. Manos Tsarikis, jeden ze współautorów pracy sprawdzającej zdolność ludzi do rozpoznania, które twarze są generowane cyfrowo, a które są zdjęciami prawdziwych ludzi. Jak się okazało, wytwory sztucznej inteligencji były częściej uznawane za rzeczywiste.

Badanie wykazało także, że więcej zaufania wzbudzały informacje przekazywane przez postacie, które uznano za naturalne. Gdy uczestnicy dowiedzieli się, że mogą mieć do czynienia również z awatarami wygenerowanymi przez komputer, stali się bardziej podejrzliwi – niezależnie od tego, czy zaprezentowano im zdjęcia ludzi, czy cyfrowe twory:

„Ogólnie rzecz biorąc, mamy tendencję do działania na podstawie domyślnego założenia, że inni ludzie są zasadniczo prawdomówni i godni zaufania. Wzrost liczby fałszywych profili i innych sztucznych treści w sieci rodzi pytanie, jak bardzo ich obecność i nasza wiedza o nich może zmienić ten »domyślny stan prawdy«, ostatecznie powodując erozję zaufania społecznego”.

Prof. Manos Tsarikis, „Deep fakes: Can you distinguish between fake and genuine photos?”

Na co zwracać uwagę, by rozpoznać sztuczne obrazy?

Wciąż nie ma jednego, uniwersalnego narzędzia pozwalającego rozpoznać, czy dany obraz został stworzony przez sztuczną inteligencję, czy za pomocą aparatu trzymanego przez człowieka. Można jednak próbować zwracać uwagę na detale, które wskażą nam fałszywkę. Po tym, jak seria tweetów o Donaldzie Trumpie zdobyła wielką popularność (6 mln wyświetleń!), Eliot Higgins udzielił kilku porad, jak rozpoznać obrazy generowane przez AI:

- Zwracaj uwagę na otoczenie – programy służące do tworzenia wirtualnych treści koncentrują się na pierwszym słowie polecenia. W związku z tym szczegóły otoczenia, takie jak np. przechodnie czy wygląd budynków, są potencjalnie mniej dokładne, a tym samym niepozbawione wad, jak chociażby brak twarzy.

- Spójrz, czy nie ma wadliwych tekstów – mimo że programy do tworzenia grafik coraz lepiej radzą sobie z postaciami, nadal mają problemy z napisami na budynkach czy na ubraniach. Wystarczy spojrzeć np. na ramię jednego z policjantów, by stwierdzić, że coś na tym zdjęciu jest nie w porządku.

- Nienaturalna mimika – Higgins zwrócił także uwagę, że Midjourney znacznie przesadza, próbując odtworzyć ludzkie emocje. Dlatego właśnie Melania Trump na tym obrazie ma tak nienaturalnie naciągniętą skórę twarzy.

Warto także pamiętać o tym, aby sprawdzać informacje w różnych źródłach. Jeśli ktoś publikuje sensacyjne doniesienia, dotyczące chociażby zatrzymania ważnego polityka, to brak wiadomości na ten temat w najważniejszych serwisach powinien wydać się podejrzany.

Wracając do papieża Franciszka w kurtce, wystarczy spojrzeć z bliska na jego prawą dłoń. Widać wyraźnie, że coś poszło nie tak i program nie był w stanie wygenerować jej w przekonujący sposób. Tym samym „dripież” pozostaje jedynie niespełnionym marzeniem internautów.

Fot. Facebook.com

Podsumowanie

Pierwsze programy pozwalające na wygenerowanie cyfrowych twarzy nie pozostawiały wątpliwości, że są one dziełem komputera. Wraz z rozwojem technologii sztucznej inteligencji jakość tych materiałów gwałtownie wzrosła. Dziś coraz trudniej rozpoznać, co jest fotografią, a co – jedynie efektem pracy zmyślnego kodu. Unia Europejska proponuje uregulować tę kwestię w ramach tzw. AI Act. Do czasu, aż powstaną odpowiednie rozwiązania prawne, warto zwracać większą uwagę na zdjęcia ukazujące jakieś sensacyjne wydarzenia.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter