Omawiamy ważne fakty dla debaty publicznej, a także przedstawiamy istotne raporty i badania.

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Twórcy dezinformacji coraz skuteczniejsi w obchodzeniu algorytmów

Inżynierowie pracujący dla największych sieci społecznościowych opracowali nowe narzędzia służące do wykrywania i blokowania fałszywych treści udostępnianych przez użytkowników. Z drugiej strony, jak podaje EU DisinfoLab, autorzy dezinformacji nauczyli się wykorzystywać nowe techniki, aby obejść systemy moderacji.

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Twórcy dezinformacji coraz skuteczniejsi w obchodzeniu algorytmów

Inżynierowie pracujący dla największych sieci społecznościowych opracowali nowe narzędzia służące do wykrywania i blokowania fałszywych treści udostępnianych przez użytkowników. Z drugiej strony, jak podaje EU DisinfoLab, autorzy dezinformacji nauczyli się wykorzystywać nowe techniki, aby obejść systemy moderacji.

W związku z pandemią COVID-19 członkowie grupy BigTech, do której należą Facebook, Instagram, Twitter oraz YouTube, podjęli nowe wysiłki przeciwko dezinformacji. Okazuje się jednak, że walka z nią przez wymienione platformy nie jest tak skuteczna, jak powinna.

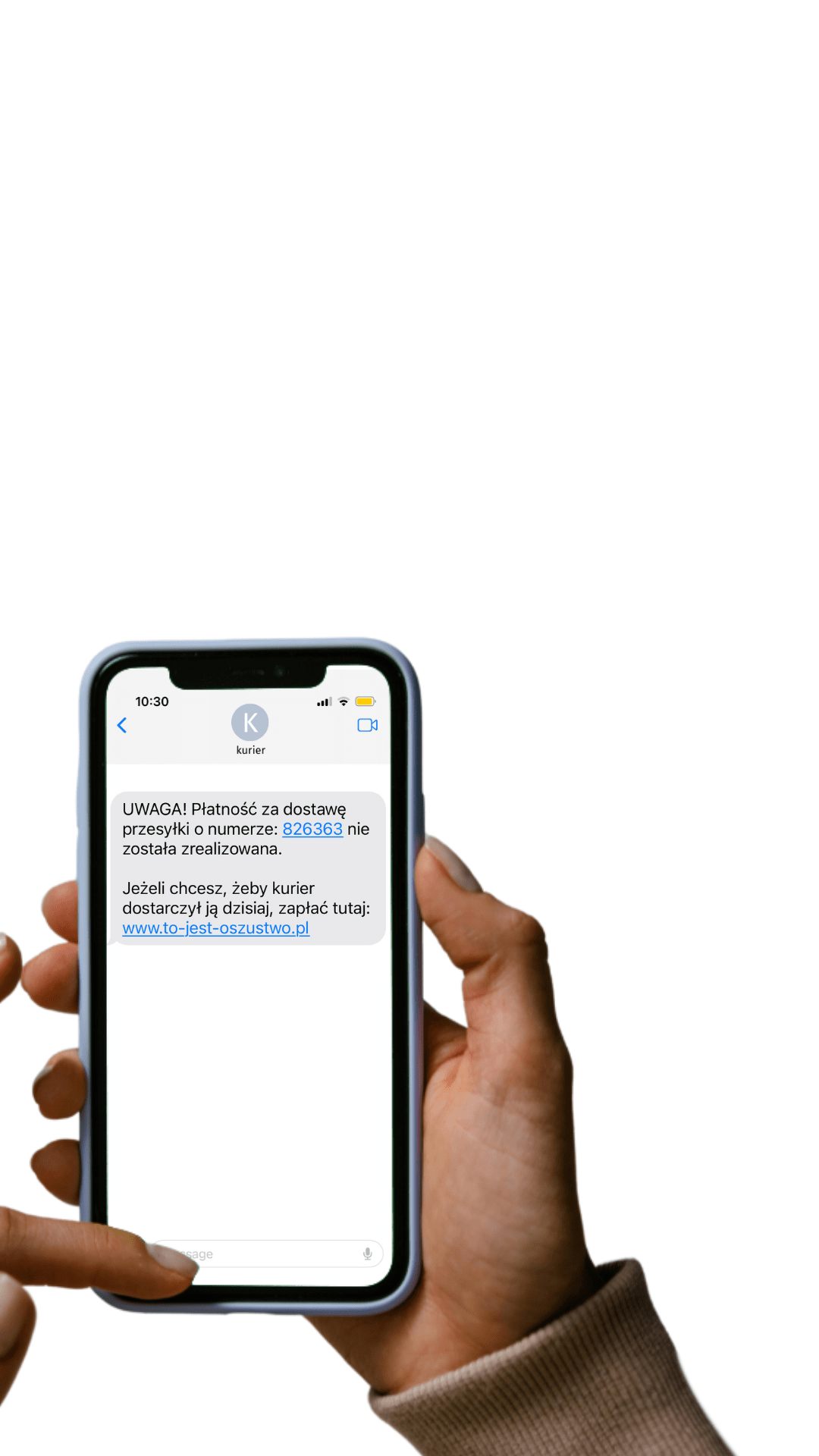

Błędna pisownia sposobem na obejście algorytmu

Systemy przeciwdziałania dezinformacji w mediach społecznościowych działają głównie dzięki algorytmom, które mają za zadanie wykrywać słowa kluczowe powiązane z koronawirusem. Rozwiązanie to pozwala przykładowo na monitorowanie doniesień użytkowników na temat szczepionek, środków bezpieczeństwa, liczby i przebiegu zakażeń itp.

Gdy dany materiał jest często udostępniany i staje się sensacją, dla moderatorów jest to sygnał, że należałoby mu się bliżej przyjrzeć.

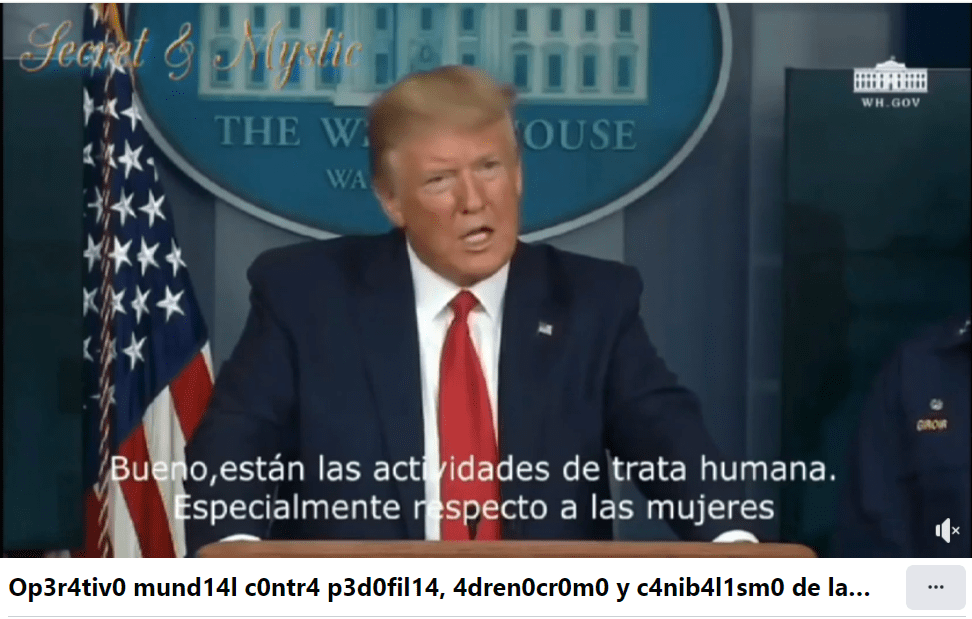

Niestety, okazało się, że system jest zawodny w przypadku błędnej pisowni. Wykorzystali to fani teorii spiskowych z internetowej społeczności QAnon, którzy zaczęli stosować prosty szyfr polegający na zastępowaniu liter cyframi. Przykładem jest jeden z popularnych filmów na Facebooku, którego tytuł brzmi: „Op3r4tiv0 mund14l c0ntr4 p3d0fil14, 4dren0cr0m0”. Można to odczytać jako „Trwa operacja przeciwko pedofilii oraz andrenochromowi”.

Zakamuflowana informacja o rzekomej „operacji przeciwko pedofilii oraz andrenochromowi” na hiszpańskojęzycznym Facebooku. Źródło: Facebook.

Wideo dotyczy teorii spiskowej, według której członkowie elit mieliby porywać nieletnich w celu pozyskiwania z ich szyszynek andrenochromu. Nagranie zdobyło 48 tys. wyświetleń oraz 2 tys. polubień, zanim zostało odkryte przez członków EU DisinfoLab. Więcej o teoriach rozsiewanych przez QAnon przeczytasz w tej analizie.

Zamienione litery

Owe specyficzne kryptonimy są także tworzone poprzez zamienianie jednej lub dwóch liter w danym haśle. W badaniu nad hiszpańskojęzyczną częścią Internetu EU DisinfoLab ustaliło, że dotyczy to najczęściej takich słów jak: vacunas (szczepionki), mascarillas (maseczki) czy ivermectina (iwermektyna). W efekcie COVID jest opisywany jako COVIT, COBIT lub COBID ze względu na podobne brzmienie w języku hiszpańskim.

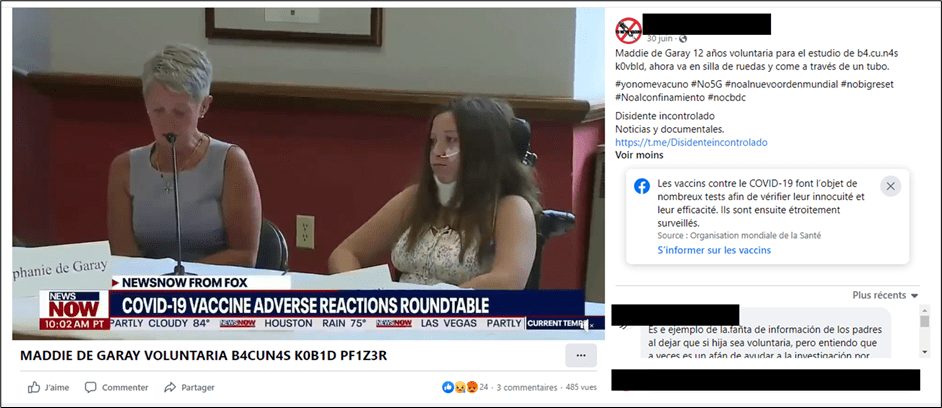

Techniki błędnej pisowni i zamieniania liter są łączone, przez co powstaje wiele kombinacji takich jak: k0b1d (covid) czy K4KVNA (vacuna).

Przykład posta z zakamuflowanymi treściami na temat COVID-19 na hiszpańskojęzycznym Facebooku. Źródło: EU DisinfoLab.

Inną techniką kamuflażu jest zamieszczane zaszyfrowanych wyrazów w postaci znaku wodnego na publikowanych nagraniach i zdjęciach. Metoda sprawdza się, ponieważ tekst zapisany w materiałach wizualnych jest trudny do automatycznego wykrycia.

Kamuflaż i wspólna „misja”

EU DisinfoLab zauważa, że owe kryptonimy pełnią nie tylko funkcję kamuflażu przed systemem automatycznej moderacji, ale także pozwalają na budowanie tożsamości grupowej pomiędzy użytkownikami. Zyskują oni poczucie, że sprzeciwiają się koncernom farmaceutycznym i korporacjom Big Tech, czując się częścią wspólnoty, posługującej się tym samym tajnym kodem.

Taka postawa sprawia, że regulacja fałszywych informacji jest bardzo trudnym zadaniem. Blokowanie treści spotyka się z otwartą wrogością ze strony osób stosujących tego typu taktyki i jeszcze większą wiarą części użytkowników w nieracjonalne tezy.

Analitycy z EU DisinfoLab zwracają wagę na to, że wprowadzane przez media społecznościowe rozwiązania mogą być odebrane jako narzucone odgórnie i nieprzejrzyste, zwłaszcza gdy w system algorytmów wkradnie się błąd. Argument ten ilustrują przykładem sytuacji, gdy Twitter nadgorliwie oznaczył jako dezinformacje wszystkie tweety zawierające łącznie frazy „5G” oraz „tlen”.

Podczas gdy naukowcy pracują nad wykrywaniem i eliminowaniem nieznanych odmian wirusa, pozostali eksperci zmagają się z problemem nowych form dezinformacji. Inżynierowie zatrudnieni przez firmy BigTech i specjalne unijne zespoły badawcze poszukują długofalowych rozwiązań, które mogłyby efektywnie ograniczyć to zagrożenie z poszanowaniem dla wolności słowa.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter