Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

Wybory w memach. Czy satyra może zmienić się w dezinformację?

Stali użytkownicy internetu z pewnością są zaznajomieni z różnymi formami satyrycznych treści, jakie pojawiają się w mediach społecznościowych. Śmieszne obrazki czy krótkie filmiki nie tylko wprawiają nas w dobry nastrój, ale mogą również działać jako skuteczny nośnik informacji – lub dezinformacji.

fot. TikTok, X.com / Modyfikacje: Demagog

Wybory w memach. Czy satyra może zmienić się w dezinformację?

Stali użytkownicy internetu z pewnością są zaznajomieni z różnymi formami satyrycznych treści, jakie pojawiają się w mediach społecznościowych. Śmieszne obrazki czy krótkie filmiki nie tylko wprawiają nas w dobry nastrój, ale mogą również działać jako skuteczny nośnik informacji – lub dezinformacji.

Jak pisał Joshua Troy Nieubuurt w artykule „Internet Memes: Leaflet Propaganda of the Digital Age”, internetowe memy są skutecznym narzędziem w arsenale cyfrowej perswazji. Treści satyryczne są łatwe do przygotowania, przyjemne w odbiorze i łatwe do zapamiętania. Za ich pośrednictwem można komentować najróżniejsze tematy i wydarzenia: od popkultury, przez zdrowie publiczne, aż do polityki.

Kampania wyborcza a satyra

Satyra internetowa znajduje swoje miejsce również podczas kampanii wyborczych. Jak się okazuje, może zostać użyta jako skuteczne narzędzie perswazji politycznej, do budowania konkretnych narracji wokół polityków, a nawet do zrzeszania i umacniania społeczności skupiających się wokół konkretnych opcji.

Niesie ona za sobą również wiele zagrożeń. W niektórych przypadkach odbiorcy satyrycznych treści nie rozpoznają, że zostały one stworzone w celach humorystycznych. W dzisiejszych czasach staje się to coraz trudniejsze – głównie ze względu na popularyzację narzędzi dających możliwość przerabiania zdjęć i filmów przy pomocy sztucznej inteligencji (AI). Niezrozumienie żartu otwiera więc prostą drogę do powstania dezinformacji.

Na łamach Demagoga, zarówno w trakcie tegorocznej kampanii wyborczej, jak i już po wyborach parlamentarnych, wielokrotnie demaskowaliśmy treści satyryczne, które zamieniły się w dezinformację.

Satyra podczas wyborów – jak reagowali na nią internauci?

Jak już wspominaliśmy, w ostatnich miesiącach w polskiej przestrzeni internetowej pojawiły się liczne satyryczne przeróbki przedstawiające polityków. Znaczna część z nich była tzw. deepfake’ami, czyli materiałami poddanymi manipulacji przy użyciu sztucznej inteligencji.

Internauci, opierając się na zdjęciach czy nagraniach z wystąpień polityków, tworzyli animacje i fałszywe wypowiedzi znanych działaczy sceny politycznej. Dla przykładu można wspomnieć te przedstawiające polityków Prawa i Sprawiedliwości (PiS), które publikowano na TikToku.

Jak można się domyślić, nie wszyscy odbiorcy byli w stanie rozpoznać fałszywość treści, co w rezultacie wprowadzało ich w błąd. Przykładowo 10 października 2023 roku na TikToku opublikowano film, w którym wiceprezes Rady Ministrów Jarosław Kaczyński wypowiada się na temat youtubera Stuu.

„Ten cały Stuu to niebezpieczny człowiek. Drodzy rodzice, ostrzeżcie swoje dzieci przed tymi całymi youtuberami. To jest jakaś patologia. Polska policja powinna się tym zająć i przyjechać na Facebooka” – słyszymy w nagraniu. Jednak Jarosław Kaczyński nie wypowiedział tych słów, a tiktokowy film spreparowano na podstawie jego wystąpienia z 2022 roku w Toruniu.

https://www.tiktok.com/@.igo_/video/7289045113752259872?_r=1&_t=8gblwLfDD9t

Mimo tego, że przeróbka powstała w celach humorystycznych, wielu użytkowników nie rozpoznało, że film jest fałszywy. Świadczą o tym liczne komentarze wyśmiewające Jarosława Kaczyńskiego i jego rzekomy brak wiedzy, jak działa internet. „On nawet nie wie kto to jest” – napisano pod filmem. W innym miejscu czytamy: „Kiedy jarek musi cos powiedziec ale sam nie wie co”.

Co więcej, w sekcji komentarzy wielu internatów zastanawiało się, czy przedstawiony materiał jest prawdziwy. Wskazywali również, że mieli trudności z rozpoznaniem filmu stworzonego dzięki sztucznej inteligencji. „Ej to jest prawdziwe czy ten komputer co mówi bo już nie odróżniam xDD” – czytamy. Inny użytkownik napisał: „dotarliśmy do tego poziomu technologii ze nie wiem czy to ai czy legit”.

Donald Tusk przyznał, że jest „ch…jem”? To kolejny fake

Kolejnym przykładem satyrycznej treści, która wprowadziła internautów w błąd, jest krótki tiktok, w którym były przewodniczący Rady Europejskiej Donald Tusk rzekomo przyznał, że „powiedzieli [Niemcy – przyp. Demagog], że zamiast reparacji [wojennych – przyp. Demagog] Polska dostanie ch…ja. Nie sądziłem, że to o mnie chodziło”.

https://www.tiktok.com/@plowwg/video/7290484070755159328?_r=1&_t=8gbpKyXZ70C

Mimo że pod filmem jego twórca napisał wprost, że przeróbka powstała w celach humorystycznych i przy pomocy AI, wielu odbiorców uwierzyło, że Donald Tusk wypowiedział cytowane słowa. W komentarzach pojawiły się liczne głosy osób wyrażających niechęć do polityka i krytykujących jego rzekome słowa: „pierwsza prawda powiedziana przez Tuska” – czytamy. W innym miejscu napisano: „No i się zaczyna z Tuskiem tak zawsze było”.

Podobnie jak w przypadku deepfake’a z Jarosławem Kaczyńskim pod filmem z Donaldem Tuskiem również pojawiły się komentarze od osób, które przyznawały, że nie były w stanie jednoznacznie stwierdzić, czy wypowiedź jest prawdziwa. „ej on tak na prawde????” – napisano. W innym komentarzu czytamy: „Czemu to brzmi tak prawdziwie”.

To nie jedyny przykład satyrycznej treści, która miała sugerować powiązania pomiędzy Donaldem Tuskiem i naszymi zachodnimi sąsiadami. W innej analizie opisywaliśmy już przykład dezinformacji, która powstała na podstawie fałszywego wpisu humorystycznego na platformie X dodanego z konta podszywającego się pod polityka.

Jarosław Kaczyński obraża Polaków, bo nie głosowali na PiS?

Dwa dni po wyborach parlamentarnych z 15 października 2023 roku w sieci opublikowano kolejną przeróbkę wypowiedzi Jarosława Kaczyńskiego. W filmie słyszymy, jak polityk narzeka na Polaków, którzy nie zagłosowali na Prawo i Sprawiedliwość. Nazywa ich też „hołotą”.

„Jeszcze za drogie było paliwo? Mówiłem Morawieckiemu, żeby zrobić na pięć złotych przed wyborami, to się upierał, że i tak dużo dla tej hołoty […] zrobiliśmy. […] Tylko byście brali i brali 500 plus” – mówi Jarosław Kaczyński [czas nagrania 0:12].

https://www.tiktok.com/@.igo_/video/7290607733814873377?_r=1&_t=8gbloYohXGr

Materiał jest kolejnym przykładem deepfake’a. Świadczy o tym m.in. nienaturalny wygląd i ruch dolnej części twarzy polityka. Co więcej, wypowiedź, którą słyszymy na nagraniu, nie jest dopasowana do ruchu ust Jarosława Kaczyńskiego.

Niestety, jak wynika z komentarzy pozostawionych pod filmem, i tym razem internauci nie byli w stanie rozpoznać, że materiał nie jest prawdą, lecz celowo utworzoną satyrą. „On to mówi jakby zaraz miała wybuchnąć wojna w Polsce xDDD” – napisano w jednym z komentarzy. Inny użytkownik posunął się o krok dalej, obrażając polityka za rzekomo wypowiedziane przez niego słowa: „debil będzie debilem”.

Czy w „Wiadomościach” TVP pokazano zmanipulowane wykresy?

15 października 2023 roku konto satyrycznego tygodnika „NIE” opublikowało na platformie X humorystyczną grafikę, która miała przedstawiać wyniki sondażu exit poll dla tegorocznych wyborów parlamentarnych.

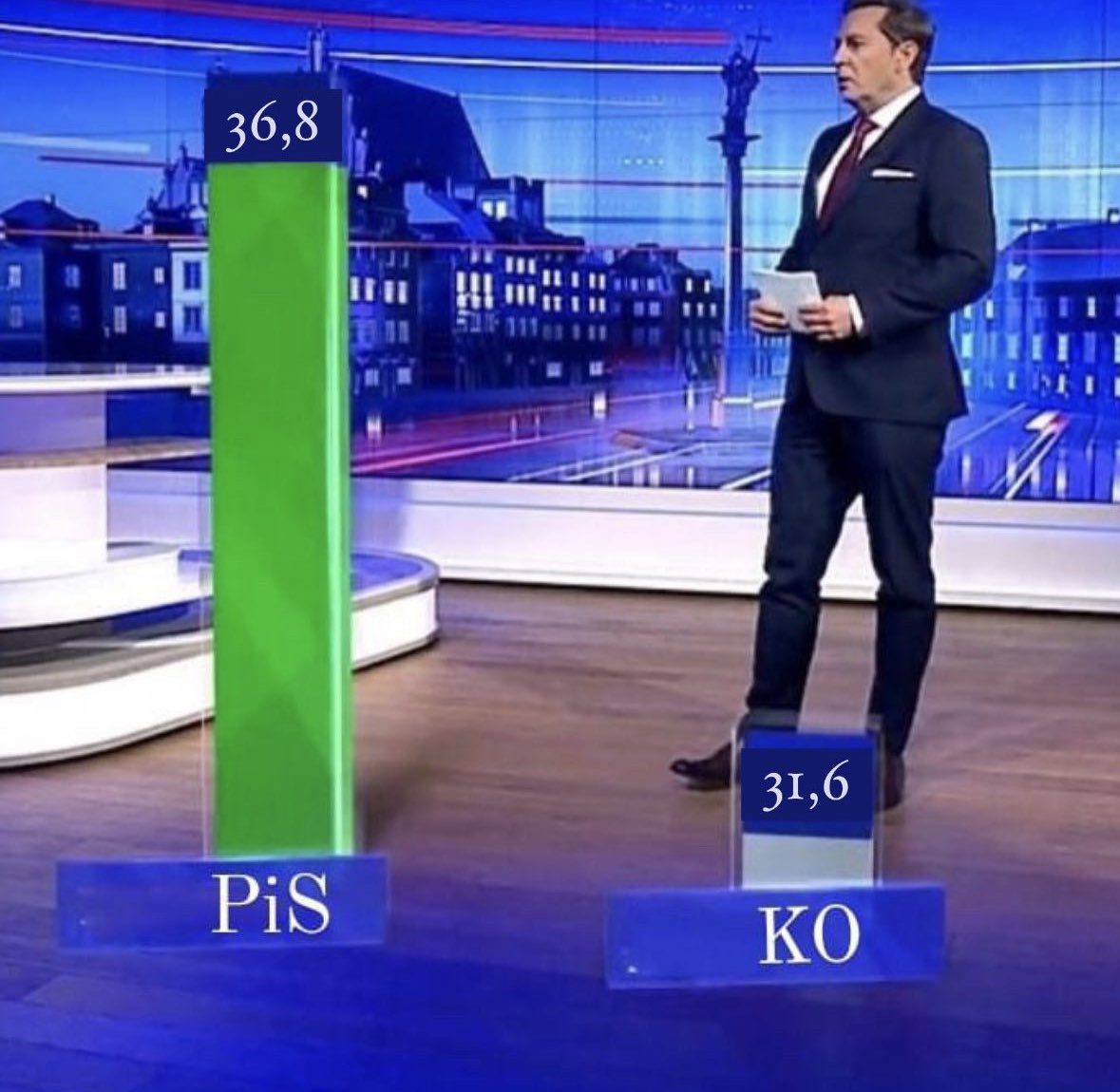

Na obrazku widzimy prezentera programu „Wiadomości” Telewizji Polskiej (TVP) Michała Adamczyka, który przedstawia wykres słupkowy. Po lewej stronie umieszczono wysoki zielony słupek z podpisem „PiS” oraz liczbą „36,8”, a po lewej niewielki szary słupek podpisany „KO” (Koalicja Obywatelska) i „31,6”.

TVP nigdy nie wyemitowało programu, w którym zobrazowano wyniki sondaży w sposób przedstawiony na grafice. W rzeczywistości zrzut ekranu z wydania „Wiadomości” pojawił się w internecie już w 2020 roku i nie miał nic wspólnego z wyborami parlamentarnymi.

Mem opublikowany przez tygodnik „NIE” wzbudził duże zainteresowanie internautów, a wielu z nich uwierzyło, że telewizja państwowa manipulowała wykresem przy przedstawianiu wyników exit poll. Grafika podawana była zarówno przez polskich, jak i zagranicznych użytkowników.

W serwisie Reddit komentujący wyśmiewali zarówno rzekome działania TVP, jak i wyborców partii rządzącej. „Jakby wyborcy pisu rozumieli różnice w %….” – napisano w jednym z komentarzy. „Dajmy im się wyżyć w ostatnie 5 minut” – czytamy. Niektórzy internauci próbowali jednak bronić telewizji, wskazując, że obrazek jest manipulacją: „Zdjęcie zrobione w momencie gdy animacja rośnięcia słupka KO dopiero się zaczynała”. Zaledwie kilka komentarzy wskazywało, że grafika jest fałszywa (1, 2, 3, 4).

Podsumowanie

Jak widzimy na podstawie przedstawionych przykładów, satyryczne treści (1, 2, 3, 4), które pojawiały się w przestrzeni internetowej w trakcie oraz zaraz po kampanii wyborczej, często wprowadzały internautów w błąd. Analizowane przez nas materiały (1, 2, 3, 4) oraz reakcje ze strony komentujących jednoznacznie wskazują, że wśród społeczeństwa wciąż panuje zbyt mała wiedza o tym, jak rozpoznawać zmanipulowane obrazy i filmy.

Brak edukacji na ten temat stanowi idealne środowisko do wzrostu dezinformacji. Jak więc bronić się przez deepfake’ami? Na łamach Demagoga opisywaliśmy już kilka skutecznych sposobów i narzędzi, które pomagają w rozpoznawaniu obrazów i filmów wygenerowanych przy pomocy AI. Więcej na temat wykorzystywania sztucznej inteligencji w polityce przeczytasz tutaj.

Od października 2023 roku jesteśmy członkiem Programu fact-checkingowego TikToka. Jesteśmy w pełni niezależni. Wyłączna odpowiedzialność merytoryczna za publikowane przez nas analizy spoczywa na zespole redakcji portalu demagog.org.pl.

Kontroluj polityków!

Patrz władzy na ręce i wspieraj niezależność.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter