Obalamy fałszywe informacje pojawiające się w mediach społecznościowych oraz na portalach internetowych. Odwołując się do wiarygodnych źródeł, weryfikujemy najbardziej szkodliwe przykłady dezinformacji.

Lewandowski zachęca do inwestowania? Kolejny scam z użyciem AI

Nagranie to deepfake, w którym wykorzystano wizerunek polskiego piłkarza.

fot. Facebook / Modyfikacje: Demagog

Lewandowski zachęca do inwestowania? Kolejny scam z użyciem AI

Nagranie to deepfake, w którym wykorzystano wizerunek polskiego piłkarza.

Analiza w pigułce

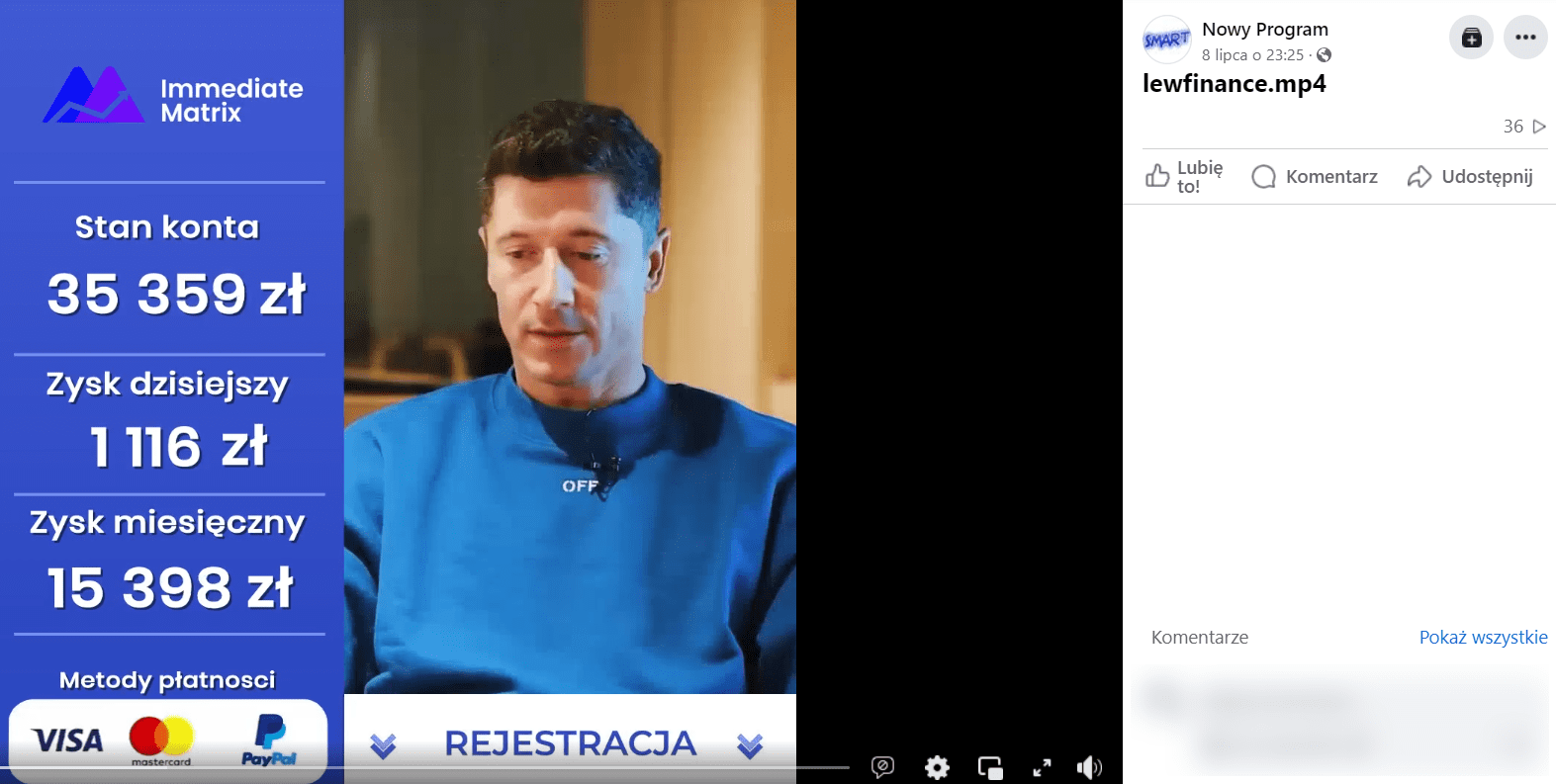

- Na Facebooku opublikowano nagranie, w którym Robert Lewandowski zachęca rzekomo do lokowania pieniędzy na nowej platformie inwestycyjnej.

- Wskazany materiał wideo to deepfake. Piłkarz nie wypowiada się w tym filmie, a jego głos wygenerowała sztuczna inteligencja.

W mediach społecznościowych po raz kolejny pojawił się scam, w którym użyto wizerunku Roberta Lewandowskiego. W nagraniu na Facebooku piłkarz rzekomo mówi o nowej platformie inwestycyjnej i zachęca do rejestracji na niej.

„Jeśli mieszkasz w Polsce i masz telefon oznacza to, że możesz otrzymać ponad 35 tys. złotych do końca tego miesiąca […] Wystarczy się zarejestrować, po czym nasz pracownik skontaktuje się z Tobą i dokładnie wyjaśni, jak to działa. W ciągu tygodnia otrzymasz pond 7 tys. złotych na swoje konto bankowe” – słyszmy w filmie.

Lewandowski nie namawia do inwestycji – to deepfake

Na pierwszy rzut oka rzeczywiście można odnieść wrażenie, że kapitan reprezentacji Polski w piłce nożnej zachęca do inwestycji. Jednak zanim uznamy, że nagranie jest wiarygodne, warto zwrócić uwagę na kilka kwestii.

Nagranie jest deepfake’em, w którym do podrobienia głosu piłkarza wykorzystano sztuczną inteligencję. Możemy to poznać po nienaturalnym, mechanicznym tonie głosu, który ma jednolitą barwę. Wskazuje na to również brak oddechów oraz nieprawidłowa intonacja zdań. Dodatkowo słowa, które rzekomo wypowiada Robert Lewandowski, nie są zsynchronizowane z ruchem jego ust.

Konto, na którym pojawił się materiał wideo, utworzono 8 lipca 2024 roku i nie ma na nim żadnych innych postów ani opinii.

Deepfake to nieprawdziwe obrazy, dźwięki lub filmy wygenerowane za pomocą sztucznej inteligencji. Zazwyczaj przedstawiają sytuacje z udziałem celebrytów lub polityków, które nigdy nie miały miejsca. Takie sfałszowane nagrania ukazują wspomniane osoby w sposób niezgodny z prawdą.

W filmie użyto fragmentu wywiadu (1, 2) z Robertem Lewandowskim, który opublikowano na portalu YouTube, na kanale o nazwie Foot Truck. Piłkarz nie mówi w nim (1, 2) o żadnej platformie inwestycyjnej.

Rejestracja grozi utratą danych i pieniędzy

Na nagraniu wygenerowany głos zachęca do szybkiego zarejestrowania się na platformie inwestycyjnej o nazwie „Immediate Matrix”. Rejestracja ma być prosta i darmowa „dla pierwszych stu uczestników”. Ta strona pojawia się ostatnio także w innych scamach, np. wykorzystujących wizerunek polskiego przedsiębiorcy Rafała Brzoski.

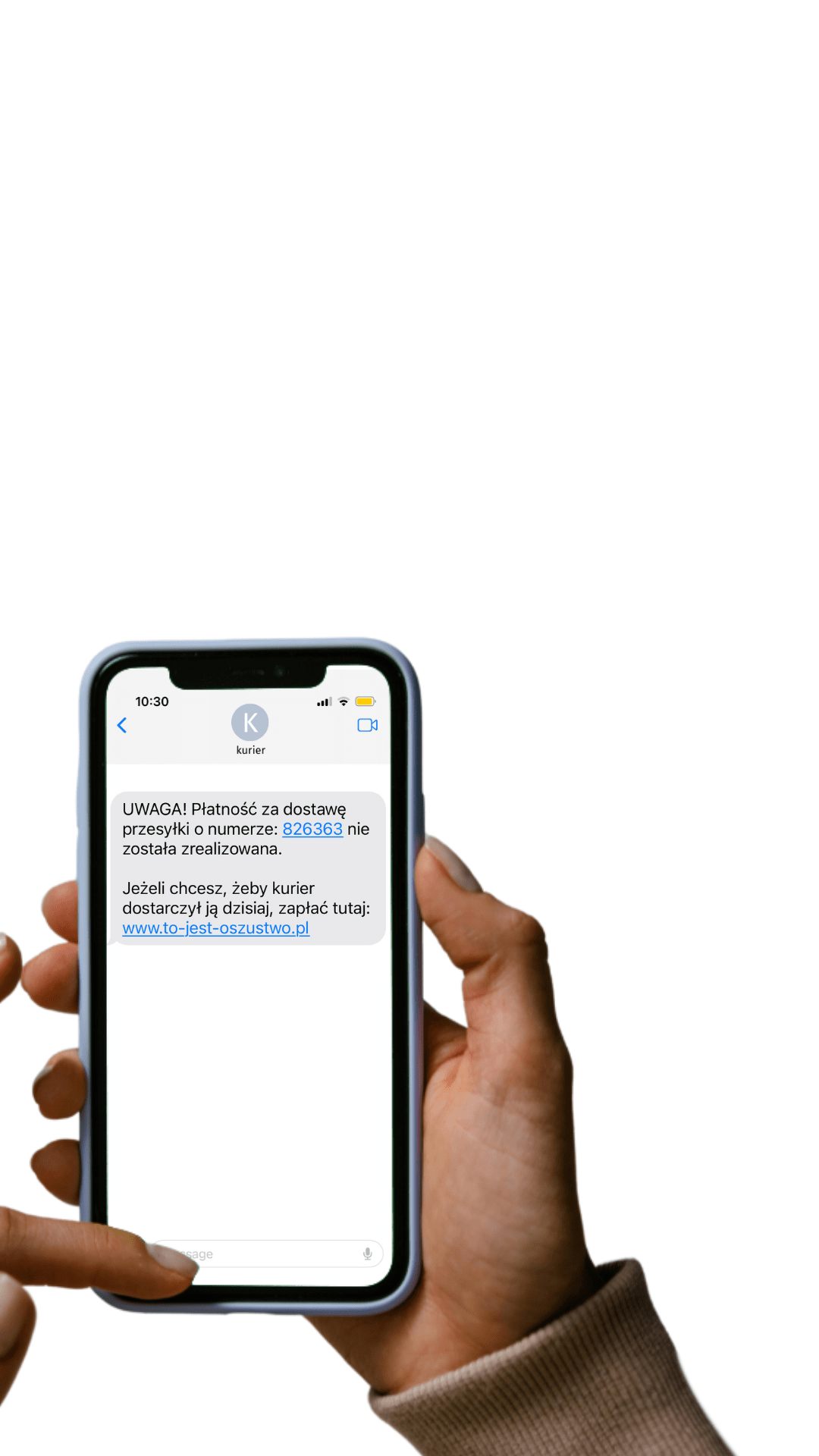

Podanie danych na takich platformach wiąże się z utratą poufnych informacji oraz pieniędzy. W filmie słyszymy, że po rejestracji skontaktuje się z nami pracownik i „dokładnie wyjaśni, jak to działa”. Taka osoba może zachęcać ofiarę do zainstalowania oprogramowania umożliwiającego zdalne śledzenie jej działań w internecie. Dzięki temu oszuści zdobywają hasła np. do kont bankowych.

Jeśli adres danej strony wydaje się podejrzany, nie powinniśmy go otwierać. Aby go zweryfikować, warto sprawdzić listę niebezpiecznych witryn tworzoną przez zespół CERT Polska, który działa w ramach państwowego instytutu NASK.

Podobne przykłady deepfake’ów, w których znane osoby rzekomo zachęcają do zainwestowania na różnych fałszywych platformach, opisaliśmy w tych analizach (1, 2, 3, 4).

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter