Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

Rozpoznawanie twarzy – czy AI może wsadzić do aresztu?

Popularna w telefonach technologia stosowana jest też przez śledczych.

fot. Pexels / Modyfikacje: Demagog

Rozpoznawanie twarzy – czy AI może wsadzić do aresztu?

Popularna w telefonach technologia stosowana jest też przez śledczych.

Odblokowanie telefonu? Wystarczy spojrzeć. Dostęp do aplikacji banku? Zamiast hasła możesz użyć Face ID. Płacisz w sklepie? Nie musisz pamiętać kodu PIN, wystarczy Twoja twarz. A co jeśli powiem Ci, że nie tylko smartfony wykorzystują technologię rozpoznawania twarzy? Za sprawą jej działania można nawet trafić za kratki… niekoniecznie słusznie.

Twarze sztucznej inteligencji – czyli do czego służy ta technologia?

Ogólnie rzecz biorąc, rozpoznawanie twarzy przy pomocy sztucznej inteligencji to technologia, która w założeniu ma umożliwić identyfikację konkretnej osoby. Jednym z jej podstawowych zastosowań jest weryfikacja użytkownika smartfona oraz wykorzystywanie jej jako element uwierzytelnienia, np. w procesie logowania się do konta bankowego czy aplikacji mobilnej.

Niektóre firmy decydują się na wprowadzenie mechanizmów rozpoznawania twarzy przy wejściu do swoich budynków. W ten sposób nieuprawnione osoby nie mają wstępu do ich siedzib, a firma może prowadzić kontrolę obecności pracowników. Urządzenia oparte na rozpoznawaniu twarzy zainstalować można też w domach – zamiast klucza wykorzystujemy wtedy swoją twarz. Część organizacji używa tej technologii zamiast biletów, aby usprawnić wejście na wydarzenia.

Wreszcie – technologia rozpoznawania twarzy jest wykorzystywana przez służby bezpieczeństwa w celu identyfikacji osób na podstawie ich zdjęcia (nawet jeśli podają one fałszywe dane, posługują się podrobionymi dokumentami tożsamości), szukania sprawców przestępstw oraz ich świadków, a także osób zaginionych. Przy użyciu tej technologii tworzone są również bazy danych osób w kryzysie bezdomności.

Systemy rozpoznawania twarzy są wykorzystywane też na lotniskach – na wielu z nich można przejść przez kontrolę paszportową bez konieczności kontaktu z człowiekiem, przy użyciu dokumentu biometrycznego. Automatyczna kontrola nie jest w tym przypadku niczym nowym, przykładowo na lotnisku Chopina w Warszawie funkcjonuje od 2019 roku.

Twarzą w twarz z technologią – czyli jak to działa?

W pierwszym kroku urządzenie wykrywa twarz (lub twarze), odseparowując odpowiednie fragmenty od tych przedstawiających resztę otoczenia. Następnie system odczytuje zapisany obraz – zwraca uwagę m.in. na odległość między oczami, kształt kości policzkowych, głębokość oczodołów, kontur warg, uszu i podbródka. Krótko mówiąc: analizuje geometrię twarzy. Poza tym weryfikowany jest kolor skóry twarzy, oczu i ust.

W dalszej kolejności obraz konwertowany jest na dane – ilustracja twarzy zmieniana jest w zestaw cyfrowych informacji o niej. Powstaje wzór matematyczny – unikalny dla człowieka niczym ułożenie linii papilarnych. Ostatnim krokiem jest znalezienie dopasowania. Jeśli „wzór twarzy”, podobnie jak odcisk palca, odpowiada wcześniej zarejestrowanym danym z innego zdjęcia lub filmu, następuje dopasowanie.

Brzmi logicznie i chciałoby się wierzyć, że działa niezawodnie. Ale jak to wygląda w rzeczywistości?

Przestępstwo wypisane na twarzy? Czyli o skuteczności rozpoznawania twarzy

Programy wykorzystujące technologię rozpoznawania twarzy przy użyciu sztucznej inteligencji chwalą się skutecznością na poziomie zbliżonym do stu procent. Jednak, jak informuje BBC, szacunki te opierają się na zdjęciach policyjnych – wyraźnych, dobrej jakości, wykonanych w jednakowych warunkach.

W przypadku służb bezpieczeństwa, np. tych działających w Wielkiej Brytanii, zazwyczaj nie mówimy o dopasowywaniu zdjęcia wykonanego na wprost, z wyraźnie zarysowanymi elementami twarzy i w perfekcyjnej jakości do drugiej fotografii spełniającej takie standardy. W praktyce materiały czerpane są zazwyczaj z kamer przemysłowych i przetwarzane przez system, który zawiera w swoich zbiorach listę poszukiwanych osób.

Dopasowuje się więc fragment wideo – nierzadko niskiej jakości, na którym uchwycono twarz pod kątem lub w ruchu – do zdjęcia sygnalistycznego wykonanego przez policję albo fotografii zamieszczonej w mediach społecznościowych. Są one wykonane przy innym oświetleniu, różni je też kadr. W przypadku fotografii udostępnianych na platformach społecznościowych nierzadko mamy do czynienia również z edycją w celu poprawienia wyglądu twarzy, zniwelowania niedoskonałości skórnych, rozświetlenia cieni pod oczami itd.

Z dokumentów służb bezpieczeństwa w stanie Floryda wynika, że tylko niewielki odsetek prób dopasowania kończy dochodzenia w sprawie nieznanych sprawców. Jak podaje „The New York Times”, technologia rozpoznawania twarzy sprawdza się w analizie wyraźnych obrazów. Umożliwia ona np. identyfikację osób posługujących się fałszywymi dokumentami tożsamości.

Jednak gdy śledczy próbują ustalić dane osobowe podejrzanego widocznego na ziarnistym materiale z kamer monitoringu, okazuje się znacznie mniej skuteczna.

Sprawca ma wiele twarzy – czyli błędne dopasowania się zdarzają

Szczególnie boleśnie o (nie)skuteczności działania systemów rozpoznawania twarzy przekonała się mieszkanka Detroit. Kobieta została aresztowana pod zarzutem kradzieży samochodu, gdy była w ósmym miesiącu ciąży. Jako sprawczynię wskazała ją technologia. Z powodu braku wystarczających dowodów sprawa została ostatecznie umorzona przez prokuraturę.

Podobna sytuacja spotkała mężczyznę ze stanu New Jersey, który niesłusznie został oskarżony o kradzież słodyczy i przekąsek ze sklepu z pamiątkami. 34-letni Robert Williams trafił do celi z kilkunastoma innymi osobami po tym, jak system rozpoznawania twarzy wskazał go jako sprawcę kradzieży drogich zegarków.

Z kolei 28-letni Michael Oliver został aresztowany podczas kontroli drogowej. Miała ona miejsce dwa miesiące po wydaniu przez policję nakazu aresztowania za rzekome odebranie przez niego smartfona nauczycielowi, który nagrywał bójkę przed szkołą. System rozpoznawania twarzy wskazał mężczyznę na podstawie zrzutu ekranu z wideo nagranego przez nauczyciela. Stało się to pomimo tego, że Oliver ma kilka tatuaży, w przeciwieństwie do widocznego na nagraniu sprawcy.

Służby z Luizjany niesłusznie aresztowały mężczyznę po tym, jak system rozpoznawania twarzy błędnie zidentyfikował go jako sprawcę kradzieży luksusowych torebek. Spędził on prawie tydzień w areszcie, mimo że nigdy nawet nie był w Luizjanie.

Co łączy wszystkie wymienione osoby? Nie są białe.

Sztucznej inteligencji jest do twarzy z jasną karnacją – czyli dlaczego to niebezpieczne dla niebiałych osób?

Technologia rozpoznawania twarzy nie działa z równą skutecznością wobec wszystkich osób. Jak czytamy na stronie Uniwersytetu Harvarda, „coraz większa liczba badań ujawnia rozbieżne poziomy błędów w różnych grupach demograficznych, przy czym najgorszą dokładność konsekwentnie stwierdza się w przypadku kobiet, osób czarnych i w wieku 18–30 lat”.

Wyniki badania opublikowanego na łamach „Government Information Quarterly” pokazują, że zastosowanie rozpoznawania twarzy opartego na sztucznej inteligencji przyczynia się do zwiększania różnic rasowych w aresztowaniach. Jak podkreślono w analizie „Scientific American” taka rozbieżność może wynikać z braku czarnych twarzy w zbiorach danych zgromadzonych przez algorytmy, co w połączeniu z przekonaniem części funkcjonariuszy o nieomylności sztucznej inteligencji generuje problemy.

Co więcej, wśród osób wykonujących zawody związane z technologią w Stanach Zjednoczonych dominują biali mężczyźni. Może się to przekładać na nieświadome przekazanie algorytmom swoich własnych „uprzedzeń rasowych” przez programistów.

Wynika to z faktu, że ludzie zazwyczaj słabiej zapamiętują nieznane twarze osób innej rasy niż swoja własna. Osoby pracujące nad rozwojem technologii nieświadomie skupiają się na znanych im rysach twarzy, przez co powstały algorytm jest testowany głównie na ludziach tej samej rasy.

Twarze z mediów społecznościowych – czyli miliardy zdjęć wykorzystanych bez zgody użytkowników

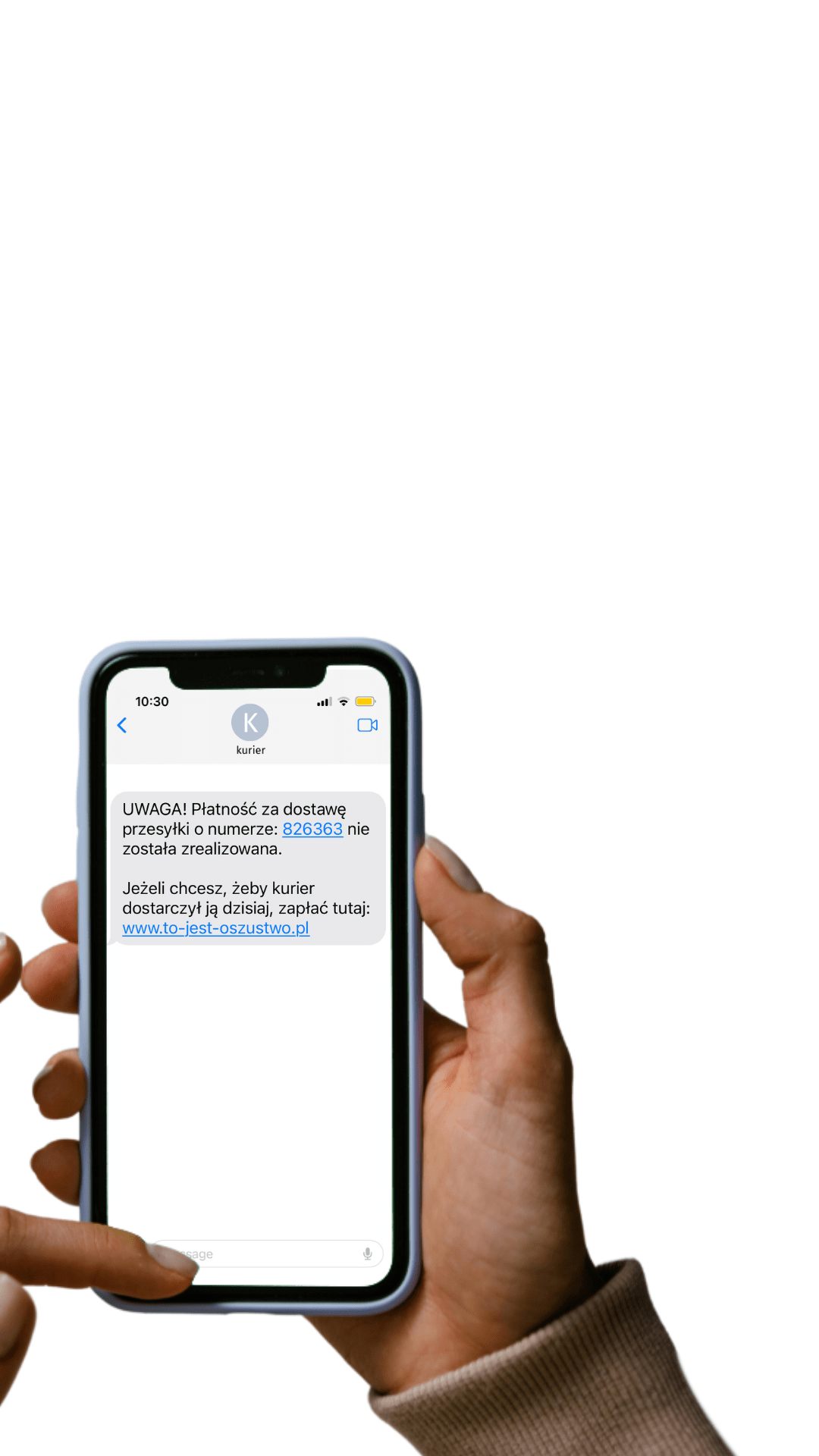

Wątpliwości budzi nie tylko skuteczność rozpoznawania twarzy w oparciu m.in. o zdjęcia pobrane z mediów społecznościowych, ale i samo ich wykorzystanie bez zgody użytkowników platform.

Kilka miesięcy temu dyrektor generalny Clearview AI Hoan Ton-That ujawnił, że firma dysponuje 30 miliardami fotografii pozyskanymi w taki sposób. Dostarcza ona system rozpoznawania twarzy organom ścigania, agencjom rządowym i innym organizacjom.

Już trzy lata temu platformy apelowały o zaprzestanie działalności Clearview AI w związku z wykorzystaniem zdjęć użytkowników. Żądania usunięcia danych zebranych z mediów społecznościowych wystosowały wtedy Facebook, YouTube i Twitter (obecnie X).

„Clearview AI to prywatna firma, która wykonuje odciski twarzy ludzi na podstawie ich zdjęć w internecie, ale bez ich zgody”.

Tymczasem z wykorzystaniem technologii rozpoznawania twarzy udostępnionej przez Clearview AI amerykańska policja przeprowadziła prawie milion poszukiwań. Jak donosi BBC, funkcjonariusze w Miami używają tego oprogramowania do każdego rodzaju przestępstwa, od poważnych czynów, jak zabójstwo, po kradzieże w sklepach.

Technologia pokazuje prawdziwą twarz? Czyli o prywatności w dobie AI

Naukowcy z Uniwersytetu w Essex już kilka lat temu alarmowali w swoim raporcie, że jest „wysoce prawdopodobne”, że wdrożenie przez policję technologii rozpoznawania twarzy zostanie uznane za niezgodne z prawem, jeśli zakwestionuje się je przed sądem.

Jak donosi „The Guardian”, brytyjskie sądy zdążyły już wydać wyroki, w których stwierdziły, że służby bezpieczeństwa, korzystając z technologii rozpoznawania twarzy, nie radzą sobie z przestrzeganiem prawa do prywatności obserwowanych osób. Prof. Peter Fussey, autor wspomnianego raportu, przekazał w komentarzu dla dziennika:

„Rozpoznawanie twarzy na żywo to potężna i natarczywa technologia, która ma realne konsekwencje dla praw jednostek”.

Ilekroć mój wzrok spotyka się z czujnym spojrzeniem ochroniarza, gdy wychodzę ze sklepu odzieżowego, mimo że doskonale wiem, że niczego nie ukradłam, odruchowo zastanawiam się, czy bramki jednak nie zaczną wydawać głośnego dźwięku wstydu z powodu nieodczepionych klipsów zabezpieczających. Sama świadomość bycia obserwowanym sprawia, że czujemy się nieswojo – raczej nie przechodzimy na czerwonym świetle, gdy w pobliżu akurat przejeżdża radiowóz.

Matthew Guariglia z Electronic Frontier Foundation nazywa technologię rozpoznawania twarzy wprost pozostawaniem w trakcie „ciągłego policyjnego okazania”. „Za każdym razem, gdy mają zdjęcie podejrzanego, porównują je z twoją twarzą” – mówi. Kiedy mamy świadomość bycia obserwowanymi, sami stajemy się swoimi „policjantami”.

O krok dalej – czyli od zagrożenia dla prywatności do kontroli i śledzenia

Do tej pory przyglądaliśmy się zastosowaniu technologii rozpoznawania twarzy w demokratycznych państwach. Jednak jej wykorzystanie wykracza poza szeroko pojmowany Zachód – sztuczna inteligencja w tym kontekście zadomowiła się również w Chinach.

Rozpoznawanie twarzy jest tam wykorzystywane nie tylko do identyfikacji sprawców przestępstw – pozwala też na śledzenie osób niezgadzających się z narracją władzy, krytyków systemu i służb. W połączeniu z innymi technologiami (np. śledzenie lokalizacji telefonu, punkty kontrolne wyposażone w czujniki) tworzy ogromne możliwości kontroli obywateli.

Jak podaje „The New York Times”, jest to szczególne groźne dla przedstawicieli mniejszości etnicznych oraz migrantów. Clare Garvie z Centrum Prawnego Uniwersytetu Georgetown mówi w komentarzu dla dziennika:

„Wybierz najbardziej ryzykowne zastosowanie tej technologii, a istnieje duże prawdopodobieństwo, że ktoś ją wypróbuje. […] Jeśli stworzysz technologię, która będzie w stanie klasyfikować ludzi według pochodzenia etnicznego, ktoś użyje jej do represjonowania grupy etnicznej”.

Podsumowanie – czyli powiedzmy sobie prosto w twarz o tej technologii

Badacze z Minderoo Center for Technology and Democracy sporządzili raport dotyczący technologii rozpoznawania twarzy. Przeanalizowali jej działanie w trzech ośrodkach w Wielkiej Brytanii i wydali krytyczne wnioski (s. 65). Evani Radiya-Dixit, jedna z autorek raportu, przekazała:

„Policja wykorzystuje technologię rozpoznawania twarzy, która nie obejmuje wielu znanych praktyk bezpiecznego i etycznego korzystania z wielkoskalowych systemów danych. Problem ten wykracza daleko poza kwestię stronniczości w algorytmach rozpoznawania twarzy”.

Zagrożenie dla prawa do prywatności oraz błędy w dopasowaniach (szczególnie dotyczące niebiałych osób) sprawiły, że niektóre ośrodki wycofały się lub ograniczyły stosowanie rozpoznawania twarzy (m.in. San Francisco czy stan Massachusetts). Kolejne miasta i stany rozważają rezygnację lub wprowadzenie ograniczeń korzystania z tej technologii.

Parlament Europejski również opowiedział się przeciwko wykorzystaniu sztucznej inteligencji w ramach technologii służącej do identyfikacji podejrzanych osób, a także dalej idących rozwiązań takich jak rozpoznawanie emocji.

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter