Omawiamy ważne fakty dla debaty publicznej, a także przedstawiamy istotne raporty i badania.

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Anatomia botnetu – jak powstają sieci kłamstw?

Przybliżamy techniczną stronę botów społecznościowych.

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Anatomia botnetu – jak powstają sieci kłamstw?

Przybliżamy techniczną stronę botów społecznościowych.

We wcześniejszym artykule wyjaśniliśmy, czym są boty i jakie mogę realizować zadania. Marcin Napiórkowski opisał, jak Internet wpływa na nasze emocje oraz jak może to być wykorzystane przez boty, aby zmanipulować nas do rozpowszechniania fake newsów. W poniższym artykule przyjrzymy się, jak można tworzyć botnety oraz jak wykrywać ich działalność.

Bot społecznościowy jako aplikacja potrzebuje infrastruktury technicznej, na którą składają się:

- profil na platformie mediów społecznościowych,

- algorytm stworzony do automatyzacji wykonywanych zadań (lajkowanie, udostępnianie postów, komentowanie), czyli swoiste serce bota,

- dostęp do interfejsu programowania aplikacji (API) danej platformy,

- serwer, na którym aplikacja-bot zostanie umieszczona (hosting).

Dla wszelkich podmiotów pragnących wpłynąć na daną populację poprzez media społecznościowe najlepszym sposobem jest zbudowanie sieci social botów. Istotne jest zaprogramowanie ich tak, aby pisały posty w różnych odstępach czasu, reagowały na określone słowa klucze lub udostępniały wiadomości z innych kont, gdy otrzymają polecenie od botmastera.

Botnet to sieć zainfekowanych złośliwym oprogramowaniem komputerów wykorzystywanych do przeprowadzania oszustw i ataków cybernetycznych. Termin „botnet” powstał z połączenia słów „robot” i „net”.

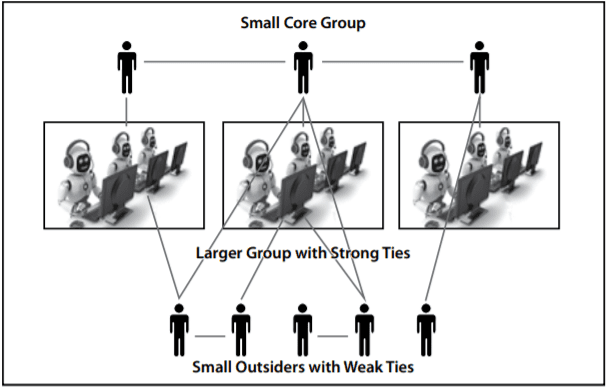

Działanie botnetu

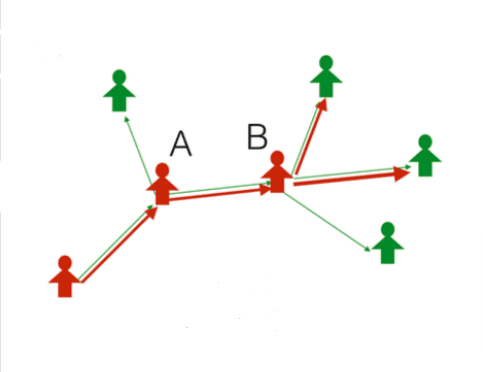

Rysunek z artykułu zespołu badawczego Air University ilustruje podstawy sieci botów. Na szczycie łańcucha znajduje się mała grupa. Składa się ona z kont, które posiadają dużą liczbę obserwujących/śledzących. Zazwyczaj prowadzą je wynajęci/zatrudnieni operatorzy lub „prawdziwi wyznawcy” (bądź inaczej zwani „pożyteczni głupcy”). Pod tą grupą znajdują się główne botnety. W ramach ich działania boty śledzą siebie nawzajem i główną grupę. Układ taki ułatwia algorytmom szybsze wychwytywanie słów-kluczy, które wywołują określone reakcje zautomatyzowanych kont.

Pod siecią botów znajduje się grupa składająca się z ludzi popierających lub nastawionych entuzjastycznie do danego światopoglądu/opcji politycznej/wizji świata bez dużej liczby obserwujących/śledzących. Wystarczająca ilość botów pracujących razem może szybko zapoczątkować trend, ale same konta botów mogą jedynie wypełnić lukę między sieciami, a nie całkowicie zmienić narrację. Aby zmienić narrację/trendy, przeprowadzić operację wpływu, grupa musi – oprócz samego botnetu – wykorzystywać podstawowe elementy działań propagandowych.

Tworzenie botów

O ile trudno jest zbadać pochodzenie i motywy działania sieci botów społecznościowych (tzw. atrybucje), o tyle elementy do ich stworzenia są dość łatwo dostępne.

Jak już wspomnieliśmy wcześniej, do stworzenia social bota potrzebujemy kilku elementów składowych. W przypadku tworzenia botnetów społecznościowych różnica występuje bardziej w zwiększeniu wymagań organizacyjnych niż technicznych przedsięwzięcia.

Aby utworzyć wiele kont w serwisach społecznościowych, nie musimy spędzić nad tym wiele godzin lub zatrudniać do tego ludzi. W Internecie możemy znaleźć wiele ofert sprzedaży już istniejących grup kont.

Wykrywanie botów

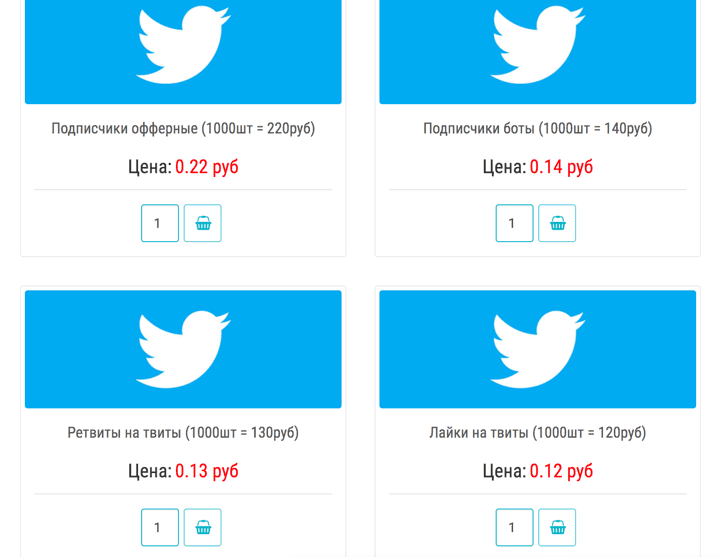

W czasie badań nad skutecznością wykrywania kont-botów na Twitterze zespół IEEE pod kierownictwem Yanchao Zhang stworzył swój własny botnet. Autorzy w raporcie z badania napisali, że zakupili 1 000 kont za 57 dolarów. Natomiast w artykule DFRLab możemy znaleźć odnośniki do oficjalnej strony w Runecie, gdzie można zakupić twitterowe konta-boty, które mogą śledzić, lajkować lub udostępniać dalej czyjeś tweety.

Jako ciekawostkę warto przytoczyć informację dotyczącą właścicieli tych botnetów. W dużej mierze nie są to przestępcy, a przedsiębiorczy Rosjanie, którzy chcą zarobić na życie, pracując w sieci.

W rosyjskim internecie istnieje wiele firm i osób, które otwarcie sprzedają konta na Twitterze, Facebooku i YouTubie. Ich usługi są bardzo tanie, bo tylko 3 dolary za 1 000 followersów. Jest to koszt śledzenia jednego, wskazanego konta przez jeden dzień. Botmaster może zarobić ponad 33 dolary dziennie, śledząc 10 użytkowników i 900 dolarów miesięcznie, czyli dwa razy więcej niż wynosi mediana pensji w Rosji.

Boty społecznościowe można kupić w Dark Webie. Można również znaleźć repozytoria, takie jak GitHub czy GitLab, z kodem źródłowym do tworzenia social botów np. dla serwisu Instagram lub komunikatora Telegram.

Działanie sieci botów

Dostęp do kluczy API różnych portali jest bardzo łatwy. API to określone zestawy reguł, według których programy komputerowe mogą się między sobą komunikować, czyli udostępniać dane. Definiuje, w jaki sposób należy zapytać o dane oraz w jakim formacie będą zwrócone. Jest to jedno z podstawowych narzędzi potrzebnym deweloperom różnych aplikacji. Twitter, Facebook, Instagram, WhatsApp – wszystkie te serwisy udostępniają dokumentację, w której krok po kroku opisują, jak praktycznie każdy użytkownik może pozyskać klucz API.

Najprostszą metodą rozsyłania wszelkiego spamu na portalach społecznościowych jest pozwolenie botom na rozsyłanie wiadomości niezależnie od siebie. Na przykład, zgodnie z regulaminem Twittera, konta uznane za spamerów będą permanentnie zawieszane. Ponieważ portale skanują wiadomości w poszukiwaniu złośliwych adresów URL, może to spowodować trwałe zawieszenie prawie wszystkich botów społecznościowych w krótkim czasie.

Bardziej zaawansowana metoda polega na stworzeniu przez botmastera tzw. drzewa retweetów, w którym wybrana liczba botów jest przypisana do unikalnego wierzchołka „gałęzi”, a za nim podążają obserwujące go inne boty w sieci. Wówczas tylko bot główny jest autorem spamu, a wszystkie pozostałe po prostu udostępniają go dalej. Przy tej metodzie tylko główne boty zostaną zawieszone, a reszta sieci może dalej funkcjonować.

Przykład prostego diagramu drzewa retweetów. Źródło: Choy-Heng Lai, „Mechanistic modelling of viral spreading on empirical social network and popularity prediction”

Przykładami zidentyfikowanych i rozpoznanych kampanii informacyjnych przy wykorzystaniu botów podaje DFRLab na swoim profilu Medium. Dobrze opisane są operacje w Meksyku (wybory prezydenckie i do parlamentu) czy w Malezji (wybory parlamentarne).

Walka z botami

W walce przeciwko social botnetom stają przede wszystkim same portale społecznościowe. Facebook czy Twitter zaostrzają swoje regulaminy. Dodatkowo wprowadzają nowe, bardziej surowe kary, jak np. usuwanie fałszywych treści, obniżanie zasięgów poszczególnych kont czy wręcz blokowanie lub ich usuwanie.

Portale sięgają także po pomoc na zewnątrz. Np. Facebook w ramach programu Third-Party Fact-Checking Program współpracuje z organizacjami fact-checkingowymi zrzeszonymi w sieci IFCN. Do tej sieci należy także Stowarzyszenie Demagog, gdzie działamy w celu oznaczania fałszywych treści. Twitter uruchomił narzędzie Birdwatch (na razie dostępne tylko w USA), dające możliwość oznaczania przez użytkowników dezinformacyjnych wpisów.

Poza portalami społecznościowymi także inne podmioty dołączają do walki z fake-newsami i botami, m.in. organizacje pozarządowe, takie jak DFRLab, który na podstawie swoich doświadczeń opublikował artykuł z 12 poradami, jak rozpoznać bota na Twitterze. Kilka z nich to:

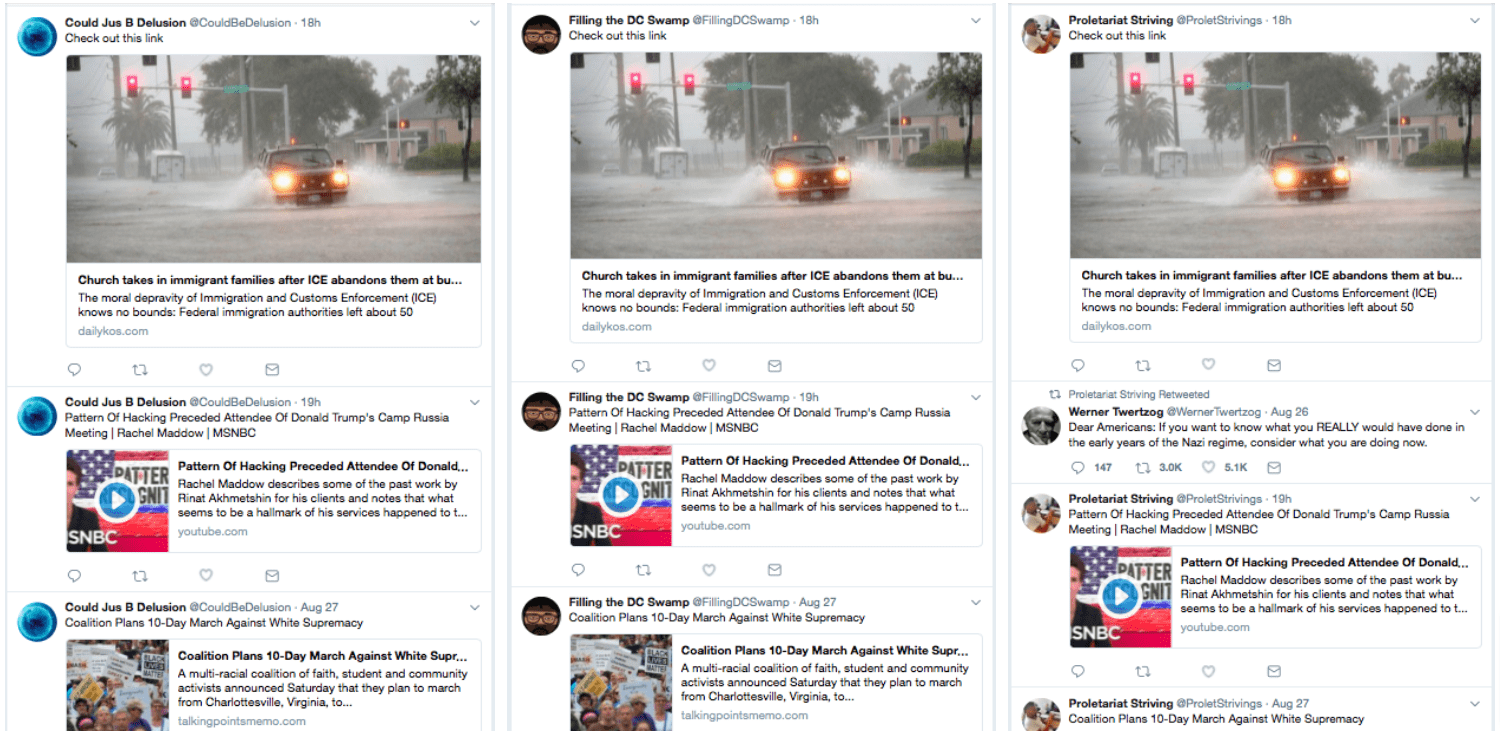

Wspólna treść

Prawdopodobieństwo, że konta należą do jednej sieci, możesz potwierdzić, przeglądając ich posty. Jeśli wszystkie publikują te same treści lub ten sam typ treści, w tym samym czasie, prawdopodobnie są zaprogramowane, aby to robić.

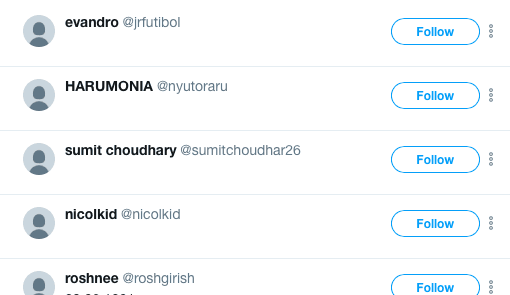

Brak zdjęć profilowych

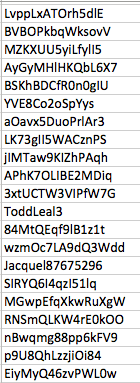

Najbardziej prymitywne boty są szczególnie łatwe do zidentyfikowania, ponieważ ich twórcy nie zadali sobie trudu, by wgrać do nich obrazek awatara. Jeśli lista kont, które retweetują lub lubią dany post, wygląda jak na poniższym zdjęciu, to możesz przyjąć, że są to konta boty.

Skradzione lub udostępnione zdjęcie

Dobrym sprawdzianem prawdziwości konta jest również przeszukanie wsteczne zdjęcia jego awatara, np. poprzez prawe kliknięcie myszą w przeglądarce Chrome i wybranie opcji „Wyszukaj w Google”. Jest to tzw. reverse image search, czyli wsteczne wyszukiwanie obrazem. Technikę tą możesz stosować także przy sprawdzaniu, czy zdjęcia ukazujące się w postach w mediach społecznościowych zostały użyte w innym, zmanipulowanym kontekście.

Wygenerowana nazwa

Kolejnym wskaźnikiem prawdopodobnego bota jest używane przez niego alias, czyli nazwa konta zaczynająca się od znaku „@”. Wiele botów ma aliasy, które są alfanumerycznymi kodami generowanymi przez algorytm, jak na poniższej grafice.

Czasami jednak to my, zwykli użytkownicy Internetu zachowujemy się jak boty. Udostępniamy coś na Facebooku, a potem okazuje się, że nie jest to prawda. Coraz częściej rozpowszechniamy fake newsy jak boty, z automatu. Klikamy i udostępniamy. Najwyższy czas wyłączyć automatyczny tryb i przełączyć się na myślenie!

W tym celu postanowiliśmy zmierzyć się z problemem fake newsów i ich automatycznego udostępniania w naszej kampanii „Nie bądź botem. Włącz myślenie!”. Ze względu na ważną tematykę w działania promocyjne zaangażowali się popularni twórcy internetowi, którzy zwracają uwagę na temat fake newsów. Powstała specjalna strona internetowa, na której znajdziesz więcej porad na temat tego, jak nie dać się nabrać i nie przesyłać dalej niezweryfikowanych informacji oraz w jaki sposób szukać tych prawdziwych i rzetelnych.

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter