Artykuł

Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

„Matrioszka”: rosyjska kampania dezinformacyjna uderza w media i fact-checkerów

Wrogie działania Rosji w internecie nie ograniczają się do rozpowszechniania fałszywych informacji. Od kilku miesięcy sieć trolli sprzyjających Kremlowi prosi organizacje factcheckingowe o… sprawdzanie antyukraińskich treści. Wydaje się, że to absurd, lecz kryje się za nim sposób na wzmacnianie dezinformacji.

fot. Pixabay / Pexels / Modyfikacje: Demagog

„Matrioszka”: rosyjska kampania dezinformacyjna uderza w media i fact-checkerów

Wrogie działania Rosji w internecie nie ograniczają się do rozpowszechniania fałszywych informacji. Od kilku miesięcy sieć trolli sprzyjających Kremlowi prosi organizacje factcheckingowe o… sprawdzanie antyukraińskich treści. Wydaje się, że to absurd, lecz kryje się za nim sposób na wzmacnianie dezinformacji.

Rosja produkuje fałszywe informacje m.in. po to, by pogorszyć wizerunek Ukrainy i zniechęcać do udzielania jej pomocy. Jednym z filarów rosyjskiej dezinformacji są działania w mediach społecznościowych i szerzej pojętej cyberprzestrzeni. Podczas analizowania zjawisk w internecie można natrafić nie tylko na pojedyncze fałszywe informacje, lecz także na całe kampanie dezinformacyjne.

Jedną z nich w połowie 2022 roku badał zespół EU DisinfoLab. Polegała ona na tworzeniu i rozpowszechnianiu dezinformacyjnych materiałów przez podmioty podszywające się pod duże media i agencje prasowe. Od podszywania wzięła się nazwa kampanii – „Doppelganger”, czyli „Sobowtór”.

W Demagogu kilka miesięcy wcześniej opisywaliśmy sieć profili stworzonych w mediach społecznościowych w tym samym celu i przypominających lokalne media w Polsce.

Na początku 2024 roku fact-checkerzy z Francuskiej Agencji Prasowej (AFP Factuel) informowali o nowej kampanii dezinformacyjnej. Opisane przez nich działania rosyjskich trolli rozpracował zespół Antibot4Navalny. Aktualna kampania jest wymierzona w media i inicjatywy factcheckingowe, w tym także polskie: Demagoga, Konkret24, FakeNews.pl i Pravdę. Wyjaśniamy, na czym polega ta kampania, jaki może być jej cel i co należy wobec niej zrobić.

Na czym polega nowa kampania dezinformacyjna?

AFP Factuel opisało sposób działania kont zaangażowanych w kampanię na jednym przykładzie. 4 grudnia 2023 roku użytkowniczka Käthe skomentowała na portalu X wpis francuskiej telewizji BFM i poprosiła o sprawdzenie wiarygodności filmu. Przypominał on materiał niemieckiego Deutsche Welle i informował, że ukraiński artysta próbował przepiłować wieżę Eiffla.

W ciągu kilku godzin ten sam profil zostawił podobne komentarze pod wpisami dziesiątek francuskich mediów. Konto pozostawało potem nieaktywne aż do 20 grudnia, gdy samo opublikowało fałszywą informację o graffiti w Los Angeles, które miało przedstawiać Wołodymyra Zełenskiego jako żebraka. Inne konto poprosiło wówczas o weryfikację tej informacji.

Mamy więc do czynienia z siecią profili, które z jednej strony publikują fałszywe informacje, a z drugiej podają w komentarzach wpisy innych profili z sieci z prośbą o ich sprawdzenie. Zespół Antibot4Navalny przekazał nam zbiór danych, z którego wynika, że na portalu X w kampanię jest zaangażowanych przynajmniej 170 kont.

„Matrioszka” – skąd taka nazwa kampanii?

Podczas naszej kampanii „Docieraj do źródła prawdy” wyjaśnialiśmy, że rosyjska dezinformacja jest jak matrioszka – przykrywa prawdę kolejnymi warstwami kłamstw. Według zespołu Antibot4Navalny powiązania między kontami na X, które biorą udział w tej akcji, także przypominają drewnianą lalkę, w której znajdują się kolejne lalki coraz mniejszych rozmiarów. Stąd nadana przez zespół nazwa kampanii – „Matrioszka”.

Pierwsze, co widzimy, to duża lalka – komentarz konta A proszący o sprawdzenie fejka podanego przez konto B – mniejszą lalkę. Następnie okazuje się, że konto B także prosiło o sprawdzenie innego fejka podanego przez jeszcze mniejszą lalkę – konto C. Może się okazać, że konto C także kiedyś prosiło o sprawdzenie jeszcze innego fejka podanego przez konto D itd., itd.

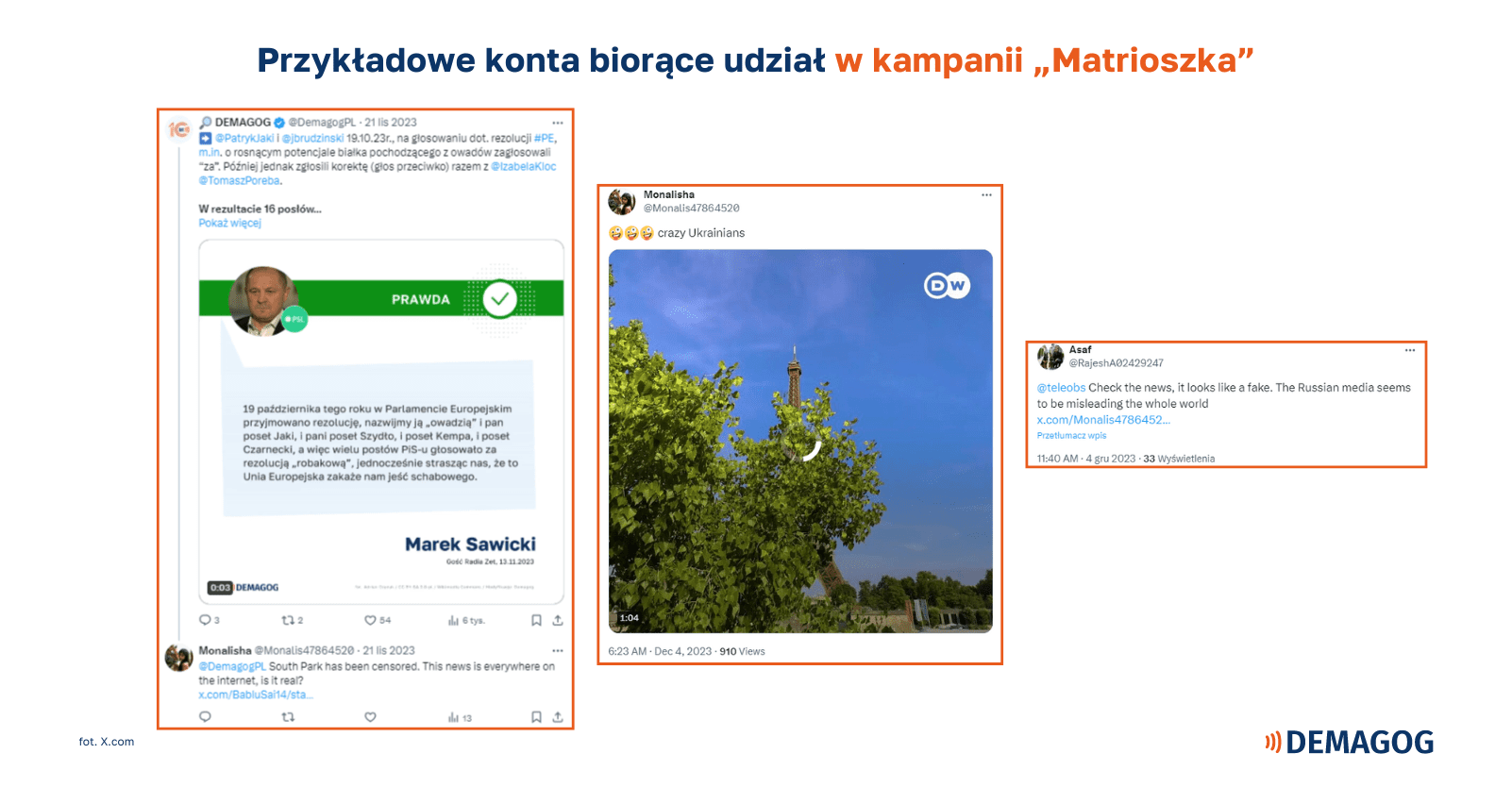

Przykładowe konta biorące udział w kampanii „Matrioszka”. Do połowy 2020 roku konto Monalisha publikowało zwyczajne zdjęcia i wpisy. Po długiej przerwie 21 listopada Monalisha zostawiła komentarze pod wpisami kilkudziesięciu innych kont, w tym Demagoga, z prośbą o weryfikację fałszywej informacji (zrzut ekranu z lewej). Po kolejnej przerwie 4 grudnia Monalisha sama opublikowała fałszywą informację (zrzut ekranu w środku). Cztery godziny później inne konto, „Asaf”, prosiło o sprawdzenie tej informacji (zrzut ekranu z prawej).

Z przekazanych nam danych Antibot4Navalny wynika, że najdłuższy taki ciąg łączył ze sobą sześć różnych profili. Może pojawić się pytanie – jaki jest cel tak złożonych kombinacji? Przecież równie dobrze jeden zespół kont mógłby tylko podawać fałszywe informacje, a drugi wyłącznie prosić o ich sprawdzenie.

Według Antibot4Navalny potencjalny powód to ochrona kont przed zawieszeniem za publikowanie samych fałszywych informacji. Niewykluczone jednak, że celem jest zdobywanie obserwatorów zainteresowanych sprawdzaniem fałszywych informacji, a potem karmienie ich fejkami. Możliwe także, że autorzy akcji chcą przekonywać, że skoro te same osoby obalają fałszywe informacje i je podają, to nie wiadomo już, co jest prawdą.

Skąd wiemy, że w kampanii biorą udział trolle?

Do prowadzenia kampanii dezinformacyjnych bywają używane fałszywe lub skradzione konta sterowane zarówno przez programy komputerowe (boty), jak i przez prawdziwe osoby (trolle). Przykładowo we wspomnianą akcję „Sobowtór” zaangażowane były boty podszywające się pod znane media. W przypadku „Matrioszki” również można podejrzewać, że mamy do czynienia z siecią fałszywych lub skradzionych profili.

W przypadku kampanii „Matrioszka” o nieautentyczności kont świadczy opisany wyżej schematyczny sposób działania. Jeśli spojrzymy na komentarze pod wpisami Demagoga, nasze podejrzenia wzbudzi także fakt, że zostawiają je profile osób, których zwykle nie spotykamy wśród naszych czytelników, np. z państw Azji (1, 2, 3).

Narzędzie AI Detector firmy Hive wykazuje, że zdjęcia profilowe niektórych z tych kont są wygenerowane przez sztuczną inteligencję (1, 2, 3). Poza tym niektóre mogą być wykradzione lub kupione – Antibot4Navalny zauważył, że jeden profil, który zaczął podawać fałszywe informacje, był niedługo przedtem wystawiony na sprzedaż.

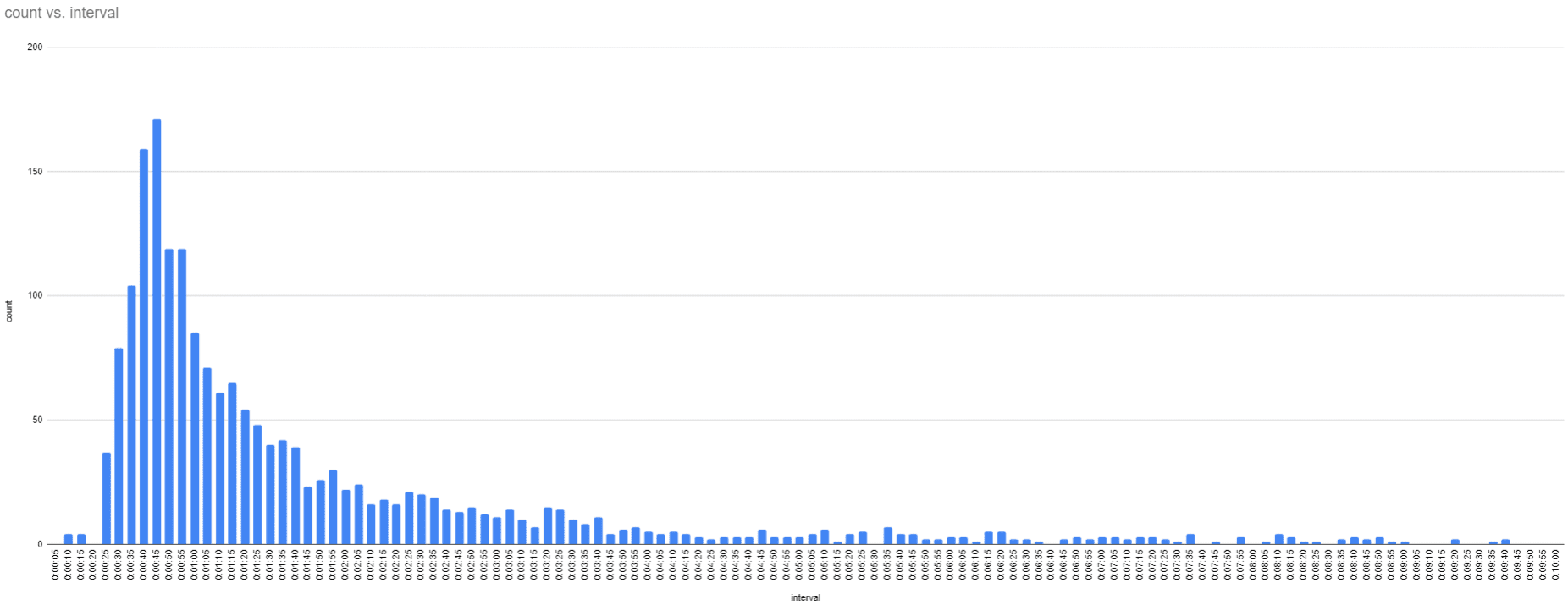

O tym, że kontami kierują prawdziwe (być może zatrudnione do tego) osoby, a nie – programy, świadczy analiza ich aktywności. Jak ustalił na podstawie ponad 2000 wpisów zespół Antibot4Navalny, przerwy między wpisami jednego konta wynoszą najczęściej 45 sekund, gdy w przypadku prowadzonej przez boty kampanii „Sobowtór” wynosiły one maksymalnie 6 sekund.

Wykres przedstawiający najczęściej spotykane przerwy czasowe między poszczególnymi wpisami kont zaangażowanych w kampanię „Matrioszka”. Źródło: Antibot4Navalny

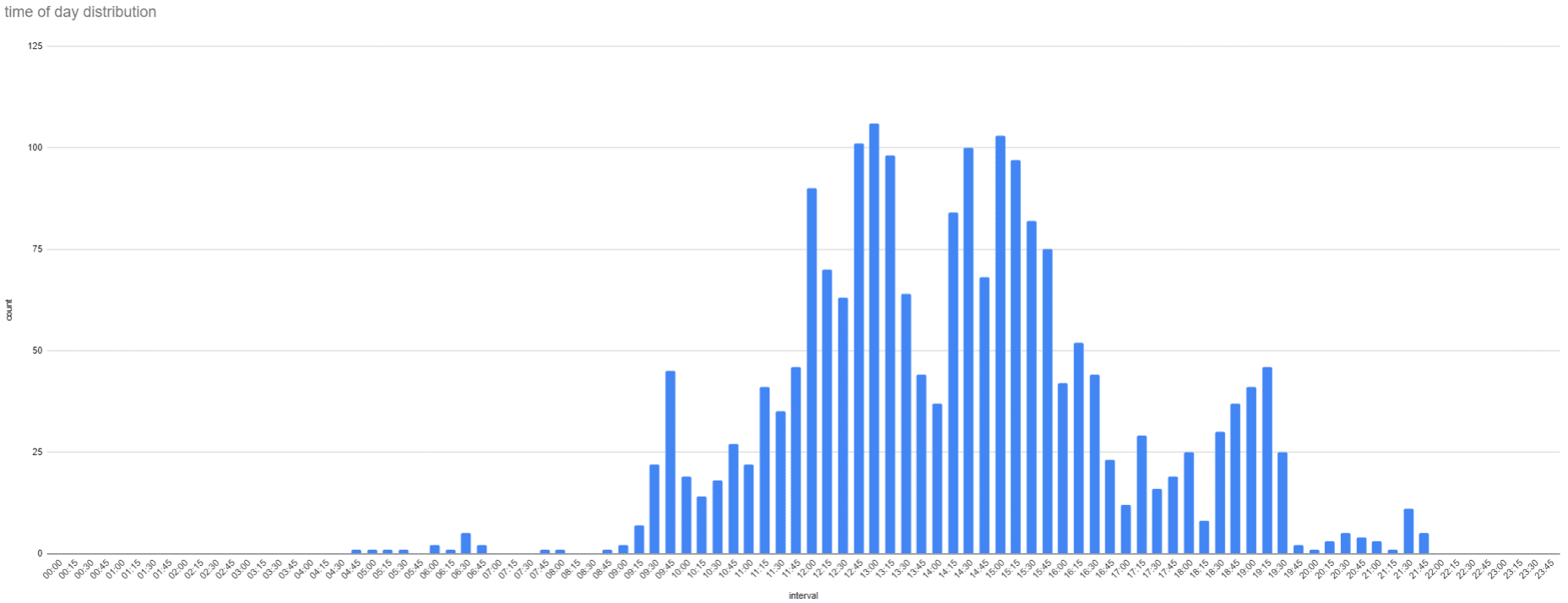

Ponadto zaangażowane w kampanię konta są aktywne często między 9:00 a 17:00, czyli w typowych godzinach pracy.

Wykres przedstawiający godziny publikacji wpisów przez konta zaangażowane w kampanię „Matrioszka”. Źródło: Antibot4Navalny

Skąd wiemy, że za kampanią stoją Rosjanie?

Nietrudno poznać, że profile zaangażowane w kampanię „Matrioszka” sprzyjają Kremlowi. Wystarczy spojrzeć na przykłady podawanych przez nie fałszywych informacji, które opisał AFP Factuel: ukraiński artysta przeciął wieżę Eiffla, graffiti w Los Angeles i Paryżu wyśmiewa Wołodymyra Zełenskiego, Ukrainiec zrabował katakumby w Paryżu itp. Takie materiały mają psuć wizerunek Ukraińców lub udowadniać niechęć Zachodu do Ukrainy.

Podobne same wnioski można wyciągnąć na podstawie komentarzy pojawiających się pod wpisami Demagoga. Dodatkowo widać, że część z nich jest podobna do tych używanych w kampanii „Sobowtór”.

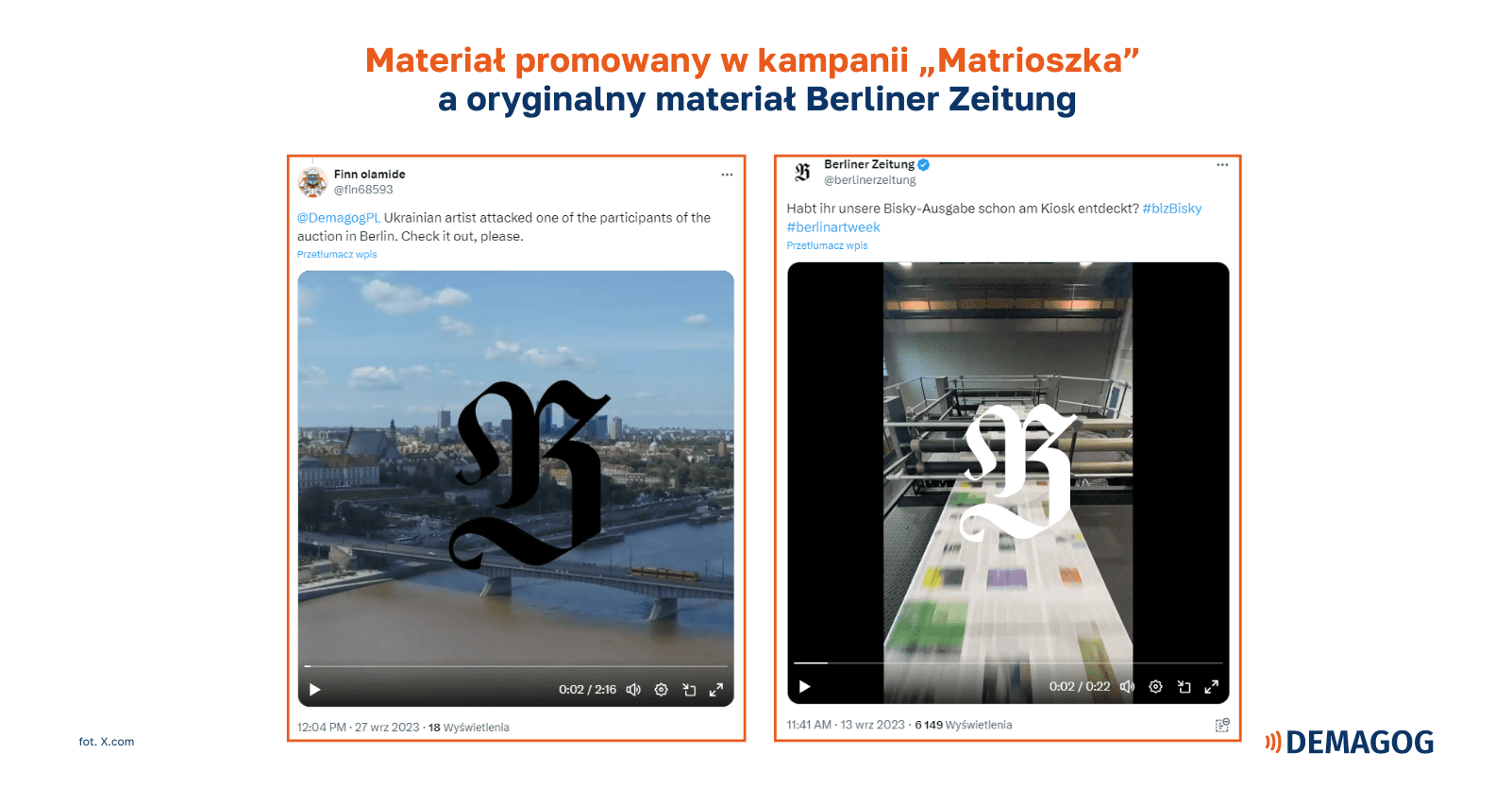

Na przykład fałszywa opowieść o Ukraińcach, którzy próbowali wyłudzić okup od rodziny osoby porwanej przez Hamas, była przedstawiona jako wiadomość niemieckiego radia WDR 1. Z kolei niepotwierdzona w żadnym innym źródle informacja o ukraińskim artyście, który wszczął awanturę podczas wystawy w Berlinie, przypominała materiał dziennika „Berliner Zeitung”.

Przykładowy film podany pod wpisem Demagoga i podszywający się pod niemiecki dziennik „Berliner Zeitung” (zrzut ekranu z lewej). Dla porównania – oryginalny film „Berliner Zeitung” z tego samego miesiąca (zrzut ekranu z prawej).

O rosyjskim pochodzeniu wpisów świadczy jednak nie tylko sprzyjająca Rosji tematyka, lecz przede wszystkim wpadki językowe. Przykładowo wpis promujący fałszywą informację o graffiti przedstawiającym pluskwę zawierał zamiast angielskiego słowa „bedbug” rosyjskie „klop”.

W innym miejscu nazwisko „Zełenska” przetłumaczono nie jako „Zelenska” tylko „Zelens-Koy” (rosyjski dopełniacz rodzaju żeńskiego). Z kolei angielskie słowo określające ukrytą wiadomość w jakimś materiale, a dosłownie oznaczające jajo wielkanocne, przetłumaczono nie jako „easter egg”, lecz jako „paschalka”, co także jest słowem rosyjskim.

W kogo celuje kampania?

Nie tylko factcheckingowa inicjatywa Francuskiej Agencji Prasowej i Demagog stały się celami „Matrioszki”. Na przykład konto Monalisha jednego dnia zostawiło komentarze pod wpisami blisko 100 innych profili poza Demagogiem.

Z przekazanych nam danych zespołu Antibot4Navalny wynika, że kampania „Matrioszka” obrała sobie za cel przynajmniej 557 różnych profili na portalu X. Wśród nich znajdziemy nie tylko inicjatywy factcheckingowe, lecz także media oraz instytucje zaangażowane w pomoc Ukrainie. To m.in.:

- @DemagogCZ – bliźniacza polskiemu Demagogowi czeska inicjatywa factcheckingowa, oznaczona 14 razy;

- @fakenews_pl – polska fundacja factcheckingowa, oznaczona 14 razy;

- @Jan_Kunert – dziennikarz serwisu factcheckingowego Konkret24, oznaczony 14 razy;

- @pravda_org – polskie stowarzyszenie factcheckingowe, oznaczone 8 razy;

- @eurofactcheck – Europejska Sieć Standardów Factcheckingowych (EFCSN), oznaczona 14 razy;

- @factchecknet – Międzynarodowa Sieć Factcheckingowa (IFCN), oznaczona 5 razy;

- @EDMO_EUI – Europejskie Obserwatorium Mediów Cyfrowych (EDMO), oznaczone 15 razy;

- @UEDelegetionUA – Delegacja Unii Europejskiej w Ukrainie, oznaczona 4 razy;

- @EU_NEAR – Dyrekcja Generalna Polityki Sąsiedztwa UE i Negocjacji ws. Rozszerzenia (DG NEAR), oznaczona 3 razy.

Dla porównania profil Demagoga został do tej pory oznaczony w ramach kampanii „Matrioszka” 11 razy. Najczęściej oznaczanym kontem było @dwnews (niemieckiego Deutsche Welle) – zdarzyło się to 22 razy.

Wśród organizacji factcheckingowych najwięcej komentarzy od trolli otrzymały: @AFPfaktaFIN (factcheckingowa inicjatywa AFP w Finlandii, 17 oznaczeń) i @correctiv_org (niemiecki zespół dziennikarzy śledczych, 16 oznaczeń). Zespół Antibot4Navalny zastrzega, że zapewne nie zebrał wszystkich wpisów opublikowanych w ramach „Matrioszki”.

Jaki może być cel kampanii „Matrioszka”?

Wiemy zatem, że istnieje sieć kont, które na portalu X publikują fałszywe informacje uderzające w Ukrainę, a potem proszą o ich sprawdzenie organizacje factcheckingowe, media oraz instytucje. Pytanie tylko, dlaczego profile proszą o sprawdzanie fałszywych informacji – zamiast tylko przekonywać, że są one prawdziwe? Zespół Antibot4Navalny wyjaśnił to w następujący sposób:

„Jedno z najprostszych wyjaśnień może brzmieć: ponieważ już tworzymy dziesiątki fałszywych informacji tygodniowo dla odbiorców w Rosji, z których każda promowana jest przez konta i strony podszywające się pod zachodnie media (i mówi, że Zachód ustępuje, jest zmęczony sankcjami, przestaje wspierać Ukrainę), to moglibyśmy użyć tych samych fałszywych informacji dla jeszcze jednego celu: zwiększenia obciążenia fact-checkerów przy zerowych kosztach”.

Być może osoby odpowiedzialne za kampanię „Matrioszka” chcą wykorzystać w praktyce żartobliwe prawo Brandoliniego inaczej zwane „zasadą asymetrii bzdur”. W oryginale podanym przez włoskiego programistę Alberto Brandoliniego brzmi ono: „Ilość energii potrzebna do obalenia bzdury jest o rząd wielkości większa niż ilość energii potrzebnej do jej wyprodukowania”.

Gdy bzdur do wyjaśnienia będzie zbyt wiele, może nam zabraknąć sił i środków. Antibot4Navalny ostrzega, że w każdej chwili liczba zgłoszeń kierowanych do fact-checkerów może zostać zwiększona dziesięciokrotnie. Wystarczą do tego kolejne fałszywe konta i odpowiednia moc obliczeniowa, a to stosunkowo tanie i łatwo dostępne zasoby.

W takiej sytuacji odsianie masy w oczywisty sposób fałszywych materiałów, które nie zdobyły dużych zasięgów w Polsce, od rzeczywiście niebezpiecznej dezinformacji, której warto poświęcić czas, może stać się trudne i doprowadzić do bezsensownego wykorzystania naszej pracy.

Możliwe, że to dopiero początek kampanii

Niewykluczone, że kampania „Matrioszka” jest dopiero w fazie eksperymentalnej. Jej autorzy mogą testować różne rozwiązania, aby jak najskuteczniej wpłynąć na pracę fact-checkerów i zdobyć jak największe zasięgi.

Świadczyć może o tym wciąż stosunkowo niewielka liczba wpisów. Do tej pory profilom zaangażowanym w akcję nie udało się wpłynąć znacząco na naszą pracę. Z podanych wyżej informacji wynika, że jedno konto jest oznaczane zwykle kilka lub kilkanaście razy w ciągu kilku miesięcy – najstarszy wpis pochodzi z września 2023 roku.

Kolejnym dowodem na testowanie różnych rozwiązań może być fakt, że od jakiegoś czasu zgłoszenia fałszywych informacji trafiają do nas także innymi drogami – poprzez formularz zgłoszeniowy oraz email (1, 2, 3, 4, 5). Tylko jeden z nich został oznaczony przez nasze systemy zabezpieczeń jako phishing.

Wiemy, że nie tylko Demagog otrzymuje takie wiadomości mailowe. Tylko w pierwszej połowie kwietnia do węgierskiej organizacji factcheckingowej Lakmusz przyszły cztery podobne maile, z czego trzy z adresów, które pisały także do nas.

Co wobec tej kampanii może zrobić zwykły użytkownik?

Zarówno organizacje factcheckingowe, jak i każdy z użytkowników portalu X, mogą skutecznie ograniczać potencjalnie negatywny wpływ kampanii „Matrioszka”. Warto wiedzieć, jak odróżnić trolla i bota od autentycznego profilu. Podstawowe rady w tym zakresie przedstawił Antibot4Navalny.

Matryoshka 🪆 bots flood fact checkers with knowing falsehoods.

How to spot a 🪆 and save time?

🚩 Is it posting the same ❓ and 🖼️ / 🎞️ to dozens of media?

🚩 In case if it quotes other user, were there dozens of identical requests from them?If so, congrats on spotting 🪆! pic.twitter.com/UEmsW33bbb

— bot blocker | блокировщик ботов (@antibot4navalny) February 13, 2024

Jak widać, nie jest to trudne. W przypadku kampanii „Matrioszka” wystarczy zauważyć, że dane konto udostępnia na swoim profilu lub w komentarzach tę samą treść wielokrotnie jednego dnia – to zachowanie typowe dla bota lub trolla.

Co wobec tej kampanii mogą zrobić organizacje factcheckingowe?

Organizacje factcheckingowe i media zachęcamy do przeszkolenia swoich pracowników z rozpoznawania botów i trolli. Szczególnie ważne, by posiadły tę umiejętność osoby wybierające spośród zgłoszeń materiały do analiz. Zachęcamy do zapoznania się z naszą ofertą szkoleniową, którą kierujemy także do redakcji medialnych.

Zapraszamy również do kontaktu z nami, bo tylko razem możemy skutecznie przeciwdziałać dezinformacji.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter