Sprawdzamy wypowiedzi polityków i osób publicznych pojawiające się w przestrzeni medialnej i internetowej. Wybieramy wypowiedzi istotne dla debaty publicznej, weryfikujemy zawarte w nich informacje i przydzielamy jedną z pięciu kategorii ocen.

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Ilu Polaków ufa sztucznej inteligencji?

Ten artykuł ma więcej niż 3 lata. Niektóre dane mogą być nieaktualne. Sprawdź, jak zmieniała się metodologia i artykuły w Demagogu.

Ilu Polaków ufa sztucznej inteligencji?

W Polsce (…) dużo większy poziom braku zaufania do sztucznej inteligencji obserwujemy niż na przykład w Czechach czy na Węgrzech, mówiąc o naszych bliskich sąsiadach.

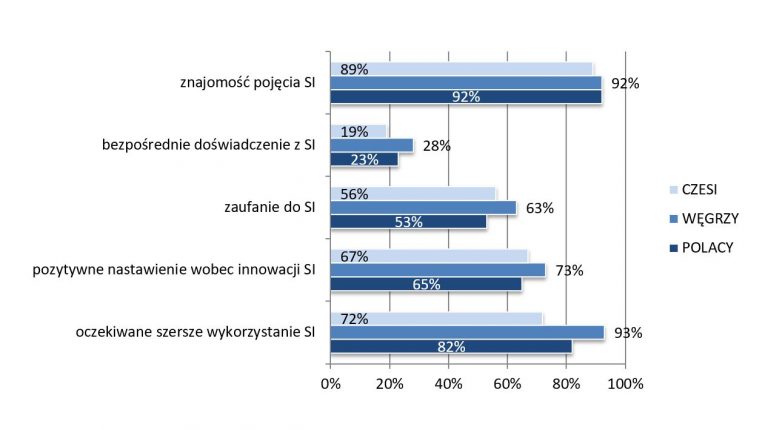

- Jak wynika z badania przeprowadzonego przez przedsiębiorstwo International Business Machines Corporation, 53 proc. Polaków ufa technologii sztucznej inteligencji.

- W krajach wspomnianych przez ministra Zagórskiego, czyli w Czechach i na Węgrzech, odsetek ten wynosi kolejno 56 i 63 proc.

- Polacy faktycznie ufają sztucznej inteligencji mniej, ale różnica między nami a Czechami wynosi tylko 3 punkty proc., więc nie jest ona tak duża, jak twierdzi Marek Zagórski. Z tego powodu wypowiedź oceniamy jako manipulację.

Kontekst wypowiedzi

Marek Zagórski był 12 stycznia gościem programu „Sygnały Dnia”. Jako pełnomocnik rządu do spraw cyberbezpieczeństwa odnosił się przede wszystkim do planów wprowadzenia e-rejestracji na terminy szczepień, ale rozmowa dotyczyła także kwestii sztucznej inteligencji oraz jej rozwoju w Polsce.

Tego samego dnia w Monitorze Polskim ukazała się przyjęta pod koniec grudnia uchwała w sprawie ustanowienia „Polityki dla rozwoju sztucznej inteligencji w Polsce od roku 2020”. Omawiając zawarte w niej założenia i plany rządu, minister wspomniał także o postawach, jakie Polacy przyjmują względem sztucznej inteligencji, zaznaczając, że w naszym kraju poziom zaufania do tej technologii jest o wiele mniejszy niż w innych państwach naszego regionu – w Czechach oraz na Węgrzech.

Zaufanie do sztucznej inteligencji

Przez sztuczną inteligencję powinniśmy rozumieć wszelkie nowe technologie, które posługują się zaawansowanymi algorytmami komputerowymi oraz analizą dużych zbiorów danych, aby móc podejmować decyzje i przeprowadzać rozumowania logiczne w celu wykonywania wyznaczonych zadań. Oczywiście nie oznacza to, że mamy już do czynienia z maszynami, które są świadome – obecnie rozwijana jest tylko tzw. weak AI, czyli sztuczna inteligencja, która symuluje systemy racjonalnego myślenia występujące u ludzi. Technologię tę wykorzystuje się przykładowo w systemach eksperckich i usprawniających podejmowanie decyzji, systemach rozpoznających mowę lub obrazy, przy nadzorowaniu procesów technologicznych w fabrykach, a także w asystentach głosowych w telefonie, takich jak Siri czy Asystent Google.

Informacje podane przez Marka Zagórskiego na temat zaufania do sztucznej inteligencji w krajach Europy Środkowo-Wschodniej możemy zweryfikować na podstawie wyników badania, które we wrześniu oraz październiku 2018 roku IBM przeprowadziło na grupie 1521 osób w wieku 18-65 lat z Polski, Czech i Węgier. Respondenci zostali poproszeni wyrażenie opinii o pięciu zagadnieniach związanych ze sztuczną inteligencją. Rozkład odpowiedzi prezentuje poniższy wykres:

Jak możemy zauważyć, najbardziej pozytywnie do SI nastawieni są Węgrzy – 63 proc. ankietowanych z tego kraju ufa sztucznej inteligencji. Pomiędzy Polakami a Czechami są jedynie 3 punkty proc. różnicy – wśród badanych Polaków 53 proc. ufa sztucznej inteligencji, a pośród Czechów odsetek ten wynosi 56 proc.

Warto też zwrócić uwagę, że 65 proc. Polaków jest pozytywnie nastawionych wobec innowacji SI (Czesi 67 proc., Węgrzy 73 proc.). Aż 82 proc. naszych rodaków oczekuje też szerszego wykorzystania SI – wynik Polski jest w tej kategorii o 10 punktów proc. lepszy niż w przypadku naszych południowych sąsiadów (Czechy 72 proc.), ale o 11 punktów proc. gorszy od Węgier.

Prawdą jest, że spośród trzech uwzględnionych w sondażu grup badawczych to Polacy okazali najmniejsze zaufanie do sztucznej inteligencji, ale ciężko uznać, że odbiegają oni bardzo mocno od pozostałych badanych narodowości. Różnica między odsetkiem osób ufających SI w Polsce i w Czechach wynosi tylko 3 punkty proc. Zaufanie do sztucznej inteligencji w innych krajach Europy Środkowo-Wschodniej nie jest więc „dużo większe” niż u nas. W związku z tym wypowiedź oceniamy jako manipulację.

Europejskie podeście do doskonałości i zaufania AI

Warto przy tej okazji podkreślić, że instytucje unijne aktywnie pracują na rzecz wypracowania zarówno bardziej zaufanej sztucznej inteligencji, jak i wzrostu świadomości oraz zaufania obywateli wobec tej technologii. W tym celu prowadzone są działania mające zwiększyć wiedzę, a tym samym chęć korzystania Europejczyków z najnowszej i sprawdzonej sztucznej inteligencji – zarówno w biznesie, medycynie, jak i życiu codziennym. Z informacji zawartych na stronie Komisji Europejskiej możemy dowiedzieć się m.in., że przewidziane na lata 2019-2024 unijne środki przeznaczone na rozwój SI wynoszą 1,5 mld euro i są o 70 proc. większe niż w poprzednim okresie. Celem działań KE jest przyciągnięcie w ciągu kolejnego dziesięciolecia inwestycji na sumę aż 20 mld euro.

W celu budowania zaufania do sztucznej inteligencji instytucje unijne planują m.in.: ustanowienie nowych przepisów dotyczących SI dostosowanych do stopnia ryzyka, opracowanie wymogów dotyczących systemów charakteryzujących się wysokim ryzykiem, wprowadzenie bezstronnych zbiorów danych, a także zainicjowanie ogólnounijnej debaty na temat środków zdalnej identyfikacji (np. rozpoznawania twarzy). Ponadto, w celu wyznaczenia konkretnych ram, wedle których użytkowana może być etyczna i zaufana sztuczna inteligencja, Komisja Europejska wydała w 2018 roku wytyczne, dostępne również w języku polskim.

Według ekspertów sztuczna inteligencja powinna być rozwijana z poszanowaniem praw podstawowych, demokracji i zasad etyki. Podejście to możemy zdefiniować jako „zorientowane na człowieka”. Eksperci wyróżnili cztery fundamenty, które zapewniają realizację powyższych priorytetów:

1. Poszanowanie autonomii człowieka – rozwój sztucznej inteligencji musi zapewniać wolność i autonomię człowieka, poprzez umożliwienie mu korzystania z technologii, która nie używa manipulacji, wymuszania czy prób wpływania na decyzje. Zamiast tego powinna być wykorzystywana w celu wzmacniania i uzupełniania zdolności poznawczych i społecznych użytkowników.

2. Zapobieganie szkodom i zagrożeniom – sztuczna inteligencja powinna być zaprojektowana w sposób przeciwdziałający szkodom i zagrożeniom (zarówno technicznym, jak i społecznym). Mowa tu również o sytuacjach, w których sztuczna inteligencja może powodować lub nasilać asymetrię władzy bądź negatywnie wpływać na zrównoważony rozwój środowiska naturalnego.

3. Uczciwość i sprawiedliwość – nowoczesne technologie powinny być dystrybuowane sprawiedliwie, a więc z uwzględnieniem wszystkich grup społecznych. Oznacza to zapewnienie równego dostępu do edukacji, towarów i usług, a także samej technologii. Ważne, aby sztuczna inteligencja w żaden sposób nie prowadziła do ograniczenia wolności wyboru.

4. Transparentność i możliwość wytłumaczenia – godna zaufania sztuczna inteligencja musi być łatwa do wyjaśnienia i transparentna. Konieczna jest wiedza o algorytmach i sposobie podejmowania decyzji przez system, a także możliwość dotarcia przez użytkowników do potrzebnej im wiedzy na temat danej technologii.

Raport NASK „Sztuczna inteligencja w społeczeństwie i gospodarce”

Innym wartym przytoczenia źródłem jest raport z badania sondażowego z 2019 roku, autorstwa ekspertów z Naukowej i Akademickiej Sieci Komputerowej – Państwowego Instytutu Badawczego (NASK). Badanie dotyczyło stosunku Polaków do zagadnienia sztucznej inteligencji.

Zgodnie z wynikiem badań:

- Około 40 proc. polskich internautów jest gotowych korzystać z samochodowego transportu bezzałogowego. Zaledwie co szósty (14,6 proc.) respondent skorzystałby z usług medycznych, w których lekarza zastępują rozwiązania oparte na SI. Jedynie 8 proc. badanych miałoby zaufanie do SI zatrudnionej przy podejmowaniu osobistych decyzji, dotyczących sfery emocjonalno-psychicznej. Niemal co trzeci respondent (30,9 proc.) jest natomiast pozytywnie nastawiony do kwestii zastąpienia nauczycieli przez technologie oparte na SI.

- Badani życzyliby sobie, aby SI była wykorzystywana przede wszystkim w celach profesjonalnych: zastąpienia najcięższych i najbardziej niebezpiecznych prac wykonywanych przez człowieka (63,1 proc.) oraz jako forma wspomagania w wykonywanych zadaniach (59,1 proc.). Respondenci chcieliby także, aby SI stosowana była w celu bardziej racjonalnego gospodarowania energią i zasobami naturalnymi (39,7 proc.).

- Polscy internauci obawiają się, że wraz z rozwojem SI ich prywatność będzie mogła być stale śledzona (60,5 proc.), bezrobocie wzrośnie (40,1 proc.) i będzie coraz więcej cyberataków (37,7 proc.).

- Respondenci oczekują, że pewne kwestie związane ze sztuczną inteligencją wymagają regulacji prawnych. W szczególności chodzi o bezpieczeństwo danych (57,4 proc.), prywatność (47,8 proc.) oraz bezpieczeństwo użytkowników (46,3 proc.). Zaledwie 4,5 proc. badanych uważa, że rozwój technologiczny nie powinien być regulowany. Według internautów odpowiedzialni za regulacje powinni być parlament i rząd (53,7 proc.), a także organizacje międzynarodowe (48,9 proc.).

Polski program rozwoju sztucznej inteligencji

Tego samego dnia, kiedy Marek Zagórski udzielał wywiadu w radiowej Jedynce, w Monitorze Polskim opublikowana została uchwała dotycząca ustanowienia „Polityki dla rozwoju sztucznej inteligencji w Polsce od roku 2020”. Program opracowywany był od czterech lat w ramach „Polskiej drogi do Strategii AI”, a ostateczna wersja jego projektu została zaprezentowana 28 grudnia 2020 roku.

Dokument zawiera m.in. szerokie opracowanie możliwości i potencjału wdrożenia sztucznej inteligencji w Polsce, informacje na temat kierunków rozwoju tej technologii oraz konkretnego planu tej drogi. Opisany został zarówno potencjał sztucznej inteligencji, dotychczasowe osiągnięcia Polski na tym polu, możliwe źródła finansowania oraz wyznaczone cele, rozłożone na sześć obszarów strategicznych: „AI i społeczeństwo”, „AI i innowacyjne firmy”, „AI i nauka”, „AI i edukacja”, „AI i współpraca międzynarodowa”, „AI i sektor publiczny”. Ponadto, w ramach każdej z tych kategorii wyznaczone zostały konkretne cele, wraz z docelowymi datami ich realizacji: cele krótkoterminowe (do 2023 roku), cele średnioterminowe (do 2027 roku) oraz cele długoterminowe (bez podanej daty zakończenia).

Warto również podkreślić, że „Polityką AI” ma docelowo zajmować się minister właściwy do spraw informatyzacji. Pierwsze informacje o realizacji działań wyznaczonych w omawianej strategii ma on przedstawić Radzie Ministrów do 1 września 2021 roku.

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter