Informujemy o najważniejszych wydarzeniach ze świata fact-checkingu.

Dobre nawyki seniora w sieci – cz. 5: Sztuczna inteligencja

Dowiedz się, jak nie dać się nabrać na treści wygenerowane przez sztuczną inteligencję.

fot. Pexels / Modyfikacje: Demagog

Dobre nawyki seniora w sieci – cz. 5: Sztuczna inteligencja

Dowiedz się, jak nie dać się nabrać na treści wygenerowane przez sztuczną inteligencję.

Rozwój technologii sprawia, że tworzenie fałszywych treści staje się coraz łatwiejsze. Dzięki zastosowaniu sztucznej inteligencji przestępcy mogą szybciej i łatwiej rozsyłać maile, w których podszywają się pod zaufane instytucje, a także tłumaczyć je na różne języki. Technologia umożliwia też tworzenie deepfake’ów, czyli zmanipulowanych obrazów i filmów, do których powstania przyczyniła się sztuczna inteligencja.

Jeśli te kwestie nie są dla Ciebie w pełni jasne, trafiłeś w dobre miejsce. W tym poradniku wyjaśniamy, jak rozpoznać, czy przekaz został stworzony przy użyciu sztucznej inteligencji.

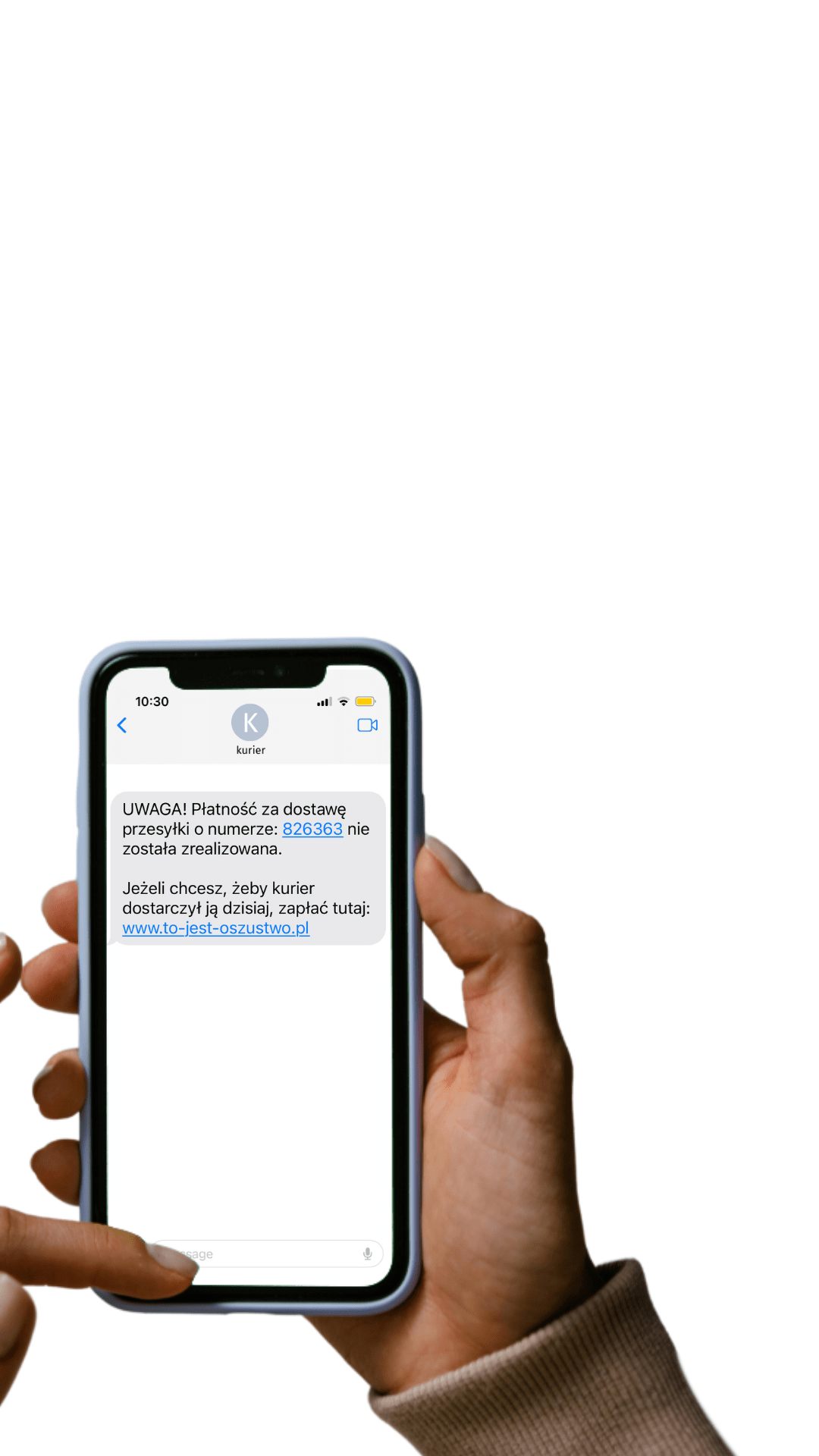

To piąta, ostatnia część naszego poradnika „Dobre nawyki seniora w sieci”. Dzięki pierwszej poznasz sposoby, jak sprawdzić, czy masz do czynienia z niebezpiecznym linkiem. Druga pokazuje, jak wykryć oszustów podszywających się pod zaufane instytucje, banki czy nawet znajomych i rodzinę. Trzecia część wskazuje dobre nawyki, które możesz wdrożyć, by chronić swoje konta w sieci. Z czwartej dowiesz się, jak rozpoznać oszustwa w mediach społecznościowych.

Dobry nawyk nr 1: sprawdź informację w innych źródłach

Obrazy i nagrania zmanipulowane przy użyciu sztucznej inteligencji nie funkcjonują w oderwaniu od rzeczywistości. Często odnoszą się do aktualnych wydarzeń czy też bieżącej polityki.

Zdarza się, że autor deepfake’a chce za jego pomocą w humorystyczny sposób skomentować aktualną sytuację, jednak gdy przerobiony materiał trafia do sieci, inni internauci nie znają kontekstu jego powstania, więc wierzą w jego autentyczność.

Tak stało się w przypadku żartobliwego nagrania powstałego z użyciem sztucznej inteligencji, w którym Jarosław Kaczyński rzekomo namawiał, by nie głosować na Prawo i Sprawiedliwość w wyborach parlamentarnych w październiku 2023 roku. Nagranie z udziałem prezesa partii zostało przerobione.

Jak dowiedzieć się, czy postać z interesującego nas filmu naprawdę wypowiedziała przypisywane jej słowa?

Warto sprawdzić tę informację w innych, wiarygodnych źródłach. W przypadku wypowiedzi znanych polityków pomocne okażą się poszukiwania w mediach. Gdyby Jarosław Kaczyński naprawdę namawiał, by nie głosować na partię, do której należy, z pewnością pisałyby o tym największe polskie portale (np. Wirtualna Polska, Onet czy Interia).

Jeśli na sprawdzanym przez Ciebie nagraniu widać charakterystyczne elementy, np. mównicę z nazwą miasta, możesz poszukać oryginalnego materiału. W przypadku wspomnianego deepfake’a z Jarosławem Kaczyńskim wystarczyłoby wpisać w wyszukiwarkę frazę: „Kaczyński Połajewo”. Twoim oczom ukazałoby się autentyczne wystąpienie prezesa Prawa i Sprawiedliwości – możesz je przesłuchać i upewnić się, czy przypisywane politykowi słowa faktycznie tam padają.

Dobry nawyk nr 2: zwróć uwagę na szczegóły

Obrazy i filmy stworzone przy użyciu sztucznej inteligencji można niekiedy rozpoznać po prostu dzięki bardzo dokładnemu przyjrzeniu się im. Na pierwszy rzut oka może się wydawać, że to trudna sztuka, ale spokojnie – na razie nasze oczy w połączeniu z krytycznym myśleniem wciąż są ważną bronią przed zmanipulowanymi materiałami.

Chcąc rozpoznać grafikę lub nagranie stworzone przy użyciu sztucznej inteligencji, zwróć uwagę przede wszystkim na drobne elementy, takie jak biżuteria czy guziki. Pomocne może być też przyjrzenie się zębom, uszom, oczom oraz liczbie i ułożeniu kończyn. Skieruj swój wzrok również na tekst na grafikach – generatory obrazów na razie niezbyt dobrze radzą sobie z tworzeniem napisów. Zastępują je czasami „szlaczkami” albo znakami przypominającymi litery.

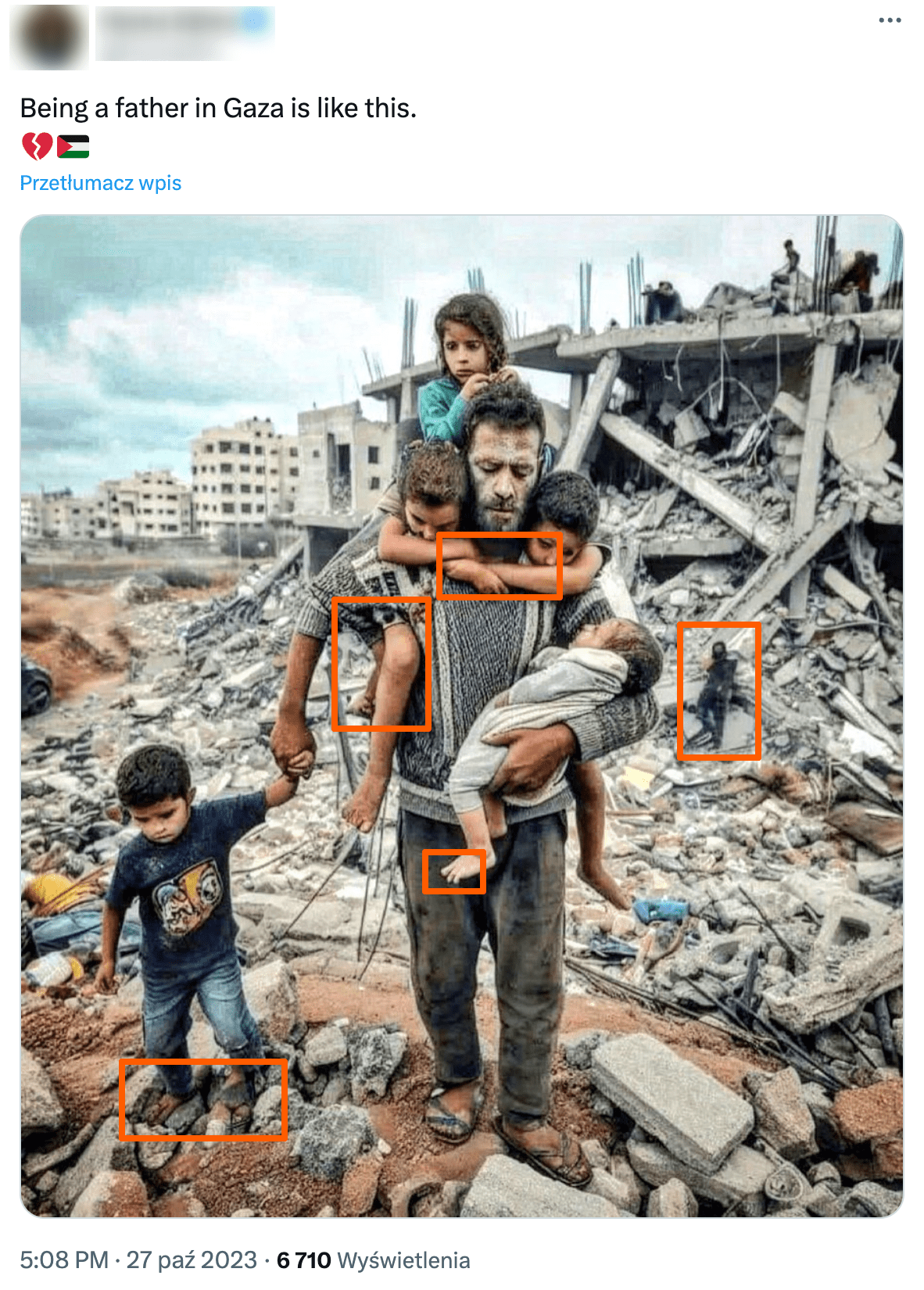

Jako przykład może posłużyć widoczne poniżej zdjęcie, które jakiś czas temu pojawiło się w sieci. Ma ono pokazywać prawdziwego mężczyznę, ojca niosącego swoje dzieci przez gruzy. Fotografia była publikowana w kontekście konfliktu w Gazie i na pierwszy rzut oka wydaje się autentyczna. Użycie sztucznej inteligencji zdradzają szczegóły takie jak nienaturalne ułożenie rąk i nóg czy też liczba palców u stóp.

Dobry nawyk nr 3: nie wierz w to, co nieprawdopodobne

Żyjemy w czasach, w których zdjęcie czy nagranie nie zawsze stanowi ostateczny dowód, można je bowiem przerobić. Jeśli coś wzbudza w Tobie skrajne emocje, wyjątkowo cię szokuje, oburza lub przeraża, spróbuj oddzielić odczucia od przekazu. Twórcy dezinformujących treści, podobnie jak oszuści internetowi, często bazują na emocjach, gdyż dzięki nim jesteśmy bardziej podatni na ich przekazy. Dlatego postaraj się spojrzeć na materiał „na chłodno” i zastanowić się, czy to, co widzisz, jest możliwe.

Widząc np. nagranie, w którym Donald Tusk w trakcie ślubowania poselskiego wypowiada słowa po niemiecku zamiast po polsku, zastanów się, czy poza tym, że jest to zabawne/oburzające/skandaliczne/żenujące, mieści się w granicach możliwych zachowań posła. Jeśli trafisz na filmik, w którym prezydent Andrzej Duda przekonuje, że podpisał ustawę gwarantującą każdemu pasywny dochód w wysokości 12 tys. zł, przemyśl, czy taki scenariusz jest w ogóle prawdopodobny.

@lukasz.stanczuk 🤣🤣😂😂🤣🤣 #tusk #sejm #donaldtusk #polityka #przyrzeczenie #niemcy #poniemiecku #poseł #co #on #mówi #śmieszne #żart ♬ dźwięk oryginalny – Łukasz Stańczuk

Możesz też poszukać informacji w innych źródłach i przyjrzeć się szczegółom materiałów. W przypadku nagrania z Donaldem Tuskiem dobrym rozwiązaniem byłoby udanie się bezpośrednio na stronę Sejmu lub jego oficjalny kanał w serwisie YouTube i przyjrzenie się fragmentowi wideo ze ślubowania posłów, kiedy głos zabrał przewodniczący Platformy Obywatelskiej [czas nagrania 01:07:32].

Pamiętaj, że użycie sztucznej inteligencji nie jest jedynym sposobem przerabiania wideo. W tym przypadku nie była potrzebna – twórcy fałszywego nagrania wykorzystali prawdziwe słowa Donalda Tuska wypowiedziane przed laty w innym kontekście. Taki sposób manipulacji przekazem nazywa się cheap fake (z ang. tani fałsz), bo do jego stworzenia nie jest potrzebna zaawansowana technologia.

W odniesieniu do materiału z udziałem Andrzeja Dudy dobrze byłoby również udać się na stronę Sejmu i w zakładce dotyczącej przebiegu procesu legislacyjnego sprawdzić, czy wspomniany projekt rzeczywiście istnieje.

Zachęcamy do zapoznania się z innymi materiałami, które pomogą Ci rozeznać się w cyfrowym świecie. Możesz odwiedzić stronę www.cyfrowiseniorzy.pl działającą w ramach Koalicji Cyfrowi Seniorzy, a także skorzystać z czekającej tam na Ciebie infolinii. Celem Koalicji jest realizacja działań edukacyjnych i informacyjnych w zakresie rozwoju kompetencji cyfrowych dojrzałych osób. Na stronie Fundacji Digital Poland znajdziesz z kolei publikację „Nowoczesny Senior – przewodnik po cyfrowym świecie”. Poza tym możesz odwiedzić stronę Towarzystwa Inicjatyw Społecznych „Ę”, gdzie znajdziesz m.in. materiały edukacyjne przygotowane we współpracy z Demagogiem.

Wspieraj niezależność!

Wpłać darowiznę i pomóż nam walczyć z dezinformacją, rosyjską propagandą i fake newsami.

*Jeśli znajdziesz błąd, zaznacz go i wciśnij Ctrl + Enter